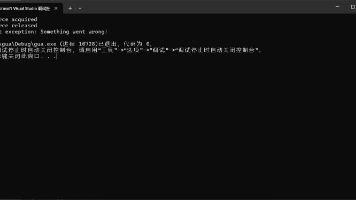

Kimi:发布1.04万亿参数MOE大模型

如何在复杂和动态环境中增强大规模语言模型的自主感知、规划、推理和行动能力?论文提出了一种新的大规模代理智能数据合成管道,并成功预训练了具有1.04万亿参数的Kimi K2模型,提高了模型在多领域的整体能力。

📖标题:Kimi K2: Open Agentic Intelligence

🌐来源:arXiv, 2507.20534

🌟摘要

我们介绍了 Kimi K2,这是一种混合专家 (MoE) 大型语言模型,具有 32 亿个激活参数和 1万亿个总参数。我们提出了 MuonClip 优化器,它通过一种新颖的 QK-clip 技术改进了 Muon,以解决训练不稳定性,同时享受 Muon 的高级令牌效率。基于 MuonClip,K2 在 15.5 万亿令牌上进行了预训练,损失峰值为零。在训练后,K2 经历了多阶段的训练后过程,由大规模代理数据合成管道和联合强化学习 (RL) 阶段突出显示,其中该模型通过与真实和合成环境的交互来提高其能力。Kimi K2 在开源非思维模型中实现了最先进的性能,具有代理能力的优势。值得注意的是,K2 在 Tau2-Bench 上获得了 66.1,在 ACEBench (En) 上获得了 76.5,在 SWE-Bench 验证上获得了 65.8,在 SWE-Bench 多语言上获得了 47.3——在非思考设置中超过了大多数开放和封闭的基线。它还在编码、数学和推理任务方面表现出强大的能力,在 LiveCodeBench v6 上得分为 53.7,在 AIME 2025 上得分为 49.5,在 GPQA-Diamond 上得分为 75.1,在 OJBench 上得分为 27.1,所有这些都没有扩展思维。这些结果将 Kimi K2 定位为迄今为止最有能力的开源大型语言模型之一,尤其是在软件工程和代理任务中。我们发布了我们的基础模型和预训练模型检查点1,以促进代理智能的未来研究和应用。

🛎️文章简介

🔸研究问题:如何在复杂和动态环境中增强大规模语言模型的自主感知、规划、推理和行动能力?

🔸主要贡献:论文提出了一种新的大规模代理智能数据合成管道,并成功预训练了具有1.04万亿参数的Kimi K2模型,提高了模型在多领域的整体能力。

📝重点思路

🔸引入MuonClip优化器,将令牌效率的Muon算法与稳定性增强机制QK-Clip相结合,以支持稳定的模型训练。

🔸采用大规模代理数据合成管道,通过模拟和真实环境系统化生成工具使用演示,构建多样化的工具、代理、任务和轨迹。

🔸结合一般强化学习技术,引入偏好和自我批评机制,有效缩小预训练和后训练之间的差距。

🔸采用严格的指令微调方法,确保高响应质量和提示多样性,提升模型的实际应用能力。

🔸利用超稀疏的混合专家模型架构,优化计算资源利用,从而在训练效率和研究效率之间取得平衡。

🔎分析总结

🔸Kimi K2在Tau2-bench、ACEBench和SWE-bench等多项基准测试中表现优异,展示了强大的代理智能能力。

🔸在代码、数学和广泛的STEM领域的基准测试中,Kimi K2超越了大多数开放和私有基线,显示出其广泛的应用潜力。

🔸通过对每项任务的具体性能评估,Kimi K2在综合能力、长上下文理解和多轮工具使用任务上都获得了显著成绩。

🔸Kimi K2在用户偏好评估中排名第一,显示出其在实际使用中的高认可度和应用价值。

💡个人观点

论文的创新点在于通过引入具有高令牌效率的MuonClip优化器和QK-Clip稳定机制,解决了LLM在训练过程中的不稳定性问题。

🧩附录

更多推荐

已为社区贡献61条内容

已为社区贡献61条内容

所有评论(0)