人大:基于熵的LLM工具调用策略

如何优化大语言模型(LLM)在动态工具使用中的决策过程,使其在多轮交互中更有效地利用工具?论文提出了Agentic Reinforced Policy Optimization(ARPO)算法,通过引入熵基础的自适应采样方法,显著提升了LLM在多轮工具使用中的性能和效率。

📖标题:Agentic Reinforced Policy Optimization

🌐来源:arXiv, 2507.19849

🌟摘要

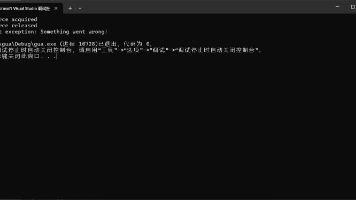

具有可验证奖励的大规模强化学习 (RLVR) 已经证明了它在利用大型语言模型 (LLM) 对单轮推理任务的潜力方面的有效性。在现实推理场景中,llm通常可以利用外部工具来辅助任务解决过程。然而,当前的 RL 算法不足以平衡模型的内在长期推理能力及其在多轮工具交互中的熟练程度。为了弥合这一差距,我们提出了代理强化策略优化 (ARPO),这是一种为训练基于多轮 LLM 的代理量身定制的新型代理 RL 算法。通过初步实验,我们观察到 LLM 往往表现出高度不确定的行为,其特征是生成的令牌的熵分布增加,紧接与外部工具的交互。受此观察的启发,ARPO 结合了基于熵的自适应推出机制、动态平衡全局轨迹采样和步骤级采样,从而促进工具使用后不确定性较高的步骤的探索。通过集成优势归因估计,ARPO 使 LLM 能够内化逐步工具使用交互的优势差异。我们在计算推理、知识推理和深度搜索领域的 13 个具有挑战性的基准上的实验表明 ARPO 优于轨迹级 RL 算法。值得注意的是,ARPO 仅使用现有方法所需的一半的工具使用预算实现了更好的性能,提供了一种可扩展的解决方案,用于将基于 LLM 的代理与实时动态环境对齐。项目在https://github.com/dongguanting/ARPO

🛎️文章简介

🔸研究问题:如何优化大语言模型(LLM)在动态工具使用中的决策过程,使其在多轮交互中更有效地利用工具?

🔸主要贡献:论文提出了Agentic Reinforced Policy Optimization(ARPO)算法,通过引入熵基础的自适应采样方法,显著提升了LLM在多轮工具使用中的性能和效率。

📝重点思路

🔸基于外部工具调用出现的高熵波动现象,提出了ARPO算法,该算法结合熵测量与工具调用反馈,优化LLM的决策过程。

🔸设计了熵基础的自适应回滚机制,允许模型在高熵工具调用步骤中进行更细致的探索。

🔸实现了优势归属估计,通过共享与独立令牌的比较,帮助模型更好地内化逐步工具使用中的优势差异。

🔸在实验中针对13个基准测试进行了广泛评估,证明ARPO相较于传统轨迹级RL算法在样本效率和准确性上均表现优越。

🔎分析总结

🔸ARPO算法显著提高了LLM在多轮交互中的工具使用效率,仅需传统方法一半的工具调用预算。

🔸实验结果表明,ARPO在多个数据集上均表现出比现有RL算法更高的准确性,平均提升4%的性能。

🔸通过熵测量,发现在动态环境中,LLM更能有效地通过高熵的采样鉴别有价值的工具调用。

🔸ARPO展示了在处理复杂推理任务时的强适应性,无论是计算推理、知识推理,还是深度搜索领域。

💡个人观点

论文的创新点在于提出了一种新的训练框架,使得LLM在进行多轮决策时,可以动态地调整工具调用策略,利用熵作为探索的动态指标,从而高效地解决复杂任务。

🧩附录

更多推荐

已为社区贡献61条内容

已为社区贡献61条内容

所有评论(0)