2025大语言模型部署实战指南:从个人开发到企业落地全栈解决方案

本文深度解析了针对2025年大语言模型的四大主流部署框架,适用于不同场景的技术选型。从个人开发者使用的Ollama,支持快速本地部署与量化模型管理;到资源受限设备上的llama.cpp,通过极致优化使老旧硬件焕发新生;再到企业级服务的vLLM,提供高并发生产环境解决方案;以及跨平台开发桥接器LM Studio,作为全栈开发者的瑞士军刀。每种方案根据其特点覆盖了从本地调试、边缘计算到大规模生产的应用

在AI技术快速迭代的2025年,大模型部署已成为开发者必须掌握的技能,如何针对不同需求选择最优部署方案,成为技术团队的核心挑战。本文系统梳理四大主流部署方案,涵盖个人开发、边缘计算、企业服务核心场景,助你精准匹配技术方案。

一、个人开发者首选:Ollama——量化模型管理神器

定位:个人PC/Mac本地快速部署

核心价值:开箱即用的模型管家

# 典型工作流示例

ollama pull qwen:7b-chat-v1.5-q4_k # 下载4-bit量化版千问7B

ollama run qwen "用Python实现快速排序" # 即时交互

技术亮点:

- 支持GGUF量化格式,70B模型仅需8GB内存

- 内置模型市场,一键获取200+预量化模型(Llama/Mistral/Qwen等)

- 跨平台支持(Win/macOS/Linux)

适用场景:

✅ 本地开发调试 ✅ 离线文档分析 ✅ 个人知识助手

⚠️ 某程序员用M2 MacBook部署CodeLlama 70B,代码补全响应速度 <800ms

二、低配设备救星:llama.cpp——C++高性能引擎

定位:树莓派/工控机/老旧PC部署

核心理念:极致的资源优化

// 典型硬件要求对比

设备类型 | 可运行模型规格

---------------------------------

树莓派5 (8GB) | Mistral-7B-Q4

Jetson Orin | CodeLlama-34B-Q5

x86旧笔记本 | Qwen-14B-Q4_K

性能突破:

- 通过AVX2/NEON指令集加速,CPU推理速度提升3-5倍

- 支持CUDA/OpenCL,老旧显卡焕发新生(GTX1060可跑13B模型)

- 内存占用降低至原始模型的1/4(7B模型仅需4GB)

实战案例:

某工业设备厂商在ARM工控机部署llama.cpp,实现设备故障语音诊断,延迟**<1.2秒**

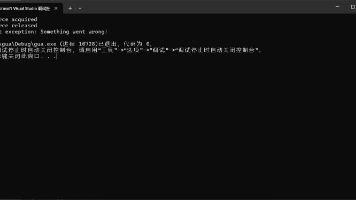

三、企业级服务引擎:vLLM——高并发生产部署

定位:百人以上团队API服务

核心科技:Continuous Batching + PagedAttention

# 企业级部署示例

from vllm import LLMEngine

engine = LLMEngine(

model="qwen-72b-chat",

tensor_parallel_size=8, # 8卡并行

max_num_seqs=256 # 并发256请求

)

性能碾压传统方案:

核心优势:

- PagedAttention技术减少70% 显存碎片

- 动态批处理提升GPU利用率至90%+

- 支持TensorRT-LLM加速,QPS再提升40%

四、全平台利器:LM Studio——跨设备开发桥接器

定位:个人开发者的瑞士军刀

突出特性:可视化模型实验室

LM Studio的本地模型管理界面

功能矩阵:

- 本地模型库管理(GGUF/GGML/HF格式自动识别)

- OpenAI兼容API(无缝对接LangChain/AutoGen)

- 设备性能监控(实时显存/温度可视化)

- 聊天界面IDE(支持函数调用调试)

典型工作流:

开发者在MacBook用LM Studio调试Qwen-7B → 通过内网API暴露服务 → 前端应用调用接口

五、方案选型决策树

六、进阶技巧:混合部署实战

场景:某智能客服系统

成效:

▸ 高峰期节省68% 云计算成本

▸ 平均响应延迟降至1.1秒

趋势预警

- 边缘智能崛起:llama.cpp已支持RISC-V架构,IoT设备大模型化加速

- 量化革命:GPTQ新算法使70B模型可在手机运行(联发科天玑9400实测)

- 多云部署:vLLM 0.5将支持跨云GPU资源池化调度

大模型部署正经历从“中心化”到“泛在化”的范式转移。无论是个人开发者的笔记本,还是万级QPS的企业系统,选择匹配场景的部署方案,将成为AI工程化落地的决胜关键。

推荐阅读:

Coze开源版本地部署指南

手把手教你玩转Dify:外部知识库接入与精准召回实战

手把手玩转本地大模型:Ollama+DeepSeek+Dify 零门槛全流程指南

三分钟私有化部署!Dify企业级落地指南:无缝接入本地大模型×构建安全知识库×智能体开发实战

AI三剑客:Dify+DeepSeek+MCP 打造企业级智能体流水线全栈指南

手把手教你搭建MCP服务器

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)