微调大语言模型——LLaMa-Factory平台搭建(非常详细)

微调大语言模型——LLaMa-Factory平台搭建(非常详细)

我们采用 LLaMA-Factory平台进行微调语言模型,详细信息可以访问github主页(https://github.com/hiyouga/LLaMA-Factory)浏览。

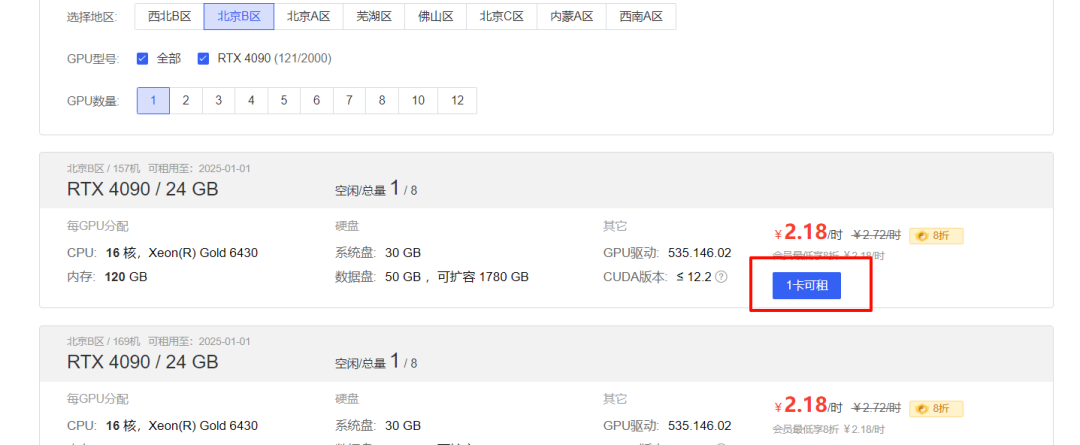

租赁显卡

采用AutoDL作为云平台进行微调训练。Win系统采用终端命令行操作的过程差不多。

选择合适的显卡,点击租赁

LLaMa-Factory 所需要的设备软硬件环境要求如下:

| Mandatory | Minimum | Recommend |

|---|---|---|

| python | 3.8 | 3.10 |

| torch | 1.13.1 | 2.2.1 |

| transformers | 4.37.2 | 4.38.2 |

| datasets | 2.14.3 | 2.17.1 |

| accelerate | 0.27.2 | 0.27.2 |

| peft | 0.9.0 | 0.9.0 |

| trl | 0.7.11 | 0.7.11 |

| Optional | Minimum | Recommend |

|---|---|---|

| CUDA | 11.6 | 12.2 |

| deepspeed | 0.10.0 | 0.13.4 |

| bitsandbytes | 0.39.0 | 0.41.3 |

| flash-attn | 2.3.0 | 2.5.5 |

训练各类模型所需的显存大小:

| Method | Bits | 7B | 13B | 30B | 65B | 8x7B |

|---|---|---|---|---|---|---|

| Full | 16 | 160GB | 320GB | 600GB | 1200GB | 900GB |

| Freeze | 16 | 20GB | 40GB | 120GB | 240GB | 200GB |

| LoRA | 16 | 16GB | 32GB | 80GB | 160GB | 120GB |

| QLoRA | 8 | 10GB | 16GB | 40GB | 80GB | 80GB |

| QLoRA | 4 | 6GB | 12GB | 24GB | 48GB | 32GB |

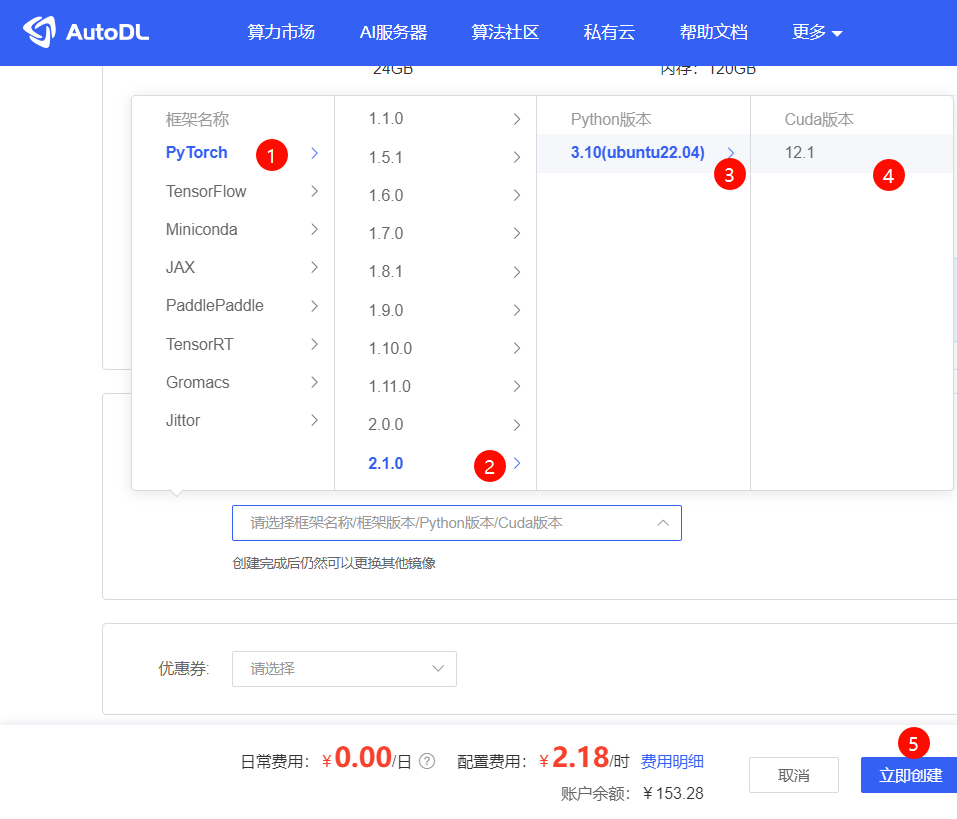

在弹出页面内镜像一栏选择基础镜像,下拉菜单内依据以上要求选择合适的pytorch框架版本、Python版本和Cuda版本。之后点击立即创建。

选择配置

本地平台配置

克隆项目

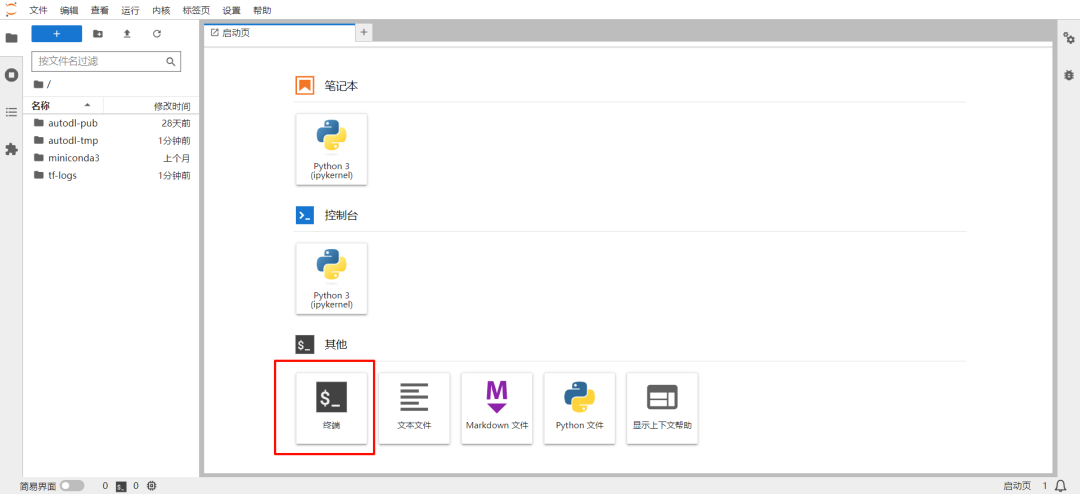

创建成功后,点击JupyterLab进入终端页面。

进入终端

终端页面如下,点击终端进入命令行页面。

点击终端

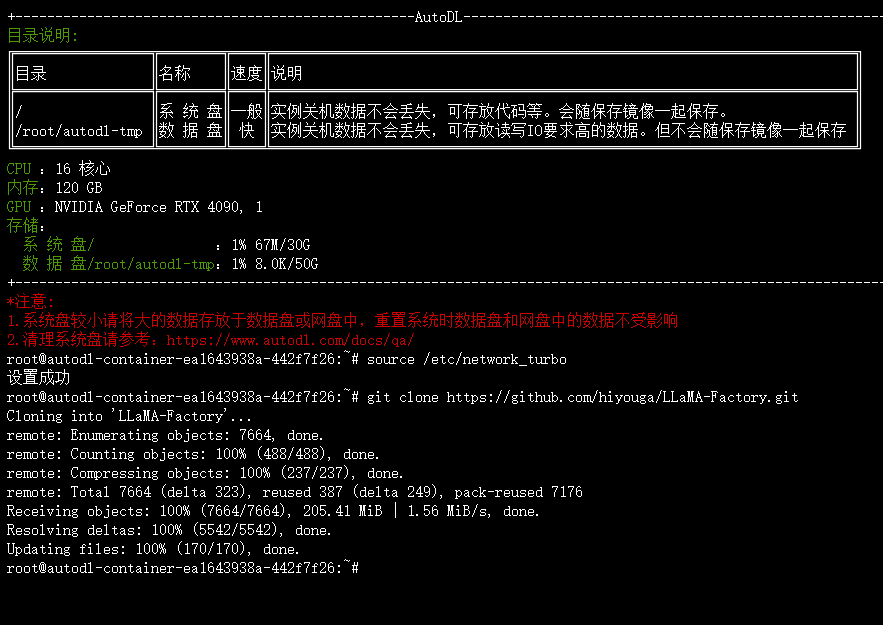

再命令行输入以下代码-回车,进行学术资源加速:

source /etc/network_turbo

再输入以下代码回车,克隆LLaMA-Factory项目:

git clone https://github.com/hiyouga/LLaMA-Factory.git

稍等一段时间,克隆完成结束后出现以下界面:

完成界面

新建虚拟环境

输入以下代码,创建新环境:

conda create -n llama_factory python=3.10

中间有过程需要输入y进行确认。

输入以下代码初始化conda:

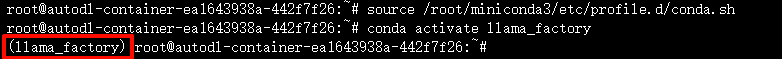

source /root/miniconda3/etc/profile.d/conda.sh

输入以下代码激活该环境:

conda activate llama_factory

如图所示,已经成功激活:

❝

「虚拟环境」

虚拟环境为项目提供了一个隔离的空间,可以避免不同项目依赖的包版本冲突。每个虚拟环境都有自己的依赖包副本,不会影响到其他环境。

之后每次运行都需要激活虚拟环境。

❞

安装依赖库

输入以下代码,进入平台目录:

cd LLaMA-Factory

输入以下代码,安装所需的库文件

pip install -r requirements.txt

再安装modelscope库

pip install modelscope -U

启动前端页面

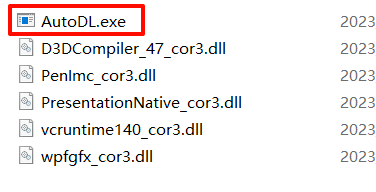

首先下载访问以下链接,下载并解压压缩包:AutoDL-SSH-Tools.zip

https://autodl-public.ks3-cn-beijing.ksyuncs.com/tool/AutoDL-SSH-Tools.zip

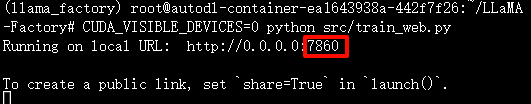

在命令行输入以下代码:

CUDA_VISIBLE_DEVICES=0 python src/train_web.py

出现如下页面即启动成功,注意端口号为7860

回到解压后的压缩包,打开第一个文件:

回到AutoDL控制台页面,按照下图填入相关信息后,点击开始代理:

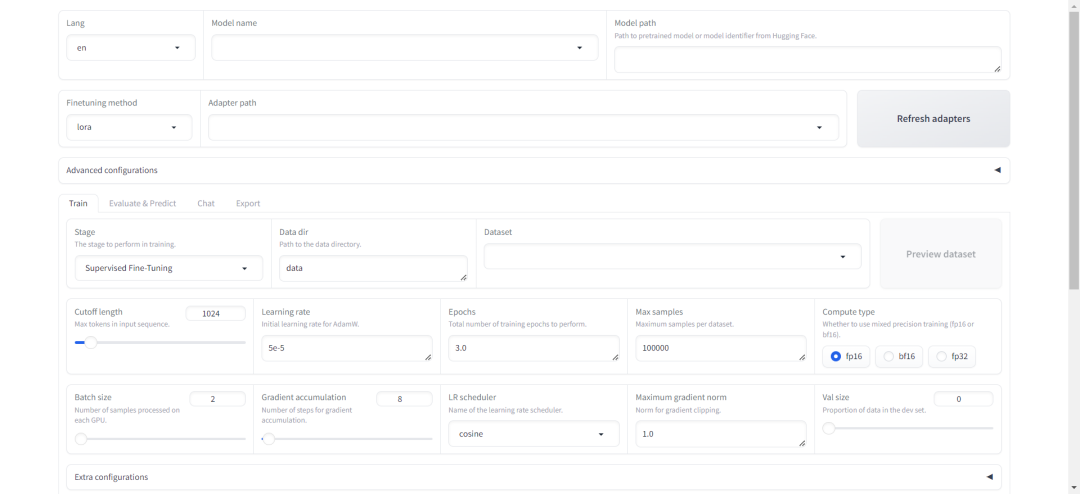

点击此网址,即可进入训练平台的前端页面:

前端页面

下载大模型

其他方法见往期推送,现补充一个新的方法:

新建py文件,命名为download.py,代码如下:

from modelscope import snapshot_download

model_path="qwen/Qwen1.5-7B-Chat"

cache_path="/root/autodl-tmp"#云平台建议下载到这个目录,是数据盘,可以扩增

snapshot_download(model_path, cache_dir=cache_path)

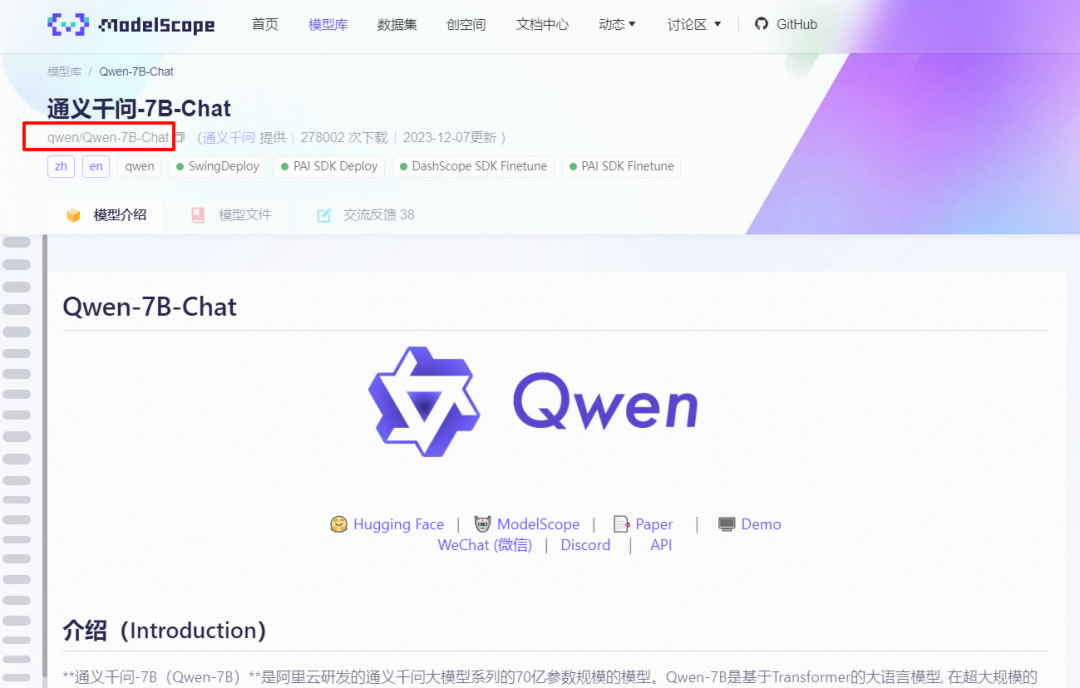

model_path可以更换为huggingface或者modelscope上的模型目录,运行该py文件即可下载

终端运行py文件方法,命令行该文件目录下输入:

python download.py

模型目录位置

模型下载网站:ModelScope

https://modelscope.cn/

Huggingface

https://huggingface.co/

GitHub

https://github.com/

Gittee

https://gitee.com/

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2024最新版CSDN大礼包:《AGI大模型学习资源包》免费分享

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

更多内容为防止和谐,可以扫描获取哦~

本文转自 https://blog.csdn.net/Javachichi/article/details/140877888?spm=1001.2014.3001.5502,如有侵权,请联系删除。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)