Day_12 超参数调整2

轮盘赌选择方法根据每个染色体的适应度占总适应度的比例来确定其被选中的概率,适应度越高的染色体被选中的概率越大。>遗传算法(Genetic Algorithm,GA)是一种受生物进化过程启发的优化搜索算法,它模拟了自然选择和遗传机制,通过迭代的方式逐步寻找问题的最优解。>- 将问题的解空间转换为染色体(个体)的编码空间,每个染色体代表问题的一个可能解。>- 对选择出来的父代染色体进行交叉操作,生成新

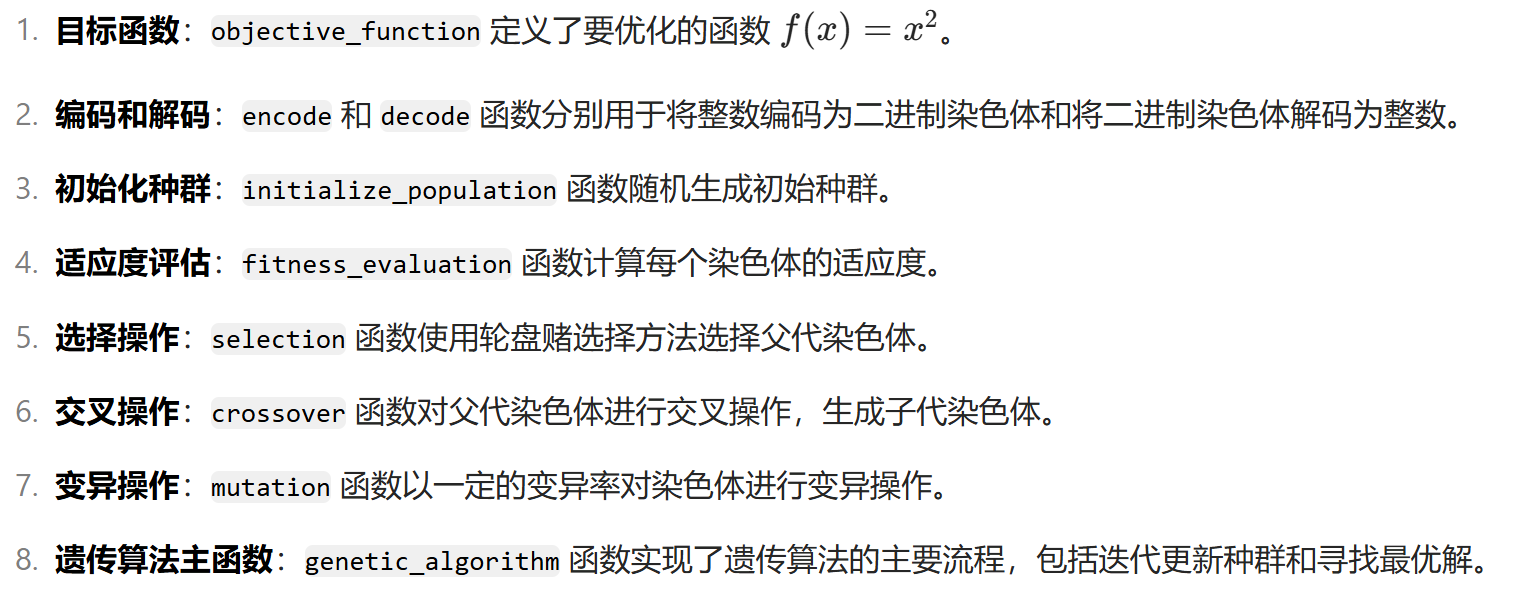

遗传算法的原理:

>遗传算法(Genetic Algorithm,GA)是一种受生物进化过程启发的优化搜索算法,它模拟了自然选择和遗传机制,通过迭代的方式逐步寻找问题的最优解。其核心原理基于达尔文的 “适者生存” 理论,主要步骤和概念如下:

>- 1.编码:

> - 将问题的解空间转换为染色体(个体)的编码空间,每个染色体代表问题的一个可能解。常见的编码方式有二进制编码、实数编码等。例如,在求解一个整数优化问题时,可以使用二进制编码将整数表示为二进制字符串。

>- 2.初始化种群:

> - 随机生成一组染色体,构成初始种群。种群中的每个染色体都是一个候选解。种群的大小会影响算法的搜索能力和计算效率,一般需要根据问题的复杂度进行调整。

>- 3.适应度评估:

> - 定义一个适应度函数,用于评估每个染色体的适应度,即该解的优劣程度。适应度越高的染色体,在后续的进化过程中越有可能被保留和繁殖。适应度函数的设计需要根据具体问题来确定,例如在求解函数最大值问题时,函数值可以直接作为适应度值。

>- 4.选择操作:

> - 根据染色体的适应度,选择一部分染色体作为父代,用于产生下一代。常用的选择方法有轮盘赌选择、锦标赛选择等。轮盘赌选择方法根据每个染色体的适应度占总适应度的比例来确定其被选中的概率,适应度越高的染色体被选中的概率越大。

>- 5.交叉操作:

> - 对选择出来的父代染色体进行交叉操作,生成新的子代染色体。交叉操作模拟了生物的基因交换过程,通过交换父代染色体的部分基因,产生新的解。常见的交叉方法有单点交叉、多点交叉等。

>- 6.变异操作:

> - 对新生成的子代染色体进行变异操作,以引入新的基因信息。变异操作可以避免算法陷入局部最优解,增加种群的多样性。变异操作通常以一个较小的概率对染色体的某些基因进行改变。

>- 7.更新种群:

> - 用新生成的子代染色体替换部分或全部父代染色体,形成新的种群。

>- 8.更新种群:

> - 判断是否满足终止条件,如达到最大迭代次数、适应度值达到阈值等。如果满足终止条件,则输出当前最优解;否则,返回步骤 3 继续进行迭代。

```python

import random

# 定义目标函数

def objective_function(x):

return x ** 2

# 染色体编码和解码

def encode(x):

return bin(x)[2:].zfill(5) # 5 位二进制编码

def decode(chromosome):

return int(chromosome, 2)

# 初始化种群

def initialize_population(population_size):

population = []

for _ in range(population_size):

x = random.randint(0, 31)

chromosome = encode(x)

population.append(chromosome)

return population

# 适应度评估

def fitness_evaluation(population):

fitness_scores = []

for chromosome in population:

x = decode(chromosome)

fitness = objective_function(x)

fitness_scores.append(fitness)

return fitness_scores

# 选择操作(轮盘赌选择)

def selection(population, fitness_scores):

total_fitness = sum(fitness_scores)

selection_probs = [fitness / total_fitness for fitness in fitness_scores]

selected_population = []

for _ in range(len(population)):

r = random.random()

cumulative_prob = 0

for i, prob in enumerate(selection_probs):

cumulative_prob += prob

if r <= cumulative_prob:

selected_population.append(population[i])

break

return selected_population

# 交叉操作

def crossover(parent1, parent2):

crossover_point = random.randint(1, len(parent1) - 1)

child1 = parent1[:crossover_point] + parent2[crossover_point:]

child2 = parent2[:crossover_point] + parent1[crossover_point:]

return child1, child2

# 变异操作

def mutation(chromosome, mutation_rate):

mutated_chromosome = ""

for gene in chromosome:

if random.random() < mutation_rate:

mutated_chromosome += '1' if gene == '0' else '0'

else:

mutated_chromosome += gene

return mutated_chromosome

# 遗传算法主函数

def genetic_algorithm(population_size, generations, mutation_rate):

population = initialize_population(population_size)

for _ in range(generations):

fitness_scores = fitness_evaluation(population)

selected_population = selection(population, fitness_scores)

new_population = []

for i in range(0, len(selected_population), 2):

parent1 = selected_population[i]

parent2 = selected_population[i + 1]

child1, child2 = crossover(parent1, parent2)

child1 = mutation(child1, mutation_rate)

child2 = mutation(child2, mutation_rate)

new_population.extend([child1, child2])

population = new_population

final_fitness_scores = fitness_evaluation(population)

best_index = final_fitness_scores.index(max(final_fitness_scores))

best_chromosome = population[best_index]

best_solution = decode(best_chromosome)

best_fitness = objective_function(best_solution)

return best_solution, best_fitness

# 运行遗传算法

population_size = 20

generations = 50

mutation_rate = 0.01

best_solution, best_fitness = genetic_algorithm(population_size, generations, mutation_rate)

print(f"最优解: x = {best_solution}")

print(f"最优值: f(x) = {best_fitness}")

粒子群算法:

>粒子群算法的原理以及实现:

>粒子群算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,由 Kennedy 和 Eberhart 于 1995 年提出。该算法受到鸟群或鱼群等群体行为的启发,通过模拟粒子在搜索空间中的飞行来寻找最优解。

>基本概念:

>- **粒子(Particle)**:每个粒子代表搜索空间中的一个潜在解。粒子具有位置和速度两个属性,位置表示解的具体取值,速度决定了粒子在搜索空间中的移动方向和距离。

>- **个体最优位置(pbest)**:每个粒子在其飞行过程中所经历过的具有最优适应度值的位置。

>- **全局最优位置(gbest)**:所有粒子的个体最优位置中具有最优适应度值的位置。

>**算法步骤**:

>- **初始化**:随机初始化一群粒子,为每个粒子随机分配初始位置和速度。同时,将每个粒子的初始位置设为其个体最优位置,并从所有粒子的个体最优位置中选择适应度值最优的作为全局最优位置。

>- **适应度评估**:根据目标函数计算每个粒子的适应度值。

>- **更新个体最优位置和全局最优位置**:对于每个粒子,比较其当前位置的适应度值与个体最优位置的适应度值,如果当前位置的适应度值更优,则更新个体最优位置。同时,比较所有粒子的个体最优位置,更新全局最优位置。

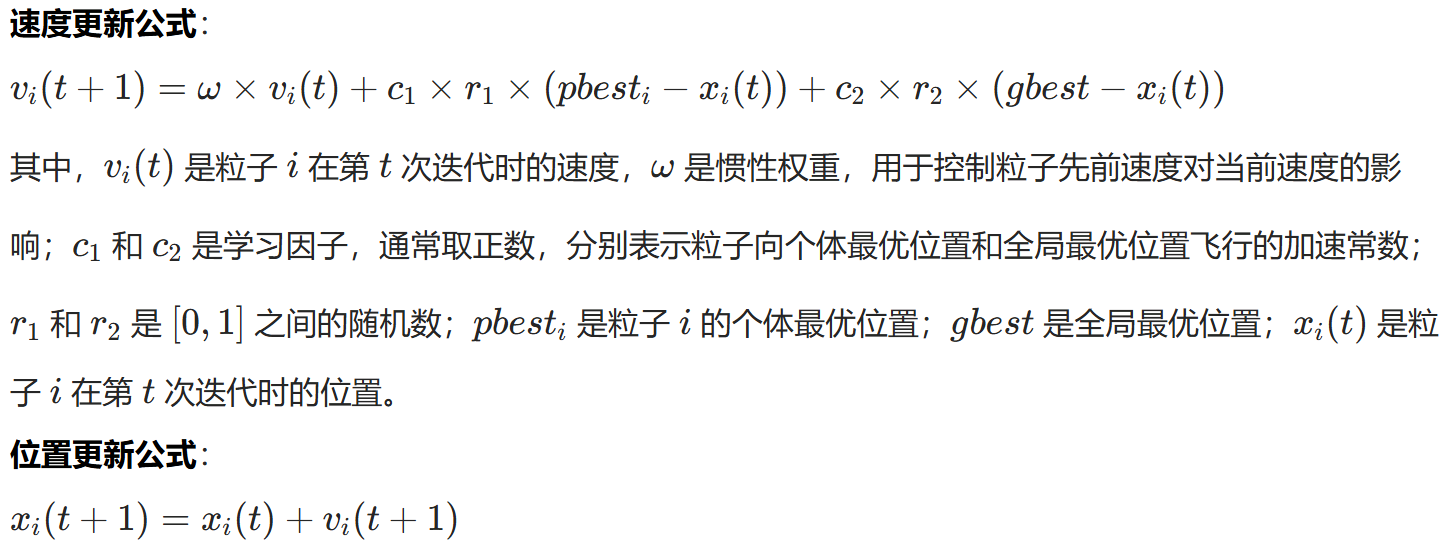

>- **更新粒子的速度和位置**:根据以下公式更新每个粒子的速度和位置:

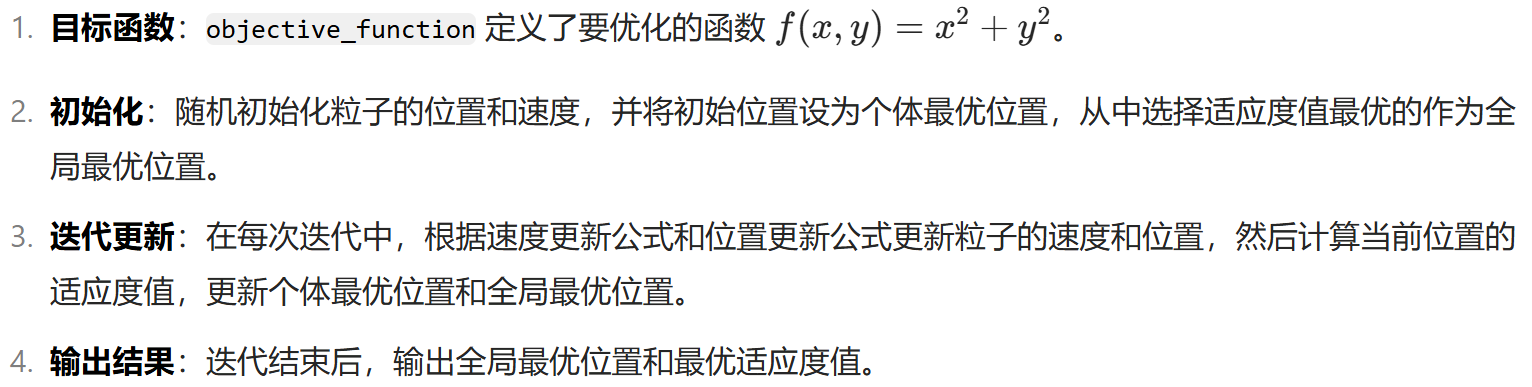

粒子群算法的实现:

```python

import numpy as np

# 定义目标函数

def objective_function(x):

return x[0] ** 2 + x[1] ** 2

# 粒子群算法主函数

def particle_swarm_optimization(num_particles, dimensions, max_iter, w, c1, c2):

# 初始化粒子的位置和速度

particles_position = np.random.uniform(-10, 10, (num_particles, dimensions))

particles_velocity = np.random.uniform(-1, 1, (num_particles, dimensions))

# 初始化个体最优位置和全局最优位置

pbest_positions = particles_position.copy()

pbest_fitness = np.array([objective_function(p) for p in particles_position])

gbest_index = np.argmin(pbest_fitness)

gbest_position = pbest_positions[gbest_index]

gbest_fitness = pbest_fitness[gbest_index]

# 迭代更新

for _ in range(max_iter):

for i in range(num_particles):

# 更新速度

r1, r2 = np.random.rand(2)

particles_velocity[i] = (w * particles_velocity[i] +

c1 * r1 * (pbest_positions[i] - particles_position[i]) +

c2 * r2 * (gbest_position - particles_position[i]))

# 更新位置

particles_position[i] += particles_velocity[i]

# 计算当前位置的适应度值

current_fitness = objective_function(particles_position[i])

# 更新个体最优位置

if current_fitness < pbest_fitness[i]:

pbest_fitness[i] = current_fitness

pbest_positions[i] = particles_position[i]

# 更新全局最优位置

if current_fitness < gbest_fitness:

gbest_fitness = current_fitness

gbest_position = particles_position[i]

return gbest_position, gbest_fitness

# 参数设置

num_particles = 30

dimensions = 2

max_iter = 100

w = 0.7 # 惯性权重

c1 = 1.4 # 个体学习因子

c2 = 1.4 # 社会学习因子

# 运行粒子群算法

best_position, best_fitness = particle_swarm_optimization(num_particles, dimensions, max_iter, w, c1, c2)

print(f"最优解: {best_position}")

print(f"最优值: {best_fitness}")

代码解释:

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)