多层感知机(MLP)的数学公式和维度标注理解

他们之前提到过图片中的内容,包括输入矩阵X的维度是n×d,隐藏层权重W_h是d×h,偏差b_h是1×h,输出层类似。例如,如果隐藏层输出是n×h,那么偏差b_h应该是1×h,这样加上去后每个样本的每个隐藏单元都加上对应的偏差。实际上,除了输入矩阵X的行数n会根据批次变化外,权重矩阵W_h和W_o的维度是固定的,由输入特征数d和隐藏单元数h决定,输出层同理。可能还需要检查用户提供的公式是否有错误,比

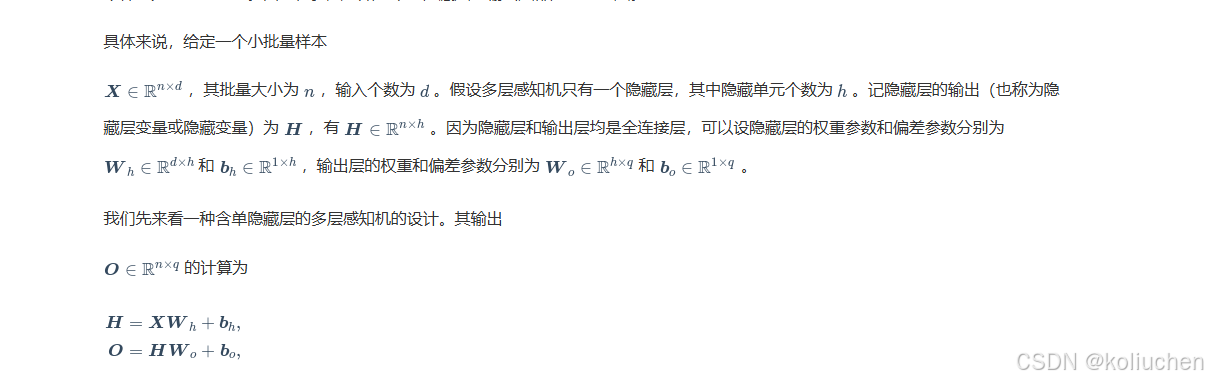

好的,我现在需要帮用户理解他们提供的图片中关于多层感知机(MLP)的数学公式和维度标注。用户的问题是关于如何通俗易懂地理解像X、H、W、b这些矩阵和向量的上标,比如n×d、n×h、d×h、1×h等。他们之前提到过图片中的内容,包括输入矩阵X的维度是n×d,隐藏层权重W_h是d×h,偏差b_h是1×h,输出层类似。用户希望用更简单的方式解释这些维度的意义。

首先,我得回忆一下用户之前的对话历史。之前用户问过隐藏单元数量256是否是人为规定的,我解释了那是超参数,根据任务需求选择。现在用户可能是在深入理解MLP的结构,所以需要将数学公式中的维度与实际应用联系起来。

接下来,我需要分析用户当前的问题。他们可能对矩阵乘法和维度匹配不太熟悉,或者希望用更直观的例子来理解为什么权重矩阵的维度是这样的。比如,输入矩阵X是n×d,其中n是批量大小,d是输入特征数。隐藏层权重W_h是d×h,这样X乘以W_h才能得到n×h的隐藏层输出H。这需要解释矩阵相乘的规则,即前一个矩阵的列数等于后一个矩阵的行数。

然后,我需要考虑如何将这些抽象的数学概念转化为通俗的例子。比如,用学生、科目、成绩来类比,或者用图像处理中的像素和滤波器。这样的类比可以帮助用户建立直观的理解。

同时,用户提到的图片中有具体的公式,比如H = XW_h + b_h,O = HW_o + b_o。需要确认这些公式的维度是否正确,是否有笔误。例如,原问题中用户提到图片里的公式可能有排版错误,比如“W。∈Rh x q”应该是W_o ∈ R^h×q。这时候需要指出正确的维度,并解释每个参数的作用。

另外,用户可能对偏差项b的维度有疑问,比如为什么是1×h而不是h×1。这里需要解释偏差项在矩阵运算中的位置,通常是加在输出之后,因此需要匹配输出的维度。例如,如果隐藏层输出是n×h,那么偏差b_h应该是1×h,这样加上去后每个样本的每个隐藏单元都加上对应的偏差。

还需要考虑用户可能的混淆点,比如批量大小n的变化对维度的影响。例如,如果处理不同大小的批次,其他矩阵的维度是否需要改变?实际上,除了输入矩阵X的行数n会根据批次变化外,权重矩阵W_h和W_o的维度是固定的,由输入特征数d和隐藏单元数h决定,输出层同理。

最后,总结的时候需要强调维度匹配的重要性,以及如何通过调整超参数(如h)来影响模型的复杂度。同时,可以建议用户通过实际的小例子来手动计算,加深理解,比如用具体的数字代替n、d、h,进行矩阵乘法验证。

可能还需要检查用户提供的公式是否有错误,比如图片中的O=HW0+b2n,这里的b2n可能是排版错误,正确的应该是b_o,维度为1×q。这时候需要礼貌地指出并纠正,避免用户误解。

总的来说,回答的结构应该是先分点解释每个矩阵的维度,然后用类比和例子帮助理解,接着讨论公式中的运算,最后总结关键点,并指出可能的排版问题。确保语言通俗易懂,避免过多技术术语,同时保持准确性。

我们通过一个生活化的比喻和具体例子来解释这些维度的设计逻辑:

---

### 一、核心概念拆解(用「快递收发」类比)

1. **输入矩阵 X(n×d)**

• **n**:快递站每天处理的包裹数量(批量大小)

• **d**:每个包裹的尺寸测量指标(输入特征数)

• **现实意义**:`[[包裹1长度, 包裹1宽度], [包裹2长度, 包裹2宽度], ...]`

2. **隐藏层参数(W_h×h + b_h×1)**

• **W_h(d×h)**:快递分拣流水线的传送带配置

◦ d列:每个原始尺寸指标对应 h 个分拣通道

◦ h行:每个分拣通道的处理能力

• **b_h(1×h)**:每个分拣通道的基准处理量(类似温度补偿)

3. **输出层参数(W_o×h + b_o×1)**

• **W_o(h×q)**:分拣结果到最终分类的映射表

◦ h列:每个分拣通道的输出对应 q 个分类结果

◦ q行:每个分类结果的权重系数

---

### 二、维度匹配的数学本质

通过矩阵乘法实现「特征转换」:

```python

# 输入层 → 隐藏层

H = X @ W_h + b_h # (n×d) @ (d×h) → (n×h)

# 隐藏层 → 输出层

O = H @ W_o + b_o # (n×h) @ (h×q) → (n×q)

```

**关键匹配规则**:

1. 输入矩阵的列数 = 权重矩阵的行数(保证可相乘)

2. 偏差向量的行数 = 权重矩阵的列数(保证维度对齐)

---

### 三、具体数字示例(图像分类场景)

假设处理 **100张图片**(n=100),每张图 **28×28像素**(d=784):

| 层级 | 参数形状 | 实例解释 |

|------------|----------------|--------------------------------------------------------------------------|

| 输入层 | X: 100×784 | 100张图,每张图784个像素值 |

| 隐藏层1 | W_h:784×256 | 每个像素值影响256个隐藏单元 |

| | b_h:1×256 | 为256个隐藏单元添加统一偏置 |

| 隐藏层2 | W_o:256×10 | 每个隐藏单元影响10个最终分类结果(如数字0-9) |

| | b_o:1×10 | 为10个分类结果添加统一偏置 |

---

### 四、维度设计的深层逻辑

1. **为什么隐藏层是d×h?**

• 每个原始特征(d列)需要独立地影响所有隐藏单元(h行)

• 类似:快递的每个尺寸指标都要被所有分拣通道处理

2. **为什么偏差是1×h?**

• 为每个隐藏单元添加独立的偏置量

• 类似:每个分拣通道有自己的基准线调整

3. **批量处理的魔法**

• 批量大小n的变化不影响参数形状

• 类似:快递站每天处理100个包裹或200个包裹,分拣流水线的配置不变

---

### 五、常见疑问解析

**Q:如果我把隐藏层单元数h从256改成512,需要修改哪些参数?**

• 只需改变 `W_h` 的第二维(从784×256 → 784×512)和 `b_h` 的第二维(从1×256 → 1×512)

• 输出层参数 `W_o` 和 `b_o` 会自动适应新的h值(从512×q → 保持h×q结构)

**Q:为什么输出层是h×q而不是q×h?**

• 这是矩阵乘法的顺序问题,H是n×h矩阵,要得到n×q的输出,必须满足:

```

(n×h) @ (h×q) = n×q

```

• 如果写成q×h就会变成(n×h)@(q×h) → 维度不匹配!

---

### 六、图示总结

1. **输入空间**:n个样本 × d个特征

2. **隐藏层变换**:通过d×h权重矩阵压缩到h维

3. **输出层变换**:通过h×q权重矩阵映射到q类概率

---

### 最终理解检验

试着回答:

• 如果输入特征数从d=784增加到d=1024,隐藏层参数W_h的形状会变成?

• 如果希望输出有100个类别(q=100),输出层权重W_o的第二维应该是多少?

答案:

1. W_h 的形状变为 **1024×h**

2. W_o 的第二维应为 **h×100**

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)