CUDA如何知道哪个GPU对应哪个编号?

请注意,如果你的系统中有多个GPU,它们可能会因为硬件配置、驱动程序或其他因素而有所不同。在多GPU系统中,确保正确地选择和配置GPU是非常重要的,以便有效地利用计算资源。这些方法可以帮助你了解系统中的GPU情况,包括它们的编号、名称以及是否可用。通常,编号为0的GPU是默认的CUDA设备,但你可以根据需要更改这个设置。模块来获取系统中的GPU信息,并查看每个GPU的编号。要确定哪个GPU对应哪个

·

要确定哪个GPU对应哪个编号,你可以使用PyTorch的torch.cuda模块来获取系统中的GPU信息,并查看每个GPU的编号。以下是一些常用的方法来获取GPU信息和编号:

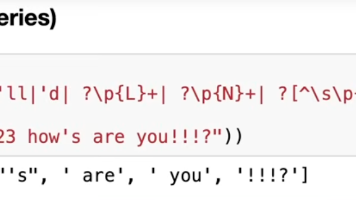

- 使用

torch.cuda.device_count()获取GPU数量:import torch num_gpus = torch.cuda.device_count() print(f"Number of GPUs available: {num_gpus}") - 使用

torch.cuda.get_device_name()获取每个GPU的名称:import torch for i in range(torch.cuda.device_count()): print(f"GPU {i}: {torch.cuda.get_device_name(i)}") - 使用

torch.cuda.is_available()检查CUDA是否可用:import torch print(f"CUDA is available: {torch.cuda.is_available()}") - 使用

torch.cuda.current_device()获取当前选择的GPU编号:import torch current_gpu = torch.cuda.current_device() print(f"Current GPU device: {current_gpu}") - 使用

torch.cuda.set_device()设置当前使用的GPU编号:import torch torch.cuda.set_device(1) # 设置编号为1的GPU为当前设备

这些方法可以帮助你了解系统中的GPU情况,包括它们的编号、名称以及是否可用。通常,编号为0的GPU是默认的CUDA设备,但你可以根据需要更改这个设置。

请注意,如果你的系统中有多个GPU,它们可能会因为硬件配置、驱动程序或其他因素而有所不同。在多GPU系统中,确保正确地选择和配置GPU是非常重要的,以便有效地利用计算资源。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)