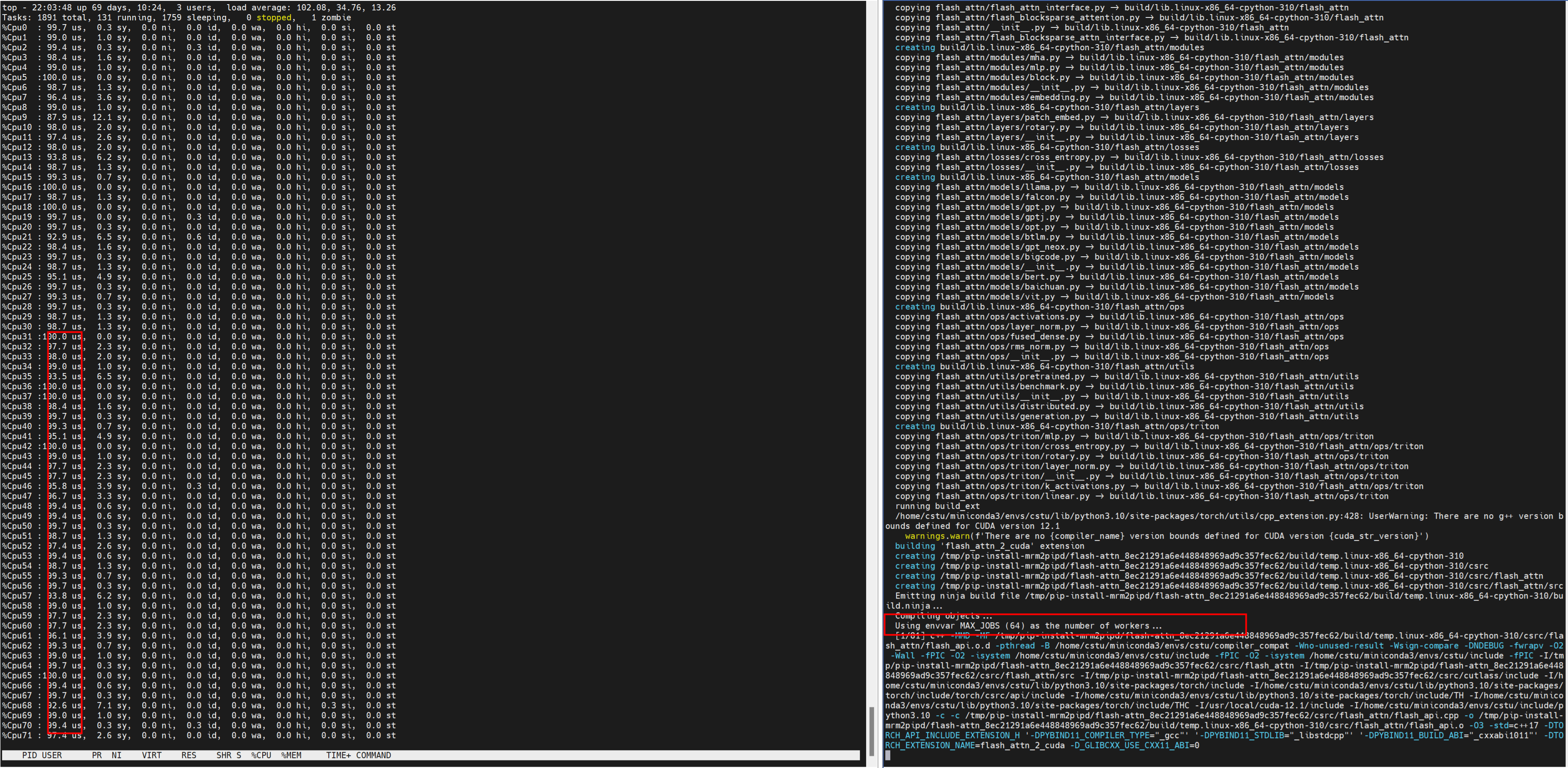

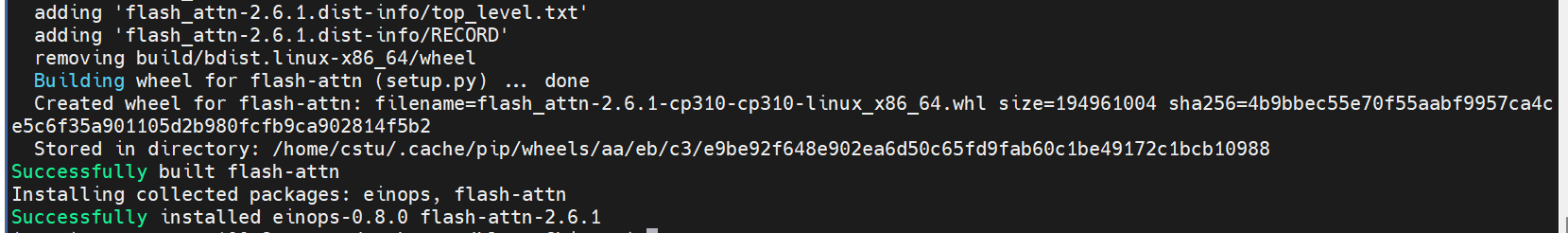

快速安装flash-attn

不安装ninja,MAX_JOBS不起作用。MAX_JOBS根据自己硬件配置来设置。如果pip安装很慢,可以试试这个方法。经过10分钟不到,编译成功。

·

如果pip安装很慢,可以试试这个方法

https://github.com/Dao-AILab/flash-attention

pip install ninja

MAX_JOBS=64 pip install -v flash-attn --no-build-isolation

不安装ninja,MAX_JOBS不起作用

MAX_JOBS根据自己硬件配置来设置

经过10分钟不到,编译成功

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)