卷积神经网络中的注意力机制

视觉注意力机制:视觉注意力机制是人类视觉所特有的大脑信号处理机制。人类视觉通过快速扫描全局图像,获得需要重点关注的目标区域,也就是一般所说的注意力焦点,而后对这一区域投入更多注意力资源,以获取更多所需要关注目标的细节信息,而抑制其他无用信息。在卷积神经网络中,视觉注意力通常可分为通道注意力和空间注意力两种形式。通道注意力机制:空间注意力机制:1.Convolutional Block ...

视觉注意力机制:视觉注意力机制是人类视觉所特有的大脑信号处理机制。人类视觉通过快速扫描全局图像,获得需要重点关注的目标区域,也就是一般所说的注意力焦点,而后对这一区域投入更多注意力资源,以获取更多所需要关注目标的细节信息,而抑制其他无用信息。在卷积神经网络中,视觉注意力通常可分为通道注意力和空间注意力两种形式。

通道注意力机制:

空间注意力机制:

1.Convolutional Block Attention Module(CBAM)

论文:CBAM: Convolutional Block Attention Module

收录于:ECCV 2018

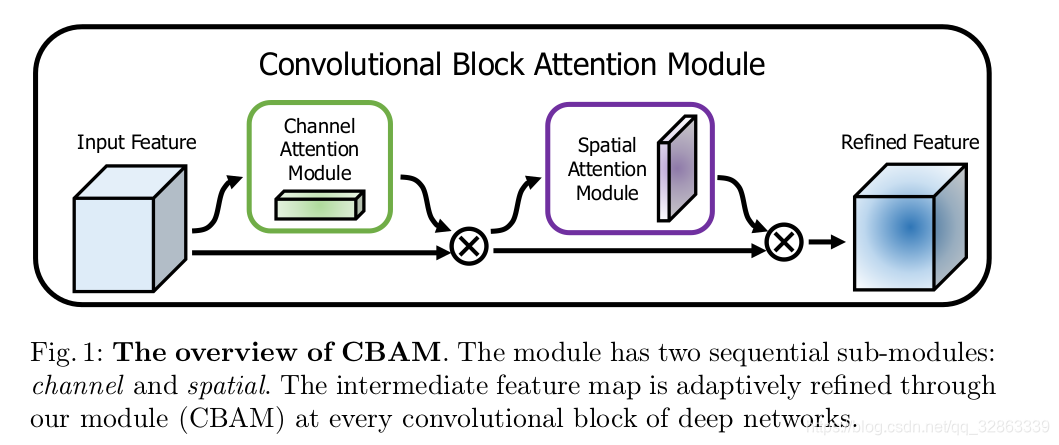

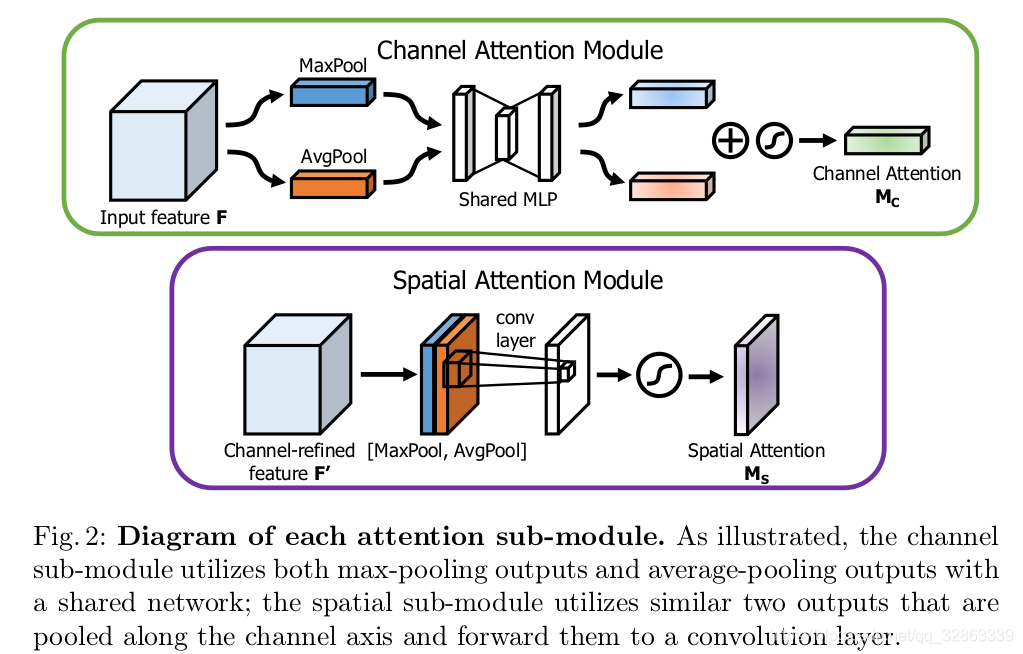

文章中提出的CBAM注意力模块由通道注意力模块和空间注意力模块串行连接组成,CBAM从通道和空间两个维度计算feature map的attention map,然后将attention map与输入的feature map相乘来进行特征的自适应学习。文章中也尝试了进行并行连接,发现串行连接的方式能够取得更好的效果。

CBAN模块的示意图如下所以:

2. Squeeze-and-Excitation Networks (ImageNet 2017 竞赛 Image Classification 任务的冠军解决方案)

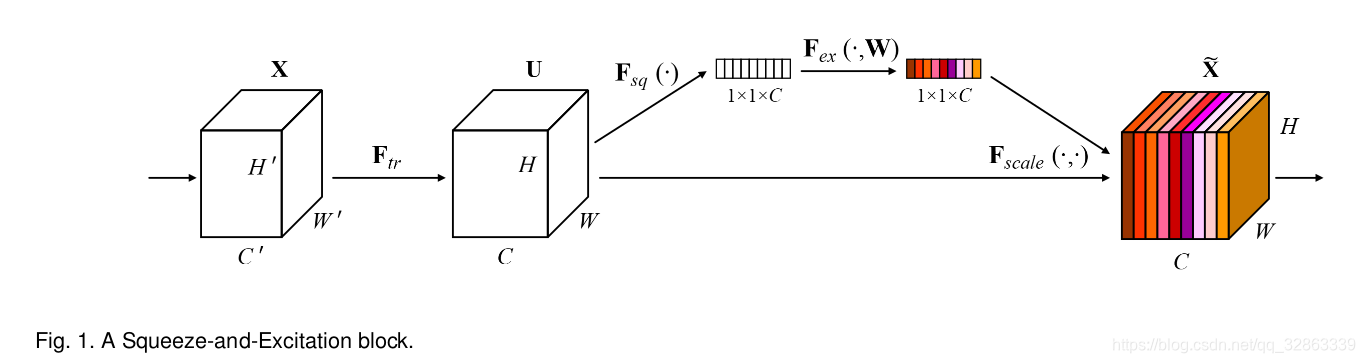

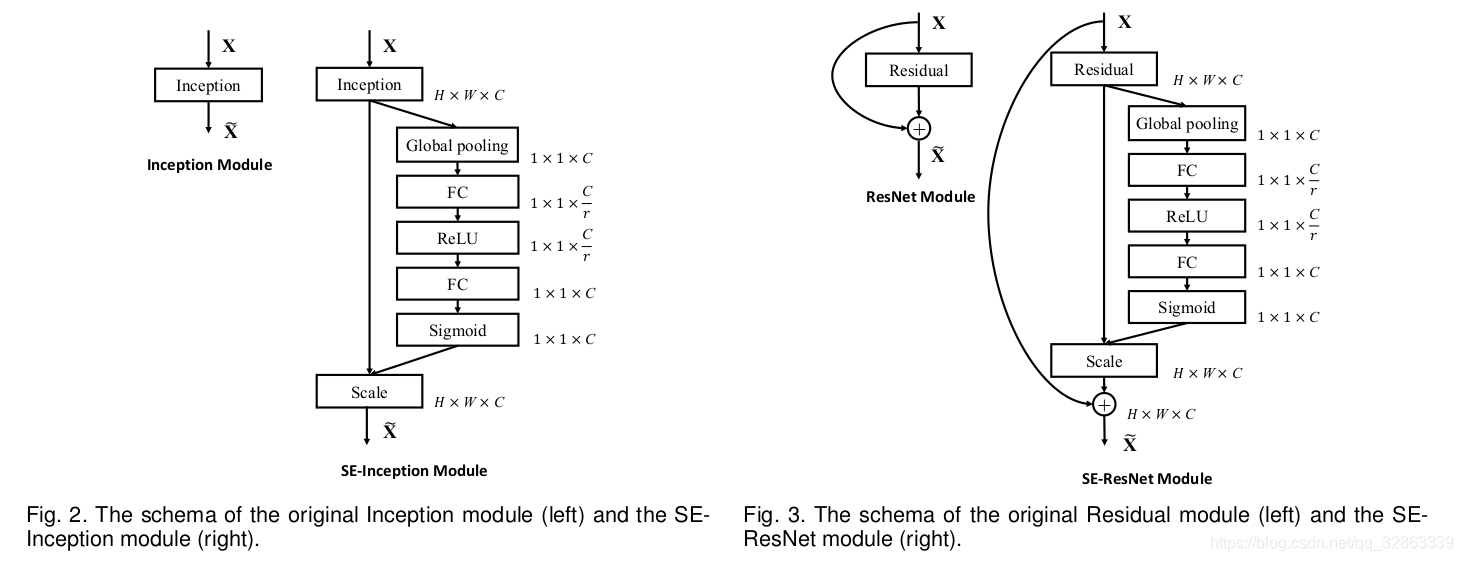

卷积核作为卷积神经网络的核心,通常被看做是在局部感受野上,将空间上(spatial)的信息和特征维度上(channel-wise)的信息进行聚合的信息聚合体。卷积神经网络由一系列卷积层、非线性层和下采样层构成,这样它们能够从全局感受野上去捕获图像的特征来进行图像的描述。

然而去学到一个性能非常强劲的网络是相当困难的,其难点来自于很多方面。最近很多工作被提出来从空间维度层面来提升网络的性能,如 Inception 结构中嵌入了多尺度信息,聚合多种不同感受野上的特征来获得性能增益;在 Inside-Outside 网络中考虑了空间中的上下文信息;还有将 Attention 机制引入到空间维度上,等等。这些工作都获得了相当不错的成果。

在作者提出的结构中,Squeeze 和 Excitation 是两个非常关键的操作,所以以此来命名。SENet提出的动机是希望显式地建模特征通道之间的相互依赖关系。具体来说,就是通过学习的方式来自动获取到每个特征通道的重要程度,然后依照这个重要程度去提升有用的特征并抑制对当前任务用处不大的特征。

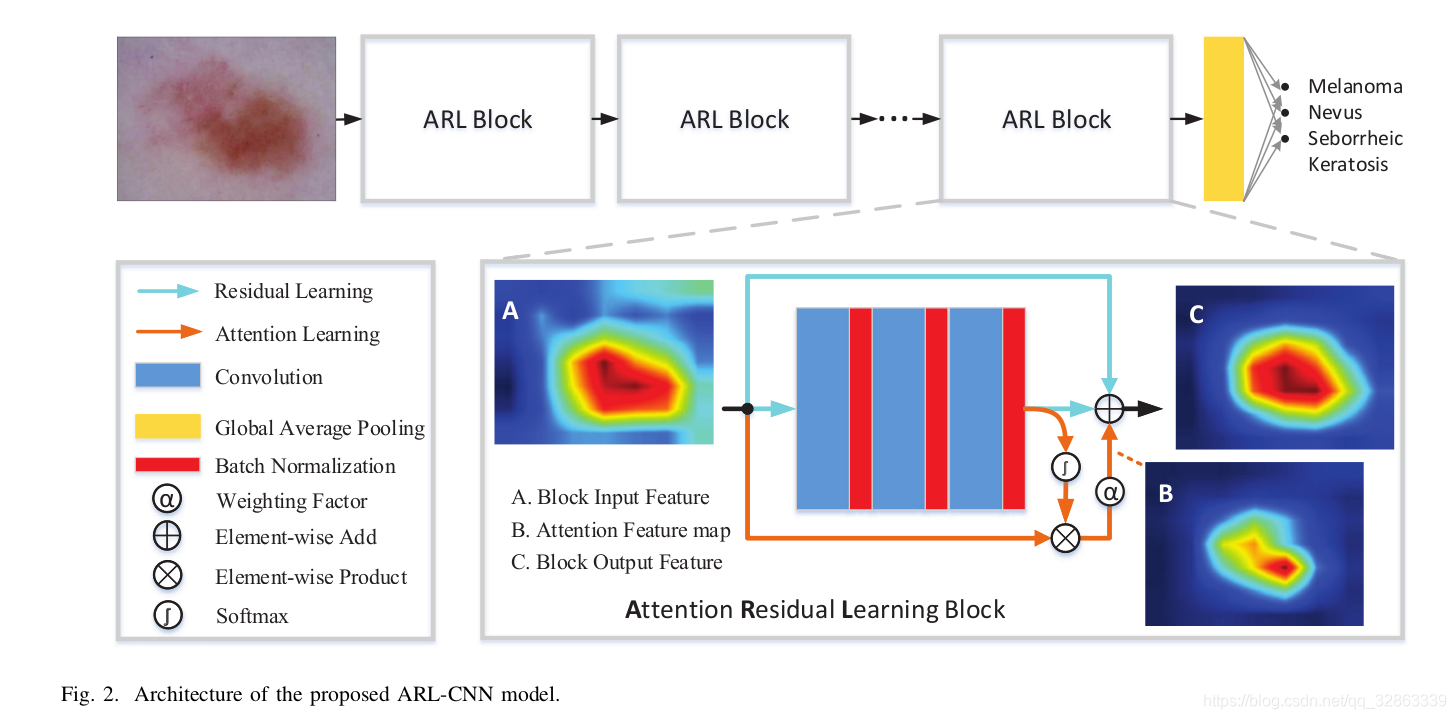

3. Attention Residual Learning for Skin Lesion Classification

在本文中,作者提出了空间自注意力机制,即对从高层得到的特征图做softmax得到空间注意力图,并将此注意力图与低层特征相乘,使得网络对刚兴趣区域有更多的关注。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)