给你一个新视角看世界——Depth-Anything-3

在五大数据集构成的几何基准上,DA3 对深度、几何、位姿、渲染四大指标全面刷新记录,甚至小模型版本都能打赢别人家大模型 —— 这性能,妥妥「打小怪兽像打蚊子」级别的。它的潜力也很让人上头:无论是机器人需要看清路、AR/VR 需要理解空间、无人机想认清地形,还是想把普通相机变成「会理解世界的 3D 传感器」,DA3 都能轻松胜任。换句话来说,DA3 就像给普通相机开了「空间透视外挂」,把原本平面的画

如果说以往的 3D 视觉模型像「术业有专攻」的匠人,那么 Depth-Anything-3(DA3) 就是那个突然横空出世、把所有活都能干而且干得还贼好的「全能大师」。它的秘诀很简单:只用一个标准 Vision Transformer,就能同时搞定深度估计、相机位姿、三维重建和视角渲染。 给它一张图,它能看深度;给它几张图,它能还原三维结构;给它视频,它还能把相机怎么动的都推出来;换个角度,它还能帮你把「没见过的世界」重新画一遍。

DA3 不仅能干,而且干得比以前的 SOTA 还好。在五大数据集构成的几何基准上,DA3 对深度、几何、位姿、渲染四大指标全面刷新记录,甚至小模型版本都能打赢别人家大模型 —— 这性能,妥妥「打小怪兽像打蚊子」级别的。

它的潜力也很让人上头:无论是机器人需要看清路、AR/VR 需要理解空间、无人机想认清地形,还是想把普通相机变成「会理解世界的 3D 传感器」,DA3 都能轻松胜任。

换句话来说,DA3 就像给普通相机开了「空间透视外挂」,把原本平面的画面变成可理解、可计算的 3D 世界。

教程链接:https://go.openbayes.com/chi4z

使用云平台: OpenBayes

http://openbayes.com/console/signup?r=sony_0m6v

首先点击「公共教程」,找到「Depth-Anything-3:从任何视角恢复视觉空间」,单击打开。

页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

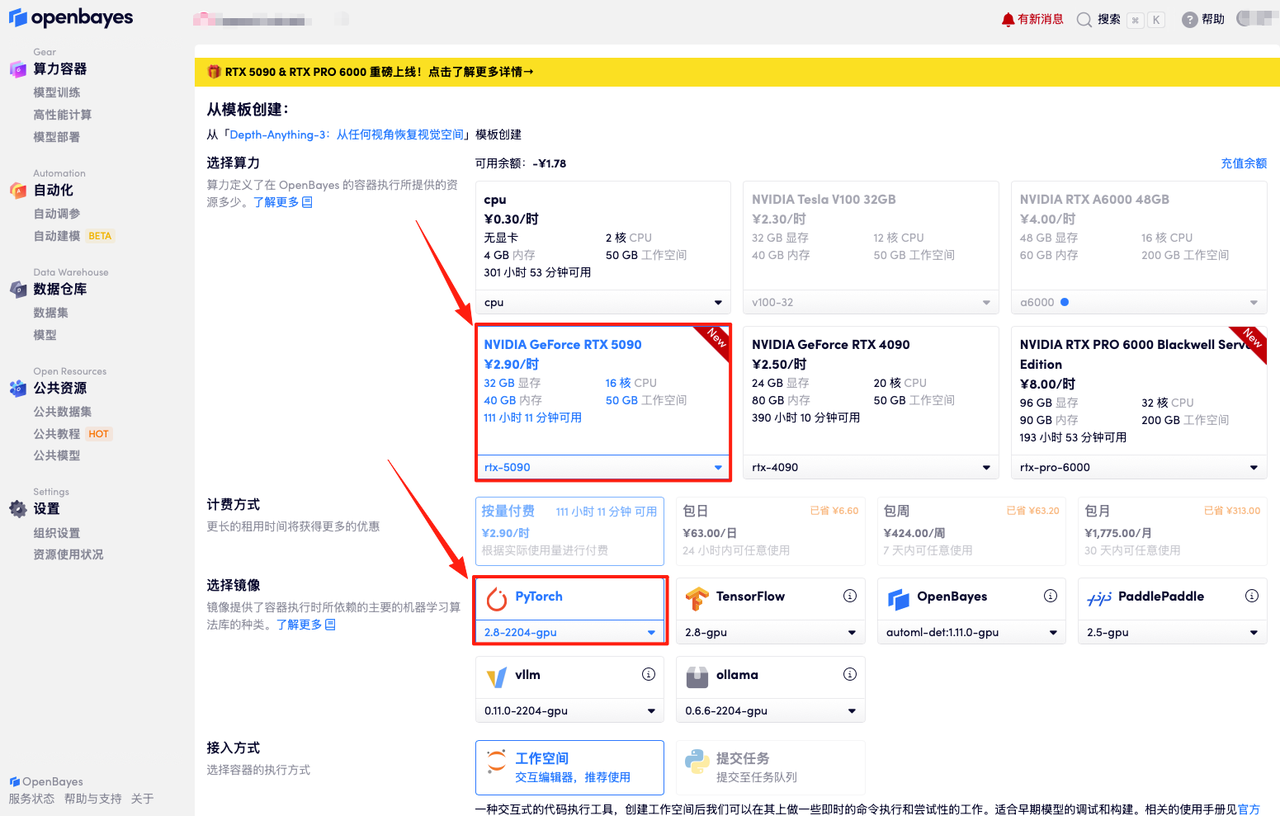

在当前页面中看到的算力资源均可以在平台一键选择使用。平台会默认选配好原教程所使用的算力资源、镜像版本,不需要再进行手动选择。点击「继续执行」,等待分配资源。

数据和代码都已经同步完成了。容器状态显示为「运行中」后,点击「API 地址」,即可进入模型界面。

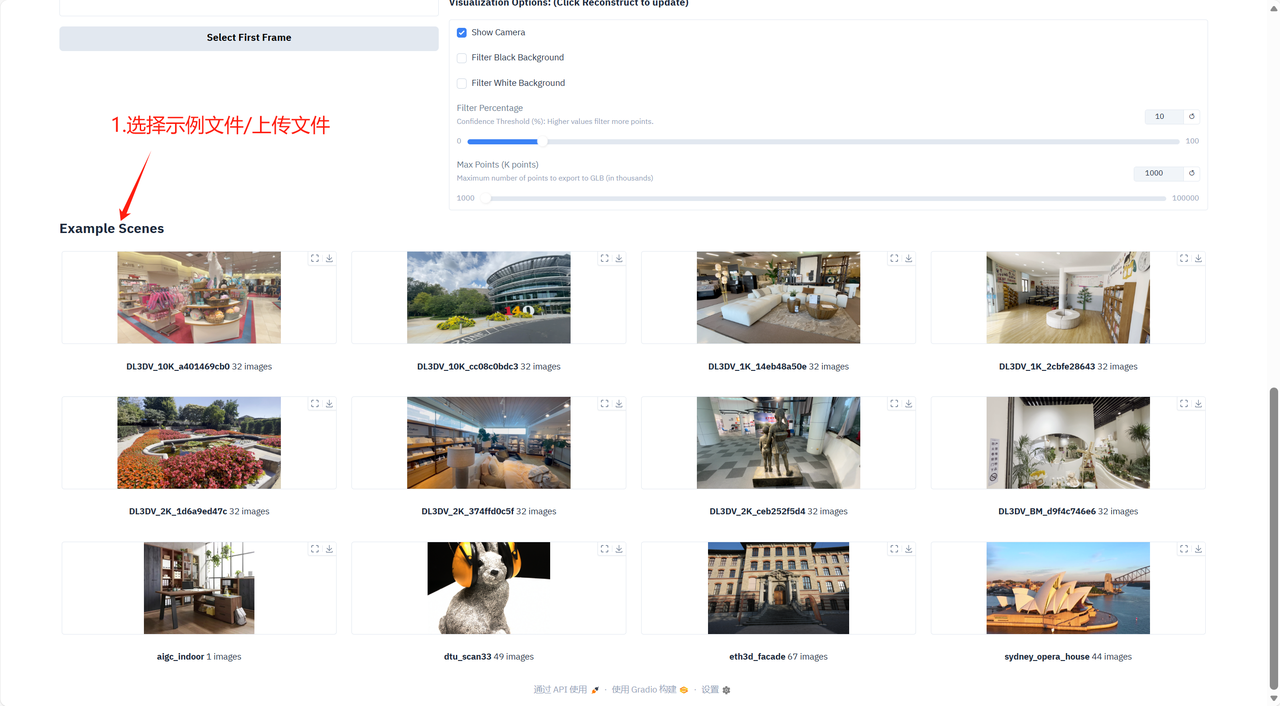

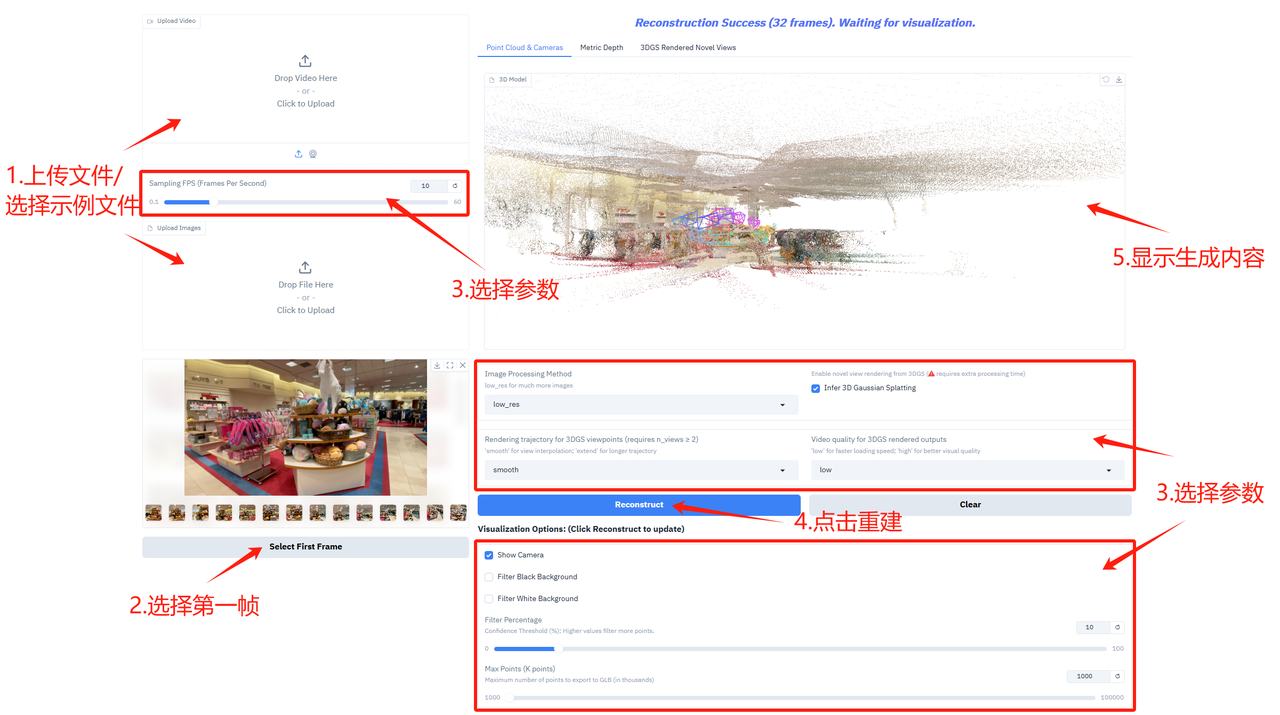

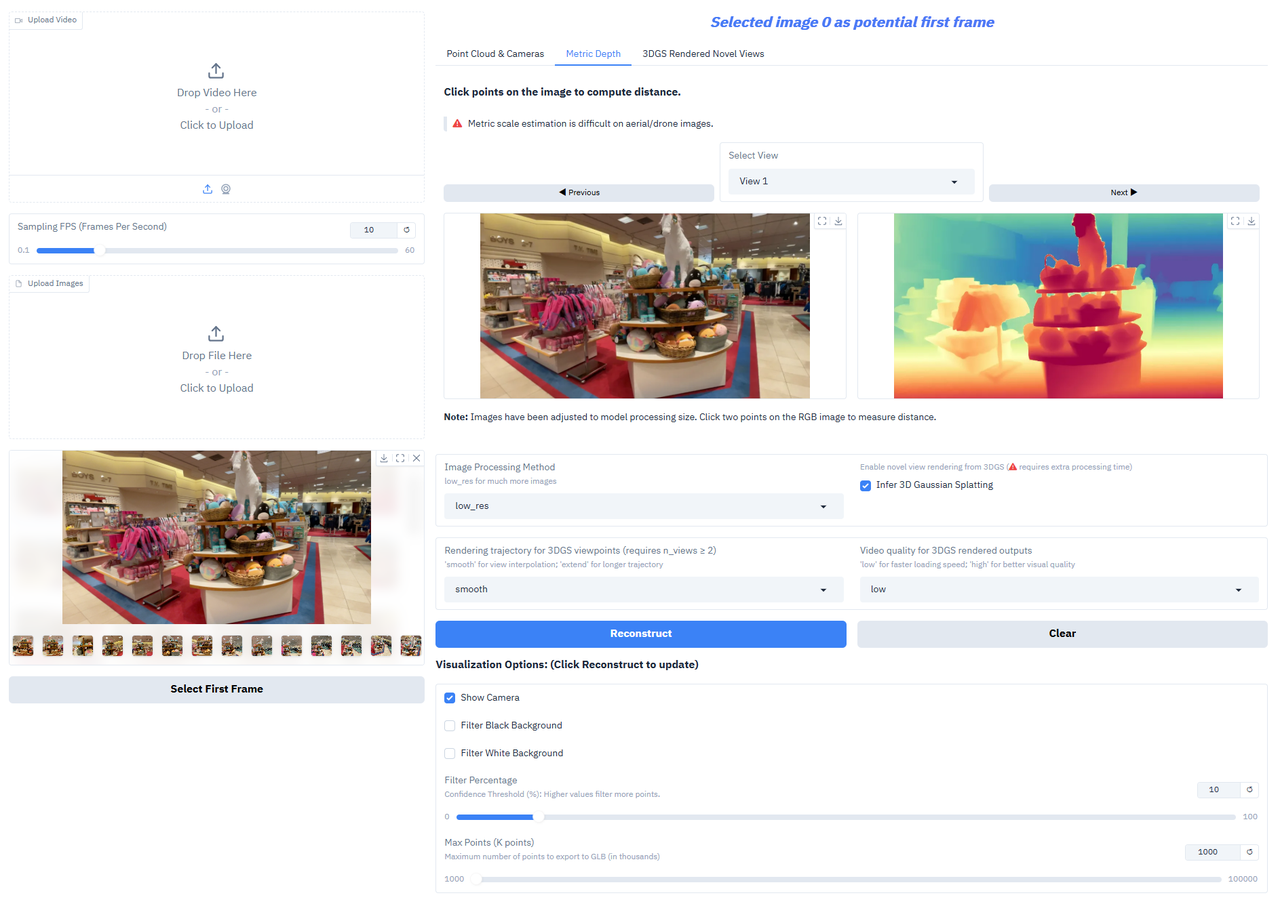

使用步骤如下:

参数说明

- 采样帧率设置

- Sampling FPS (Frames Per Second):控制视频采样的每秒帧数。

- 图像处理与 3D 推理设置

- Image Processing Method:选择图像处理模式,适配更多图像数量。

- Infer 3D Gaussian Splatting:启用 3D 高斯溅射推理,生成 3D 模型需额外处理时间。

- 渲染轨迹与视频质量设置

- Rendering trajectory for 3DGS viewpoints:选择 3DGS 视角的渲染轨迹类型。

- Video quality for 3DGS rendered outputs:控制 3DGS 渲染输出的视频质量。

- 可视化选项

- Show Camera:在3D视图中显示相机轨迹。

- Filter Black Background:过滤点云中的黑色背景区域。

- Filter White Background:过滤点云中的白色背景区域。

- Filter Percentage:控制点云过滤强度。

- Max Points (K points):设置导出 GLB 格式 3D 模型的最大点数。

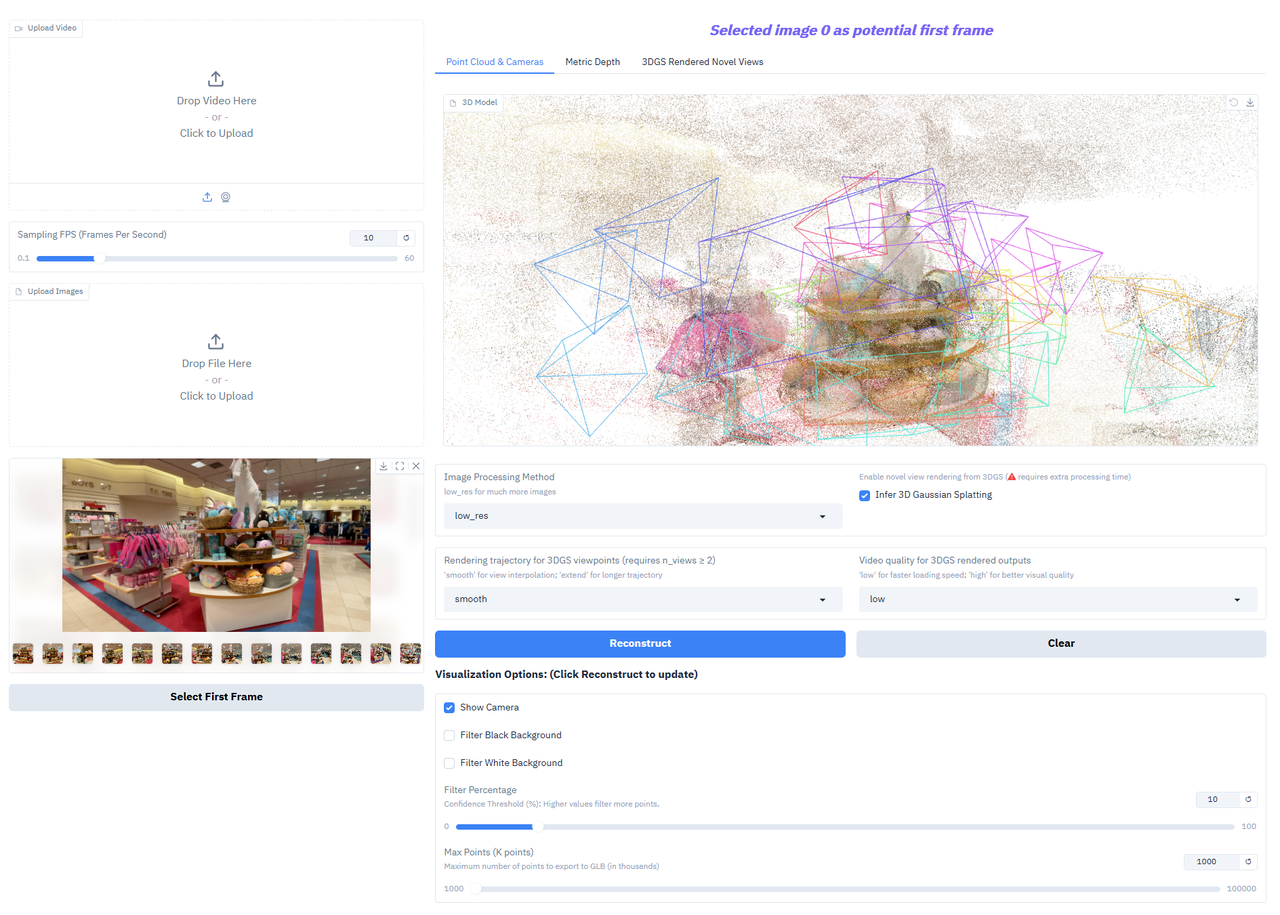

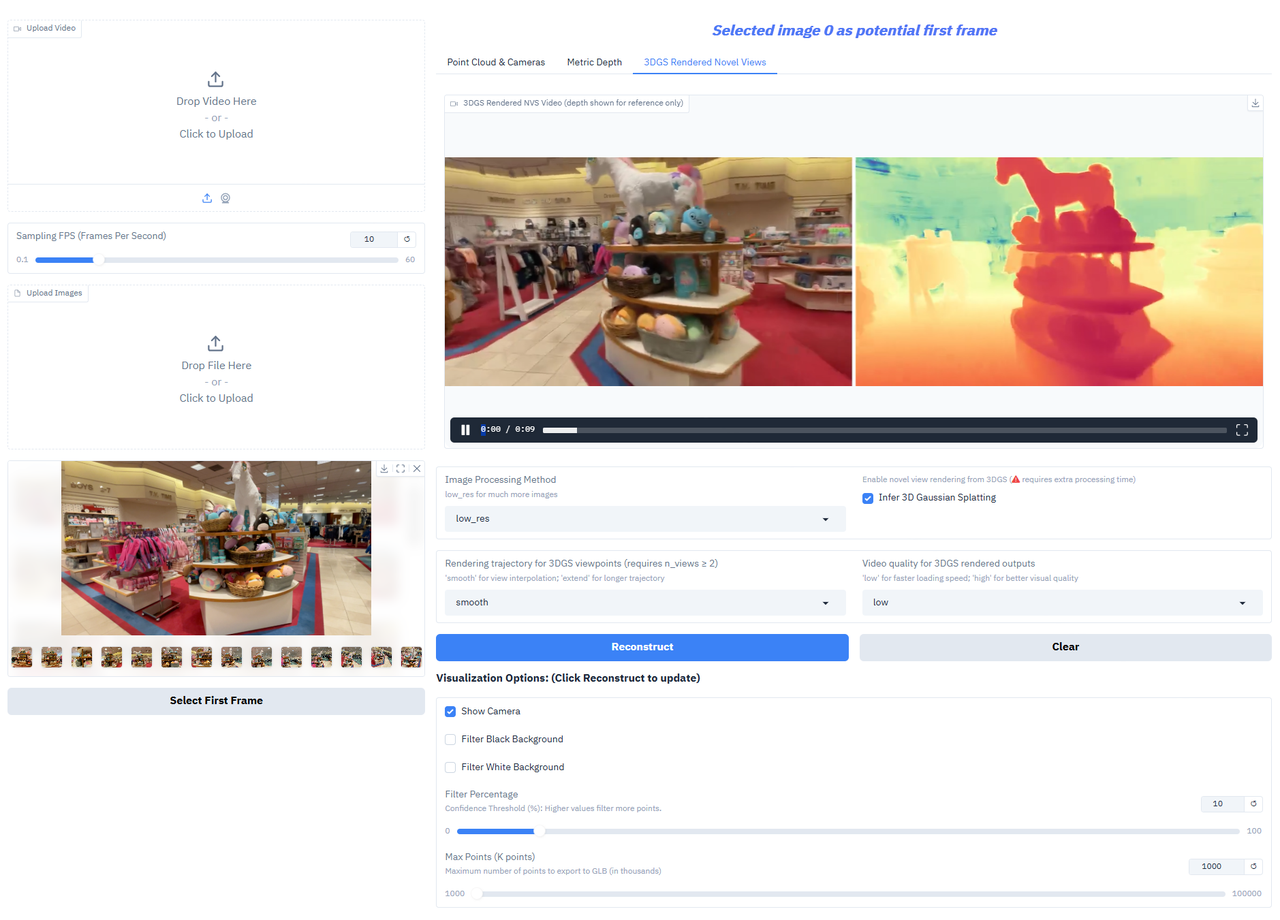

效果展示

三维点云和相机轨迹/位姿(Point Cloud & Cameras)

度量深度图(Metric Depth)

3D 高斯渲染新视角(3DGS Rendered Novel Views)

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)