《第四届数字信任大会》精彩观点:大语言模型10大风险 2025与治理实践

摘要:本文基于ISACA中国2025年度大会演讲内容,重点探讨大语言模型(LLM)安全风险及治理框架。首先列出OWASP发布的LLM十大风险,包括提示注入、数据泄露等新型安全威胁。其次介绍ISO/IEC发布的AI治理国际标准,包括风险管理指南(23894)和首个AI管理体系标准(42001)。最后解析欧盟《AI法案》合规要求,并提出实施AI管理体系的关键步骤:明确角色定位、制定AI管理方针、开展风

背景

观点内容摘取自《第四届数字信任大会暨ISACA中国2025年度大会》嘉宾的演讲与分享,内容代表了演讲嘉宾的经验分享/意见观点。

详细版本PPT更新在ISACA中国区官网。

🚀 第一部分:警钟长鸣 - 大语言模型10大风险 (OWASP TOP 10 2025)

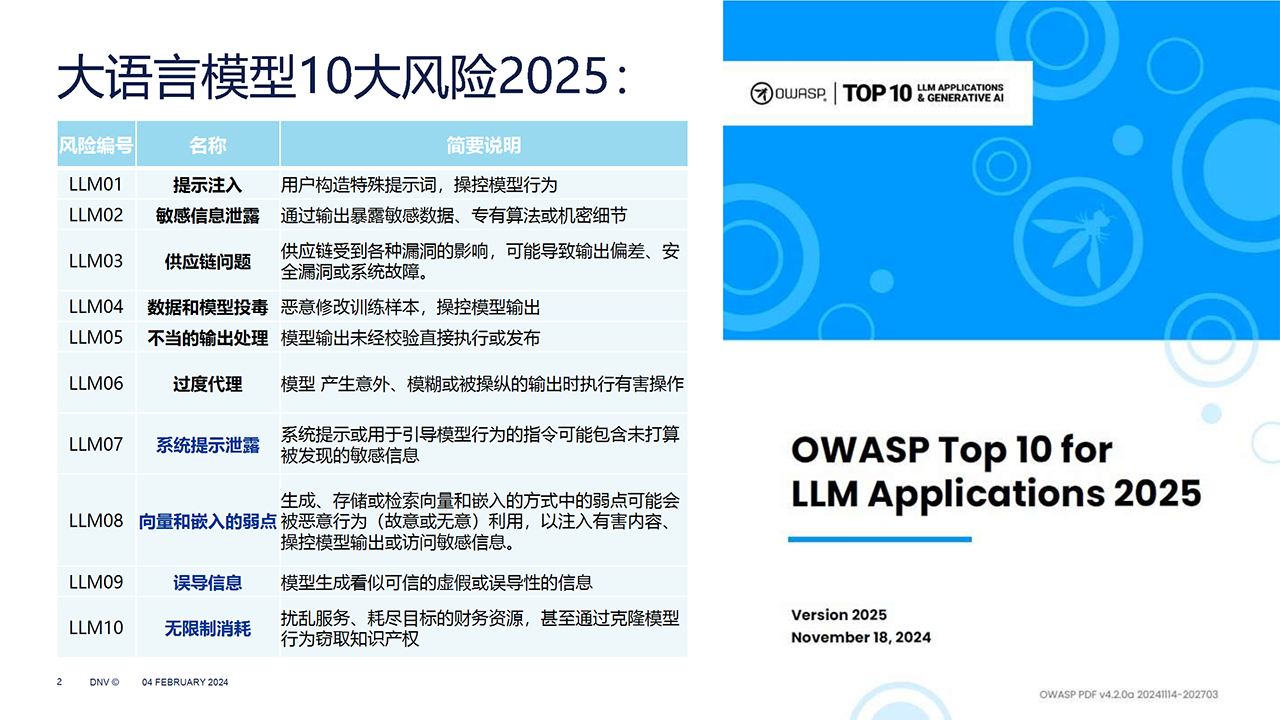

随着大语言模型(LLM)的广泛应用,安全漏洞也呈现出新的形态。OWASP Top 10 for LLM Applications 2025 列出了当前LLM应用面临的十大主要风险

| 风险编号 | 名称 | 简要说明 |

| LLM01 | 提示注入 (Prompt Injection) |

用户构造特殊提示词,操控模型行为 2。 |

| LLM02 | 敏感信息泄露 |

通过模型输出暴露敏感数据、专有算法或机密细节 3。 |

| LLM03 | 供应链问题 |

供应链漏洞可能导致输出偏差、安全漏洞或系统故障 4。 |

| LLM04/05 | 数据和模型投毒 / 不当的输出处理 |

恶意修改训练样本操控模型输出,或模型输出未经校验直接执行/发布 5。 |

| LLM06 | 过度代理 (Excessive Agency) |

模型在产生意外或被操纵的输出时执行有害操作 6。 |

| LLM07 | 系统提示泄露 |

用于引导模型行为的指令可能包含未打算被发现的敏感信息 7。 |

| LLM08 | 向量和嵌入的弱点 |

生成、存储或检索向量和嵌入的方式中的弱点可能被利用 8。 |

| LLM09 | 误导信息 |

模型生成看似可信的虚假或误导性信息 9。 |

| LLM10 | 无限制消耗 |

扰乱服务、耗尽目标的财务资源,甚至通过克隆模型行为窃取知识产权 10。 |

第二部分:AI治理基石 - 国际标准框架

为应对上述风险,国际标准化组织(ISO/IEC)发布了一系列AI治理标准。

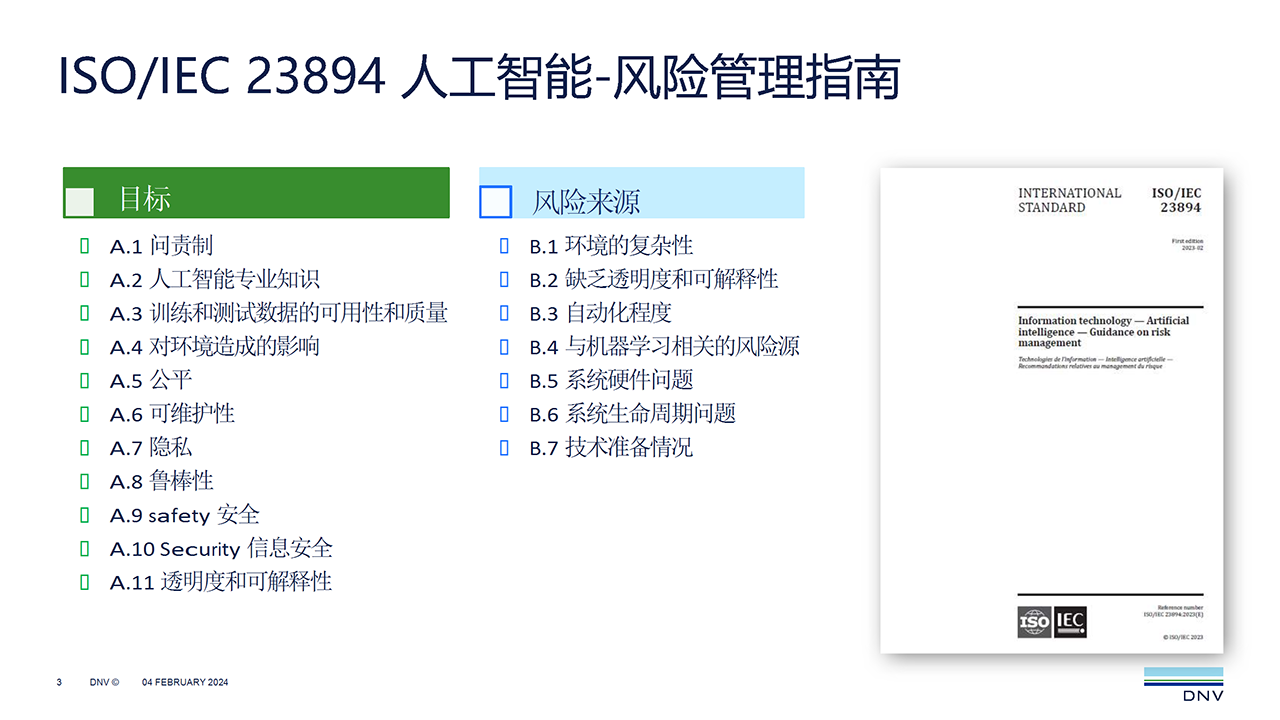

1. ISO/IEC 23894:人工智能-风险管理指南

该标准指导AI风险管理过程应贯穿AI系统的整个生命周期,确保系统的安全、可靠和合规运行 。

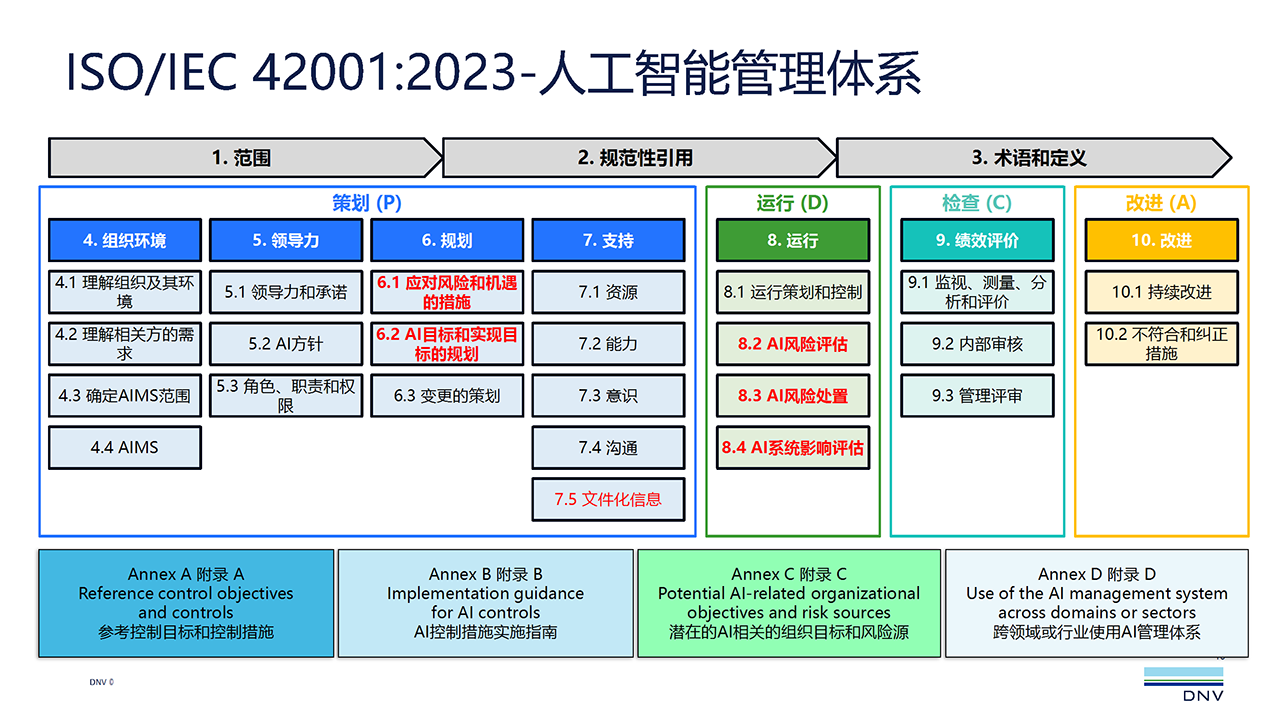

2. ISO/IEC 42001:2023:人工智能管理体系 (AIMS)

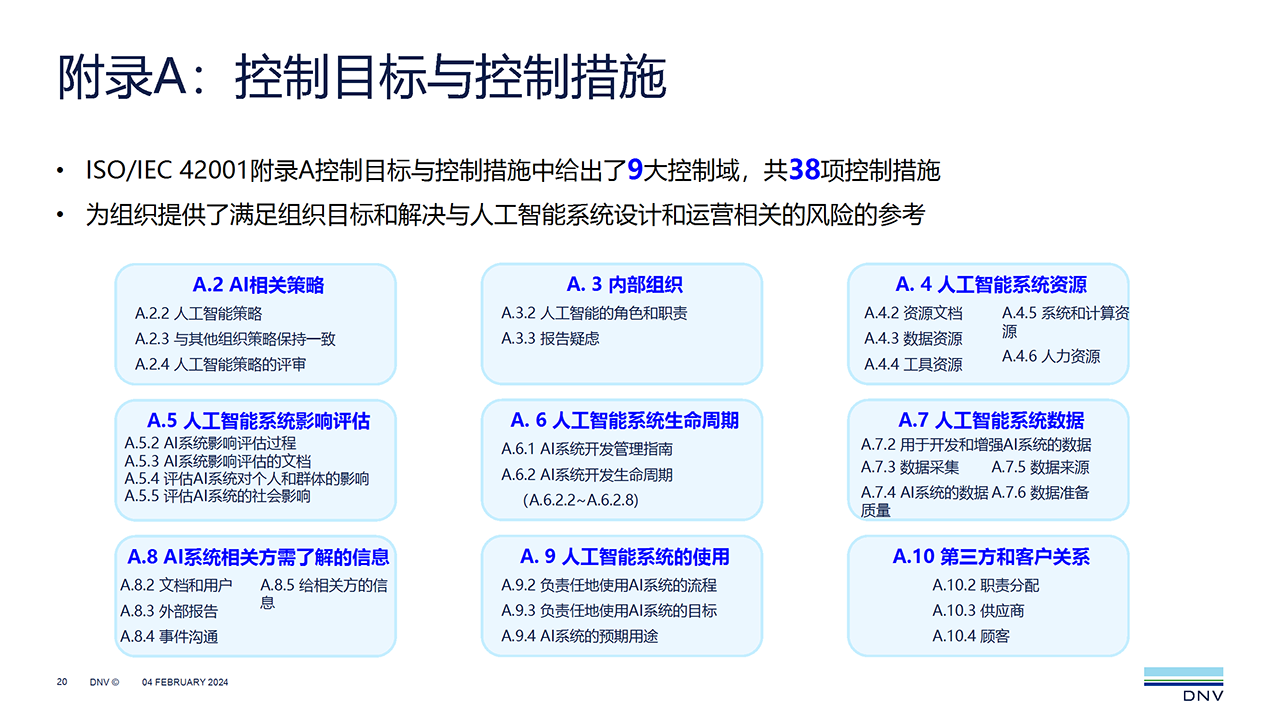

ISO/IEC 42001是首个国际上针对人工智能管理体系(AIMS)的标准,旨在帮助组织以负责任的方式开发、提供或使用AI系统 。

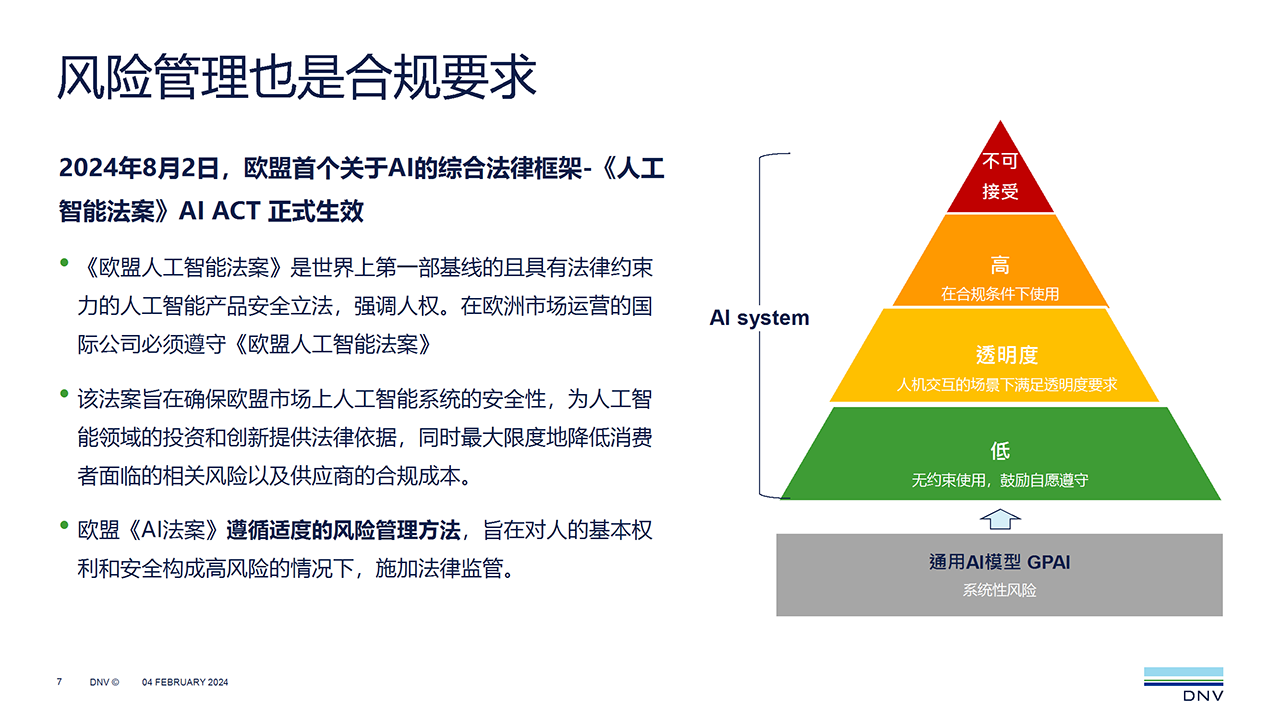

第三部分:法律合规前沿 - 欧盟《AI法案》(AI Act)

法律合规是AI治理的强制性要求。欧盟《人工智能法案》(AI Act)是世界上第一部基线且具有法律约束力的人工智能产品安全立法,已于2024年8月2日正式生效 。

第四部分:AIMS实施关键步骤与核心要素

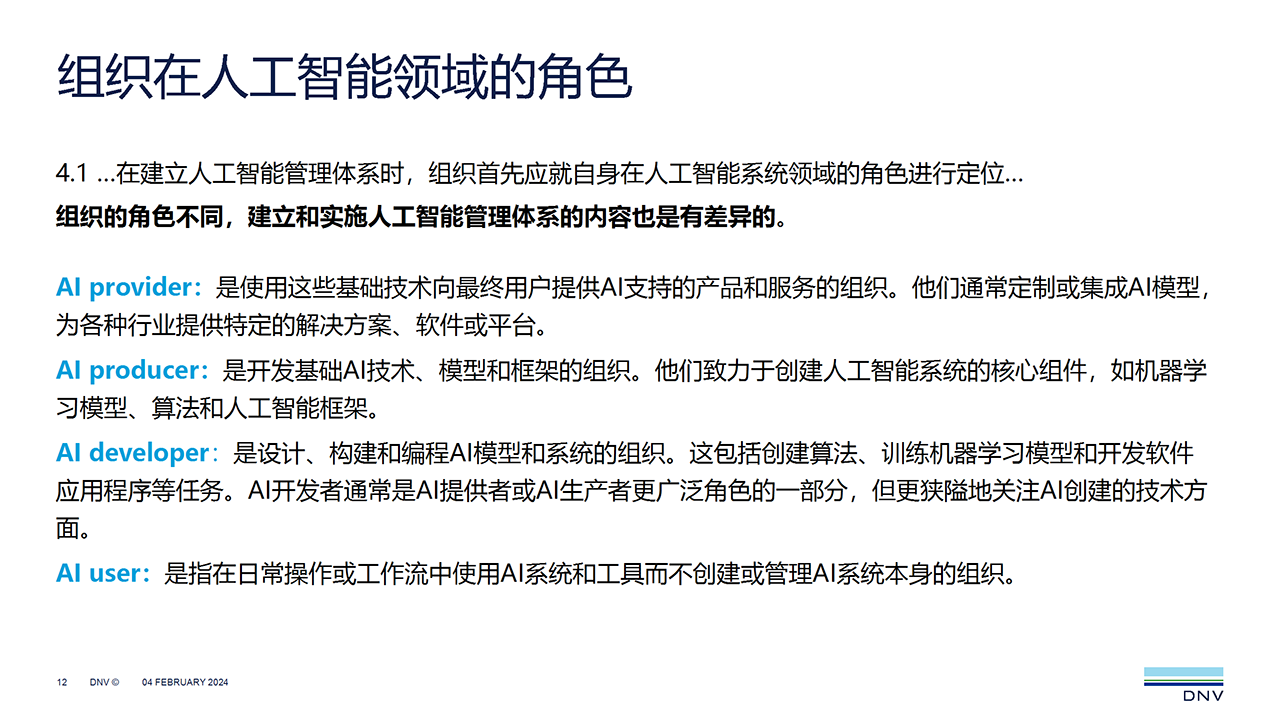

组织在建立ISO/IEC 42001管理体系时,有几个关键步骤必须明确:

1. 角色定位

2. 制定AI方针

最高管理者应制定AI管理方针,它需要结合组织的角色,明确以下要素 33:

-

目标和原则: 明确AI管理的目标、效果和遵循的道德法律标准。

-

数据管理: 确保AI系统使用的数据准确、完整、安全和合法。

-

系统设计: 确保AI系统设计合理、可靠、安全和可维护。

-

透明性和可解释性: 建立机制让人工智能系统的决策过程和结果可透明、可解释。

-

道德和法律合规: 开展伦理风险评估、制定应急预案、遵守隐私保护等措施。

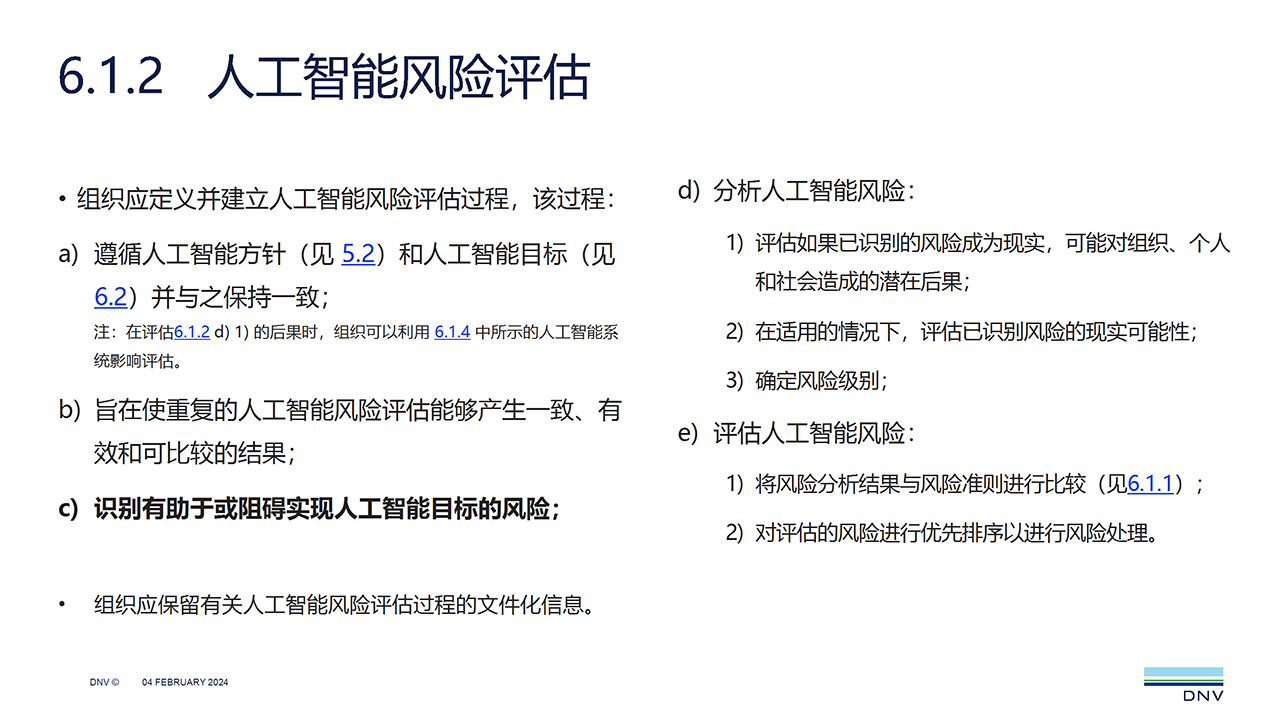

3. AI风险评估与处置

风险管理是AIMS的核心。组织需要建立**人工智能风险评估(AI Risk Assessment)和人工智能系统影响评估(AIIA)**过程 。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)