【LLM工程师进阶】一文掌握“全景图”,构建你的“全栈”AI能力体系!

过去十年,面试考点核心在数据库、操作系统、分布式、算法题——而现在,越来越多企业发现,仅会写代码,不足以驾驭智能系统。 模型上线要算 Token、要控延迟、要做灰度,理解 Transformer 不够,还得会构建 RAG、优化吞吐、排查 OOM、做评估与可观测性。

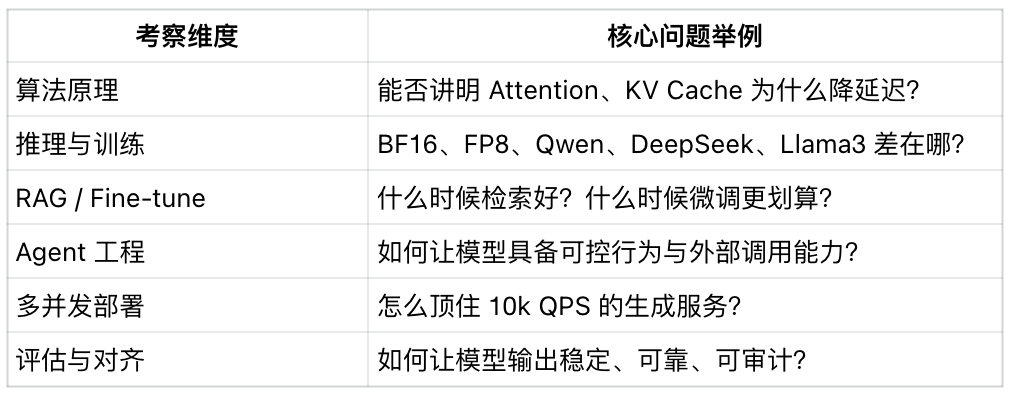

一、为什么大模型岗位正在重塑技术面试规则?

过去十年,面试考点核心在数据库、操作系统、分布式、算法题——而现在,越来越多企业发现,仅会写代码,不足以驾驭智能系统。 模型上线要算 Token、要控延迟、要做灰度,理解 Transformer 不够,还得会构建 RAG、优化吞吐、排查 OOM、做评估与可观测性。

大模型工程师=AI能力 × 工程能力 × 系统交付能力 企业选人看的不是“会不会调 API”,而是:

本文不是入门教程,而是一份面向面试官视角的技术地图: 读完后你会明确知道下一次面试你应该怎么讲、讲到什么层级才算“过关”。

接下来,我们围绕三大面试核心能力展开:

① 算法原理与模型细节 ② 开发实践与工程链路 ③ 部署、并发、监控与企业落地

二、算法原理篇:自注意力、推理加速与训练范式问到什么深度才是合格?

1)Transformer 讲清楚,才能迈入面试门槛

几乎所有面试都会问 —— Attention 工作机制。

你不仅要解释公式,还要回答模型为何可以并行训练、为何比 RNN 更适合长依赖。

回答示范:

Self-Attention 通过 Query/Key/Value 计算 token 间的相关性,得到加权表示; 多头 Attention 允许模型在不同子空间并行建模语义关系; Transformer 结构完全基于矩阵运算,无需序列步进,因此训练可批量并行处理。

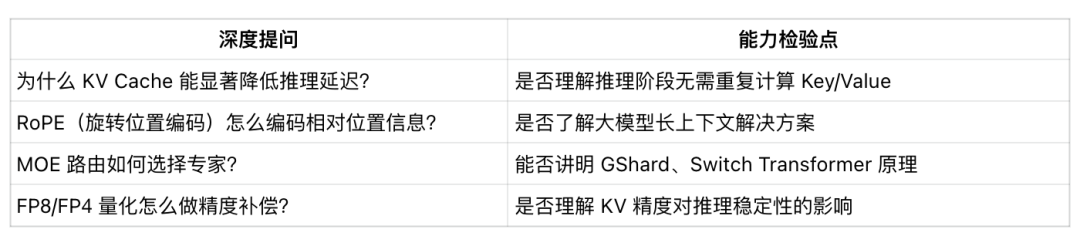

但真正的面试难点在于——深入问你:

如果你能画出 Attention 数据流图、对 KV Cache 优化做定量分析,那在面试官眼里,你已经不是“会模型的人”,而是“能优化模型的人”。

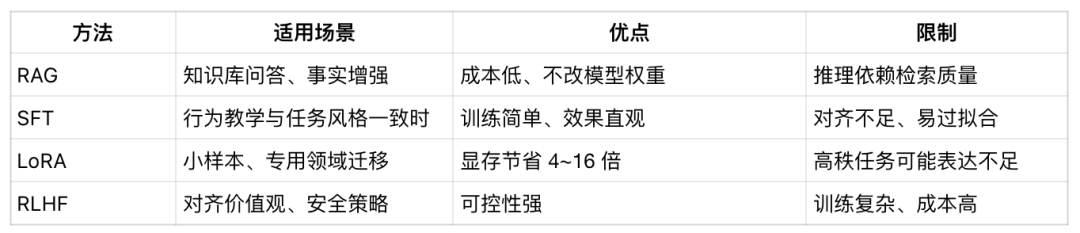

2)训练范式:Fine-Tuning vs LoRA vs SFT vs RLHF

一流工程师不会只说“微调能更贴业务”。

需要回答:

- 什么时候训练?什么时候只做 RAG?

- LoRA 训练降低显存为何有效?Rank 与表达能力关系如何?

- SFT / RLHF 在对齐与可控性中的差异?

清晰答法示例:

回答做到这个颗粒度,面试官会知道你不仅“会跑训练”,还理解为什么这样做。

三、开发实践篇:一个高质量 LLM 服务是如何被构建出来的?

模型是核心,但 能力落地靠工程链路支撑。 如果你的面试回答能从 “代码” → “架构” → “可观测性” → “调优手段” 逐层展开,你会被视为可以接手业务的工程师。

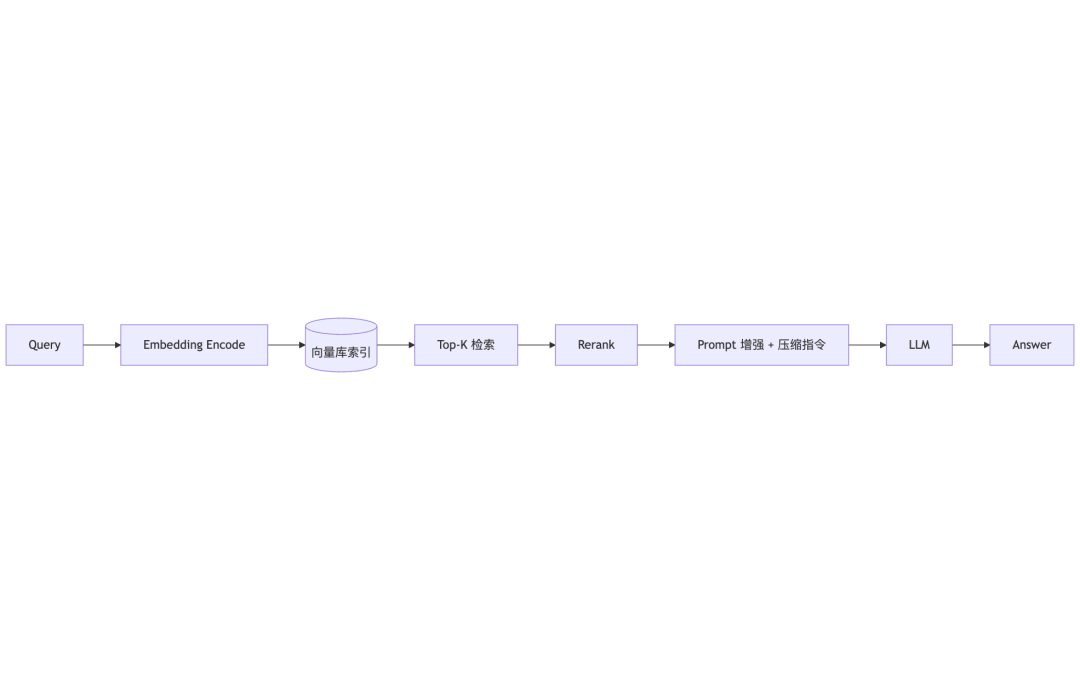

1)RAG 架构你必须讲清楚到可落地

优秀候选人会不仅画流程,还会讲:

- chunk 分块为什么决定召回效果?

- embedding 模型必须与语义空间对齐?

- Top-K 不稳定如何加入重排或 cross rerank?

示例流程 ↓(面试可直接画)

真正的加分点是补一句:

实际业务中 RAG 合格指标不是准确率,而是能够回答/拒答的稳定性与事实一致性,因此要加入 chunk-overlap + 文档可信度评分,并针对失败样本做反向 embedding 扩训。

这句话体现的是线下可验证 + 线上可追踪的工程思维。

2)Agent 与 Function Calling 的设计要点(面试高频区)

你要展示你知道——大模型不是问答工具,而是可控的执行体。

优秀回答应包含:

- 工具 schema JSON 如何设计?

- 什么时候分多 Agent 协作?

- 如何做任务拆解与失败回退?

一个能在面试中脱颖而出的回答方式:

用户 → Planner(任务拆解) → 执行器(并发下单、检索、写库) → 回执与审计

然后你再补一句:

可控智能体的本质不是调用工具,而是可审计、可回滚、可解释的任务执行流程。

这是 CTO 会点头的回答。

3)评估体系是面试最容易拉开差距的部分

多数候选人止步于 BLEU/ROUGE,

但真正的大模型工程师会讲这些:

✔ prompt 回归测试

✔ 行为稳定性(同问多次相似性/漂移率)

✔ RAG 中检索覆盖率/文档证据率

✔ 业务成功率(task-success-rate)

甚至可以给公式:

Success = correct * coverage * stability

能讲出评估体系,你就是能把模型推到生产的人。

四、系统部署篇:10 QPS 到 10k QPS 的大模型服务该如何扩展?

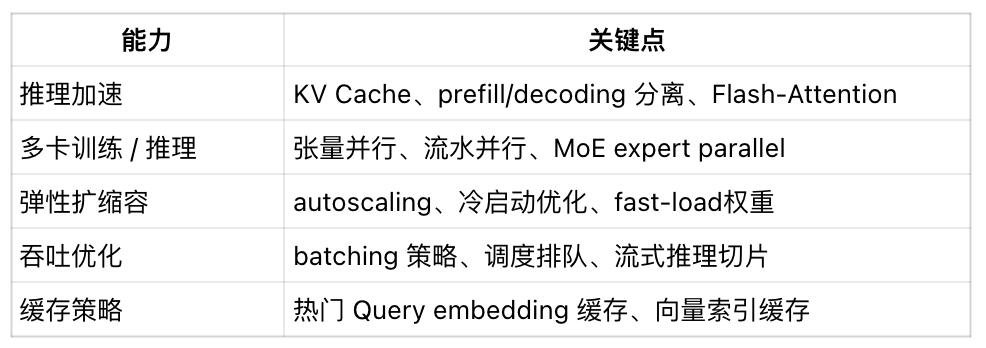

面试官眼里真正有含金量的回答要覆盖:

最容易拿高分的讲解方式:

不谈理论,谈吞吐模型。

示例回答可这样说:

吞吐 TPS ~= batch_size / (推理延迟 × decode_token_cost)

``````plaintext

要提升 QPS:

``````plaintext

1) 加大批量合并请求(动态 batching)

``````plaintext

2) 降低 decode 代价(KV Cache / quantization)

``````plaintext

3) 多副本负载均衡 + 分级缓存

这类结构清晰的回答,面试官会直接写:✔“能驾驭线上环境”。

五、候选人高分表达模板(四句话面试直击要害)

讲原理 → 讲场景选择 → 讲工程落地 → 讲可观测与评估

举例 —— 当被问 “RAG 与微调怎么选?”

知识频繁变动/事实依赖强 → RAG

``````plaintext

行为模式统一/风格约束明显 → SFT/LoRA

``````plaintext

落地关注 chunk overlap、向量空间对齐、Rerank

``````plaintext

上线需引入失败样本回归与证据链路审计

一句话就暴露你是否真的做过生产系统。

那么,如何系统的去学习大模型LLM?

作为一名深耕行业的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

更多推荐

已为社区贡献314条内容

已为社区贡献314条内容

所有评论(0)