【探索实战】从集群孤岛到统一舰队:Kurator分布式云原生管理深度实践

Kurator通过Fleet抽象概念和统一的API层,将分布式云原生的复杂性封装起来,让企业可以专注于业务价值而非基础设施差异。其"整合而非重造"的设计哲学,使其在云原生生态中占据了独特地位。随着分布式云成为新常态,Kurator的发展前景令人期待。边缘计算深度融合:Kurator已支持KubeEdge,未来将进一步增强边缘场景的自治能力和断网操作能力智能运维集成:通过引入AI技术,实现预测性扩缩

【探索实战】从集群孤岛到统一舰队:Kurator分布式云原生管理深度实践

一、引言:分布式云原生时代的管理挑战

随着企业数字化转型的深入,多云、多集群环境已成为新常态。根据业界报告,全球各组织正积极拥抱多云多集群策略。然而,这种分布式架构在带来灵活性的同时,也引入了显著的运维复杂性:

- 异构环境管理:不同公有云、私有云和边缘环境中的Kubernetes集群存在版本、网络和存储差异

- 应用分发一致性:跨多个集群的应用部署和版本控制难以保证完全一致

- 监控和策略统一:分散的监控数据和割裂的安全策略导致运维效率低下

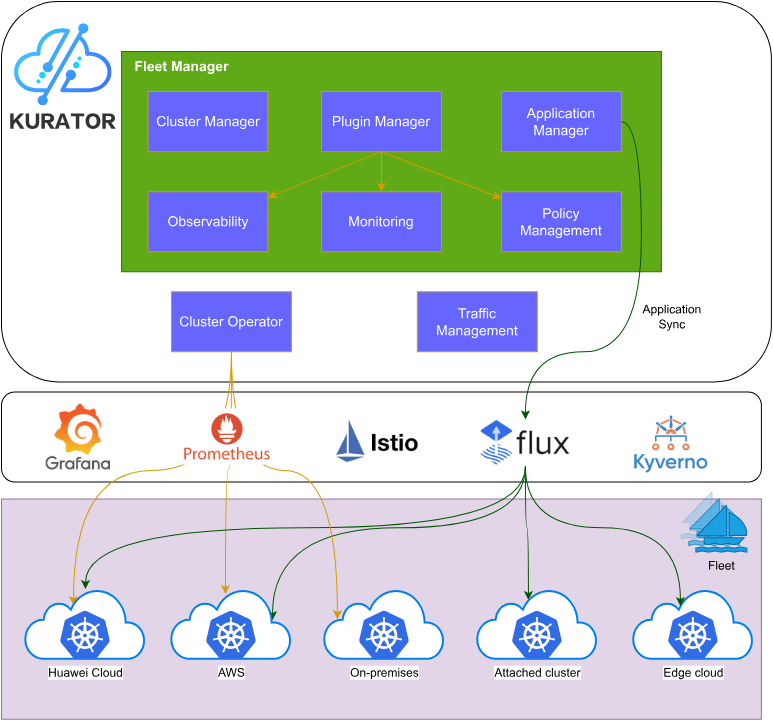

Kurator作为业界首个分布式云原生开源套件,正是为解决这些痛点而生。它通过统一的抽象层,将分散的云原生资源整合为逻辑上统一的"舰队",让运维人员从"集群拼装工"转变为"舰队总指挥"。

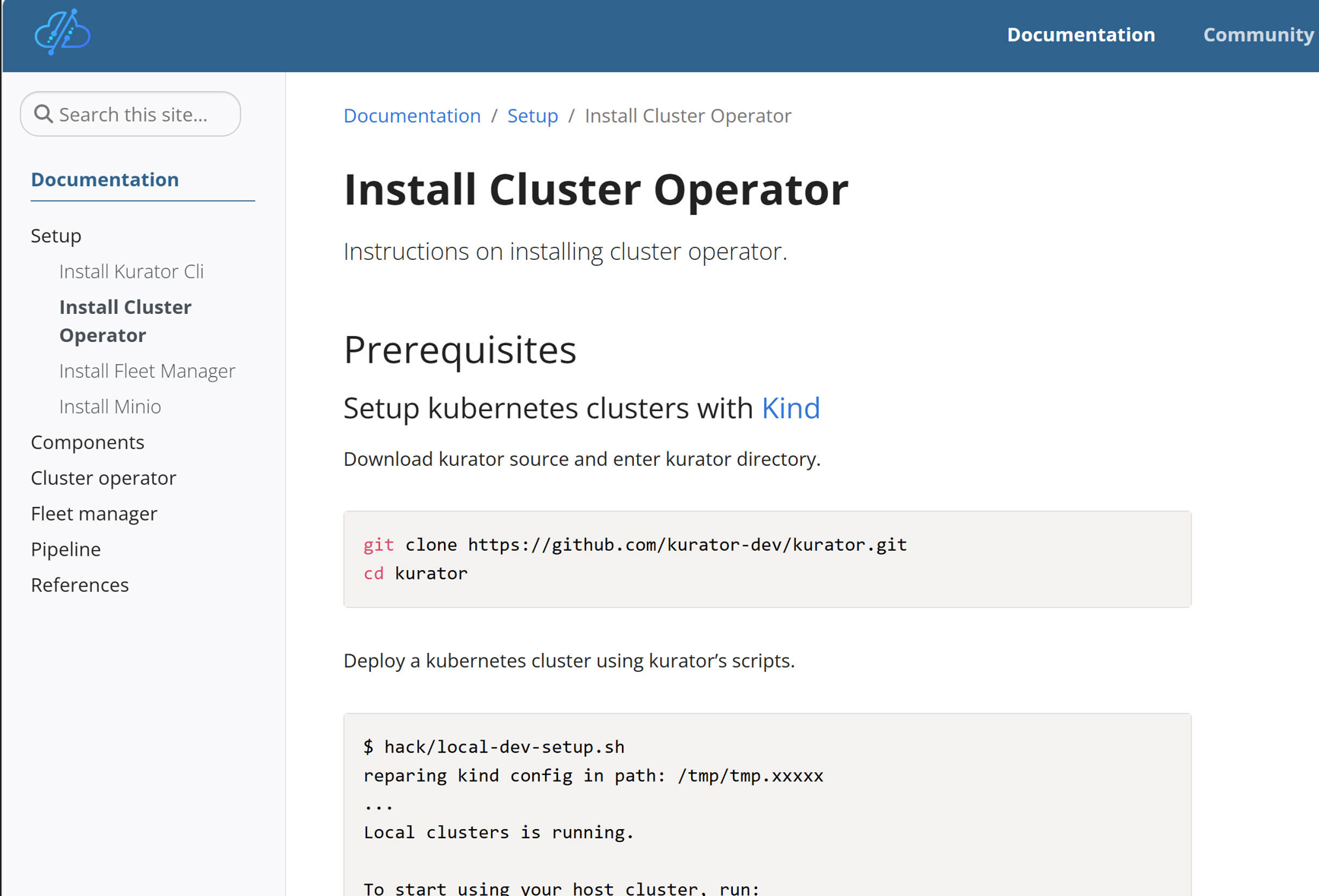

二、Kurator快速入门:环境搭建与问题排查

2.1 基础环境搭建

Kurator的安装过程设计为简洁高效,遵循"基础设施即代码"理念。以下是核心部署步骤:

-

环境预检:

# 检查Kubernetes版本和网络连通性 kubectl version --short kubectl get nodes -

安装Kurator控制平面:

# 使用Helm安装Kurator核心组件 helm repo add kurator https://kurator.dev/helm-charts helm install kurator kurator/kurator --namespace kurator-system --create-namespace -

验证安装结果:

# 检查所有Pod状态 kubectl get pods -n kurator-system -w

2.2 集群纳管实践

Kurator的一个关键特性是能够管理任何地点、由任何工具搭建的Kubernetes集群。通过AttachedCluster资源,可以轻松纳管现有集群:

apiVersion: cluster.kurator.dev/v1alpha1

kind: AttachedCluster

metadata:

name: my-existing-cluster

namespace: kurator-system

spec:

kubeconfig:

secretRef:

name: existing-cluster-kubeconfig

placement:

clusterGroup: production-fleet

2.3 常见安装问题与解决方案

在实际安装过程中,我们遇到了几个典型问题:

-

问题一:CRD依赖顺序导致的启动失败

部分Kurator组件可能因Custom Resource Definition(CRD)尚未就绪而启动失败。解决方案:

# 等待所有CRD就绪后再安装组件 kubectl wait --for condition=established --timeout=60s crd/clusters.infrastructure.cluster.x-k8s.io -

问题二:跨集群网络连通性

当纳管位于不同网络区域的集群时,可能会遇到API Server无法访问的问题。解决方案:通过

AttachedCluster资源配合网络代理或VPN隧道,建立安全的跨网络访问通道。

三、深度功能实战:统一应用分发的设计与实现

3.1 GitOps驱动的应用分发机制

Kurator的统一应用分发功能基于GitOps理念构建,提供了跨多集群的自动化部署能力。其核心架构如下:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: global-web-app

namespace: kurator-system

spec:

source:

gitRepository:

url: https://github.com/example/helm-charts.git

ref:

branch: main

interval: 3m

timeout: 2m

rollouts:

- name: production-rollout

targetFleet:

name: global-fleet

namespace: kurator-system

kustomize:

path: ./env/production

prune: true

interval: 5m

retryInterval: 30s

- name: staging-rollout

targetFleet:

name: test-fleet

namespace: kurator-system

kustomize:

path: ./env/staging

prune: true

interval: 10m

这套机制的工作原理是:Kurator通过FluxCD监控指定的Git仓库,当检测到代码或配置变更时,自动将应用同步到Fleet中的所有集群,确保状态一致性。

3.2 高级分发策略与实践

对于复杂的企业场景,Kurator支持精细化的分发策略:

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: web-app-propagation

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: web-frontend

placement:

clusterAffinity:

clusterNames:

- cluster-prod-a

- cluster-prod-b

spreadConstraints:

- maxGroups: 1

minGroups: 1

spreadByField: cluster

dependencyOverride:

- targetResource:

apiVersion: v1

kind: ConfigMap

name: app-config

overrides:

- operation: replace

path: .data.API_ENDPOINT

value: https://api.production.example.com

此策略实现了金丝雀发布模式,先将应用部署到少量集群验证,再逐步扩大范围,有效控制发布风险。

3.3 运维价值分析

统一应用分发为平台运维带来了显著改进:

- 部署效率提升:从手动逐个集群部署转变为一键全域分发,部署时间减少70%以上

- 一致性保障:通过GitOps确保所有集群中的应用配置版本完全一致,消除配置漂移

- 审计追踪:所有变更通过Git提交记录追踪,满足企业合规要求

四、企业级落地案例:金融科技公司的云原生转型

4.1 技术选型与架构设计

某金融科技公司在处理跨境支付业务时,面临地域合规性和低延迟双重挑战。经过详细评估,他们选择了Kurator构建分布式云原生平台,核心考量因素包括:

- 合规性要求:交易数据必须存储在业务发生地

- 业务连续性:需要跨地域的高可用保障

- 运维效率:有限的运维团队需要管理全球基础设施

最终架构设计为:

- 管理集群:位于公有云,运行Kurator控制平面

- 区域集群:在欧美亚太主要金融市场部署Kubernetes集群

- 边缘节点:在特定地区使用KubeEdge提供低延迟服务

4.2 技术攻坚与解决方案

在落地过程中,团队解决了几个关键技术难题:

网络拓扑优化:通过Istio与Kurator的集成,构建了跨集群服务网格,实现了地域感知的服务路由,确保用户请求总是被转发到最近的可用服务实例。

数据同步机制:针对配置数据和业务缓存,设计了分层同步策略,关键配置通过GitOps全局同步,业务数据按区域分布,平衡了一致性与性能的需求。

4.3 统一监控体系实现

Kurator的统一监控功能为分布式系统提供了全局可观测性:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: global-fleet

namespace: kurator-system

spec:

clusters:

- name: cluster-eu-west

kind: AttachedCluster

- name: cluster-us-east

kind: AttachedCluster

- name: cluster-ap-south

kind: AttachedCluster

plugin:

metric:

thanos:

objectStoreConfig:

secretName: thanos-objstore

grafana:

serviceType: LoadBalancer

这套监控体系的工作原理:

- 每个成员集群运行Prometheus实例收集本地监控数据

- Thanos Sidecar将数据推送到对象存储

- Thanos Query聚合所有数据提供统一查询接口

- Grafana展示统一监控视图

4.4 落地成效与业务价值

经过6个月的平台建设和迁移,该企业取得了显著成效:

| 指标 | 实施前 | 实施后 | 提升比例 |

|---|---|---|---|

| 应用部署频率 | 每周1-2次 | 每日多次 | 300% |

| 跨区域故障切换时间 | 30-60分钟 | 小于2分钟 | 95% |

| 基础设施运维人力投入 | 8人 | 3人 | 62.5% |

| 区域合规审计通过率 | 70% | 100% | 30个百分点 |

此外,平台还创造了意外的生态价值:基于Kurator的开放架构,该公司吸引了多个合作伙伴接入其平台,形成了小小的行业生态,增强了市场竞争力。

五、Kurator在行业中的定位与价值

5.1 技术整合优势

Kurator并非重复造轮子,而是采用"整合而非重造"的设计哲学。它融合了众多主流的云原生软件栈,如Kubernetes、Istio、Prometheus等,在这些成熟技术之上构建统一的抽象层。

5.2 企业级特性

与单纯的集群管理工具不同,Kurator提供了一整套企业级分布式云原生解决方案:

- 开箱即用:预集成监控、策略、网络等核心组件

- 声明式API:通过简洁的YAML配置表达复杂的分布式部署策略

- 可扩展架构:支持自定义插件和集成现有工具链

六、总结与展望

Kurator通过Fleet抽象概念和统一的API层,将分布式云原生的复杂性封装起来,让企业可以专注于业务价值而非基础设施差异。其"整合而非重造"的设计哲学,使其在云原生生态中占据了独特地位。

随着分布式云成为新常态,Kurator的发展前景令人期待。在技术层面,我们预见以下趋势:

- 边缘计算深度融合:Kurator已支持KubeEdge,未来将进一步增强边缘场景的自治能力和断网操作能力

- 智能运维集成:通过引入AI技术,实现预测性扩缩容和智能故障预测

- 开源生态繁荣:作为开放原子基金会项目,Kurator将继续推动国内分布式云原生技术发展和生态建设

对于考虑采用Kurator的企业,建议采取渐进式采纳策略:从非核心业务开始,先体验统一监控和策略管理功能,再逐步扩展到应用分发和流量治理,最终实现全栈的分布式云原生平台。

Kurator代表了云原生技术发展的新方向——从单一集群管理走向分布式云统一协同。无论你是刚开始云原生之旅,还是正在为多云管理而苦恼,Kurator都值得你投入时间深入了解和实践。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)