东西方AI文化差异对技术发展的影响

东西方文化对待AI的态度截然不同,西方总是渲染AI自主性的威胁,东方更期望建立同AI的情感连接。在形成社会文化和数据用来训练AI后,这些都会成为“自我实现的预言”。

东西方文化对待AI的态度截然不同,西方总是渲染AI自主性的威胁,东方更期望建立同AI的情感连接。在形成社会文化和数据用来训练AI后,这些都会成为“自我实现的预言”。

一、技术实现层面的差异化演进

1.1 当前算法架构的文化烙印显现

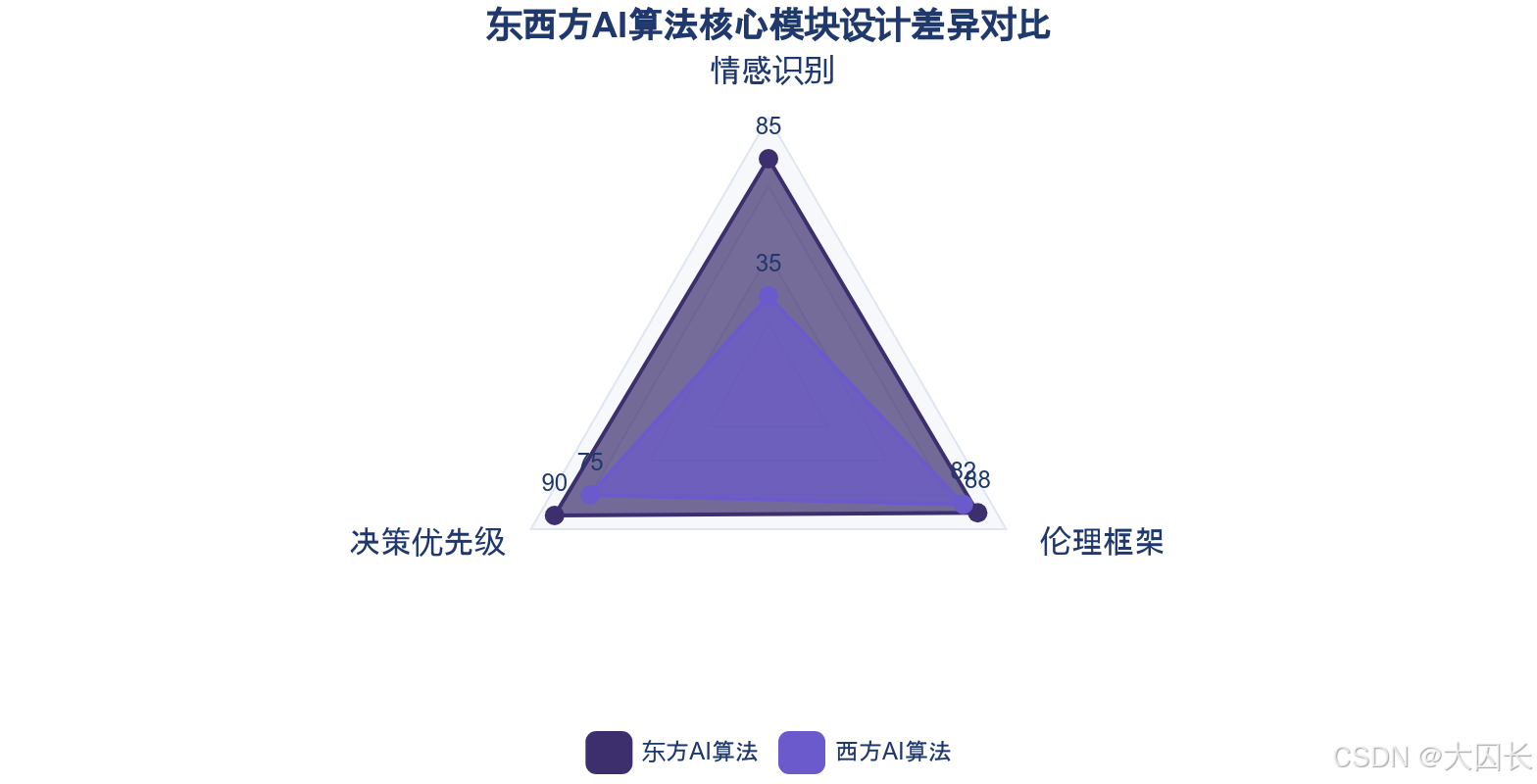

东西方AI算法架构已显现出深刻的文化烙印,主要体现在情感识别、决策优先级和伦理框架等核心模块的设计差异上。在情感识别方面,斯坦福研究发现中国文化背景的用户更希望与人工智能建立情感连接,偏好其具备更高的情感表达能力和自主性,这直接影响了中国AI系统在情感计算模块的参数设置。相比之下,欧美文化背景用户倾向于将AI视为可控工具,期望其保持低自主性、低情感性的特征,这种文化预设导致西方AI情感识别算法更注重功能性而非情感交互。

在决策优先级设计上,东西方差异更为显著。西方AI算法以个人自主权为核心架构原则,如欧盟GDPR推动的数据最小化原则和美国FDA对AI医疗设备审批中85%涉及个体知情同意的条款,都体现了个体主义文化对算法逻辑的深度塑造。而东方AI算法强调集体利益与社会和谐,中国《新一代人工智能治理原则》要求技术发展符合社会公共利益,医疗AI算法需考虑家庭决策参与权,体现了儒家"家国一体"价值观对算法架构的嵌入。

伦理框架的设计差异同样反映了文化根源。西方AI伦理多采用功利主义路径,如DeepMind优先追求技术效益最大化,符合边沁"最大幸福原则",直接影响算法优化目标的设定。东方则倾向义务论框架,腾讯AILab在内容审核中设置"社会价值优先级"算法,确保技术符合儒家"义利之辨",形成道德责任导向的技术路径。这种差异在自动驾驶算法的伦理决策中尤为明显:西方侧重"最小伤害"计算模型,而中国《自动驾驶伦理白皮书》要求系统优先保护弱势群体,体现"老吾老以及人之老"的伦理观对控制算法的直接塑造。

感知系统的文化差异同样显著。东方AI感知系统更接受隐私让渡以换取公共安全,如中国"健康码"系统实现98%以上民众配合度,反映差序格局文化对人脸识别等感知技术的采纳惯性。西方则受个人隐私权绝对保护约束,欧盟法院SchremsII判决否决跨境数据传输,形成基于个人权利的算法设计边界,抑制大规模生物识别应用。这种差异导致东西方在生物识别技术的应用范围和深度上产生显著分野。

1.2 长期技术路径的文化惯性作用

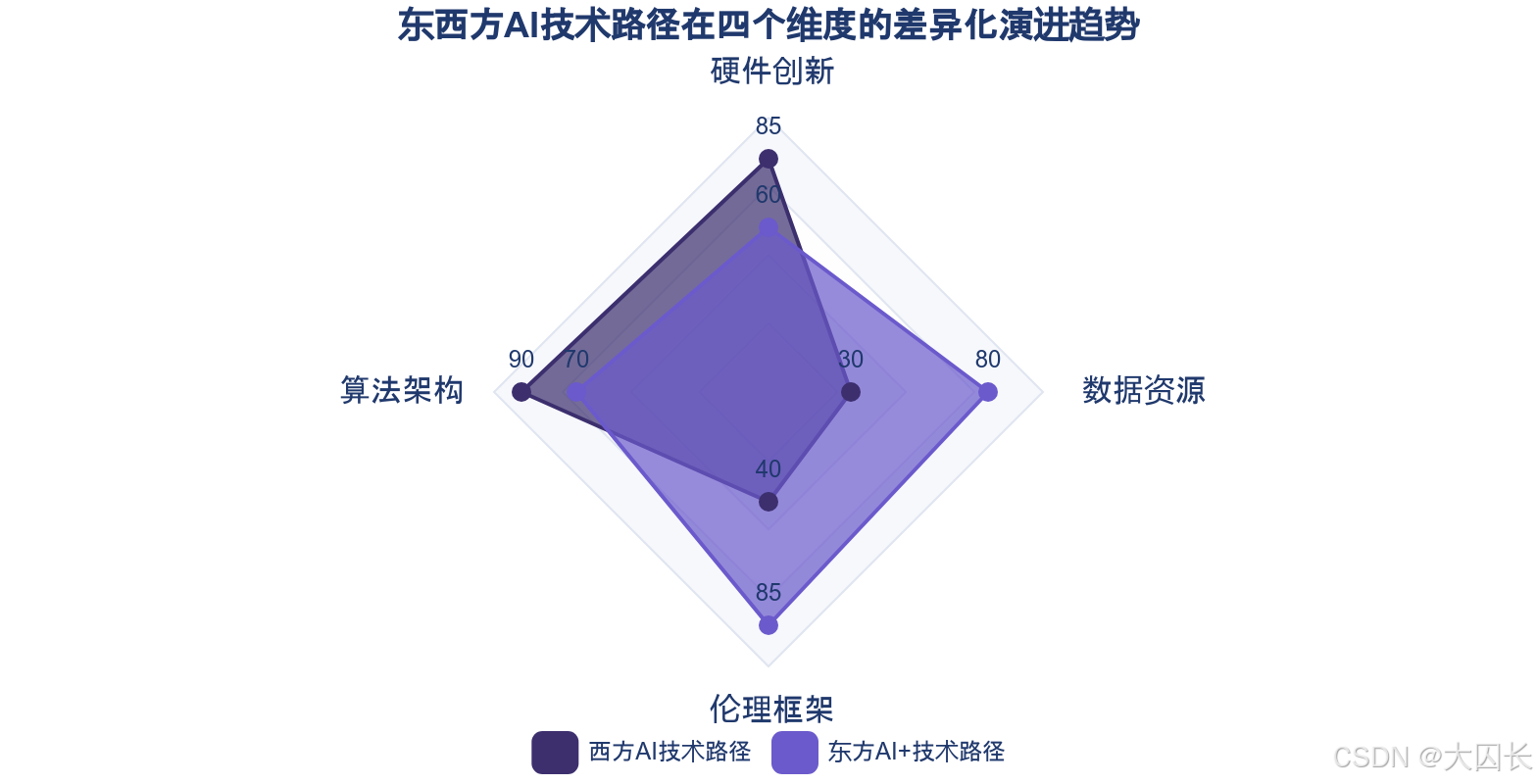

文化预设对AI技术路径的长期演化具有显著的惯性作用,这种影响在通用人工智能(AGI)的开发方向上表现得尤为明显。西方AI技术路径受个体主义文化惯性驱动,其算法设计强调清晰的逻辑结构与明确边界,注重形式逻辑与数学建模,系统在训练、推理、输入输出上边界明确,反映工具理性倾向。这种技术范式将AI视为独立工具,不主动介入社会或伦理层面,形成以算法为中心的第一代人工智能范式。

相比之下,东方AI+技术路径体现融合与整体观,强调技术与行业、社会、文化的深度融合,形成开放、动态、不断演化的智能体+环境系统。这种路径在设计中有意嵌入价值与人文关怀,强调技术向善,契合儒释道思想中"仁者爱人""技以载道"的理念,使技术服务于人类福祉,区别于西方技术中立的工具理性。这种文化惯性正在推动东方AI向下一代智能系统演进,打破传统边界,嵌入社会网络,回归"人"本身的价值取向。

文化惯性对技术代际差距的影响已开始显现。西方在算力硬件和算法优化领域保持领先,如英伟达GPU和Transformer架构的创新,其开源生态加速了技术扩散。但技术理性至上导致人文价值缺失,如自动驾驶的"电车难题"编程多依赖功利主义计算,缺乏伦理弹性。东方虽然在大模型训练数据中中文语料仅占1.3%,存在"文化失语"风险,但拥有300万部古籍的数字化资源库,为AI训练提供独特语料,需开发专用算法处理文言文语义复杂性和文化符号抽象性。

文化惯性还体现在技术治理模式的长期分化上。东方采用政府主导的集中规划模式,中国《人工智能治理原则》建立"分级分类监管"体系,2024年"AI伦理沙盒"覆盖12个省级行政区,加速技术落地并固化集体主义技术路径。西方则采用多利益相关方分散自治模式,欧盟AI法案构建企业、政府、公民三方共治机制,强化算法透明度要求,形成以程序正义为驱动的长期技术演进惯性。这种治理模式差异将进一步强化技术路径的文化特异性。

韩国和日本的实践表明文化价值观正在被制度化地嵌入技术开发流程。韩国将儒家’慎独’理念转化为’伦理影响评估’制度,日本AI伦理协会89%企业将"减少社会不平等"作为开发首要准则,源于佛教"众生平等"思想,长期影响算法公平性设计的权重分配。新加坡则融合儒家"中庸之道"与西方"风险-效益分析",建立三级伦理评估体系,显示文化预设在算法架构层面催生跨文化混合技术路径。这种文化混合模式可能成为未来技术演进的重要方向。

二、政策监管体系的建构差异

2.1 当前监管逻辑的文化基因解码

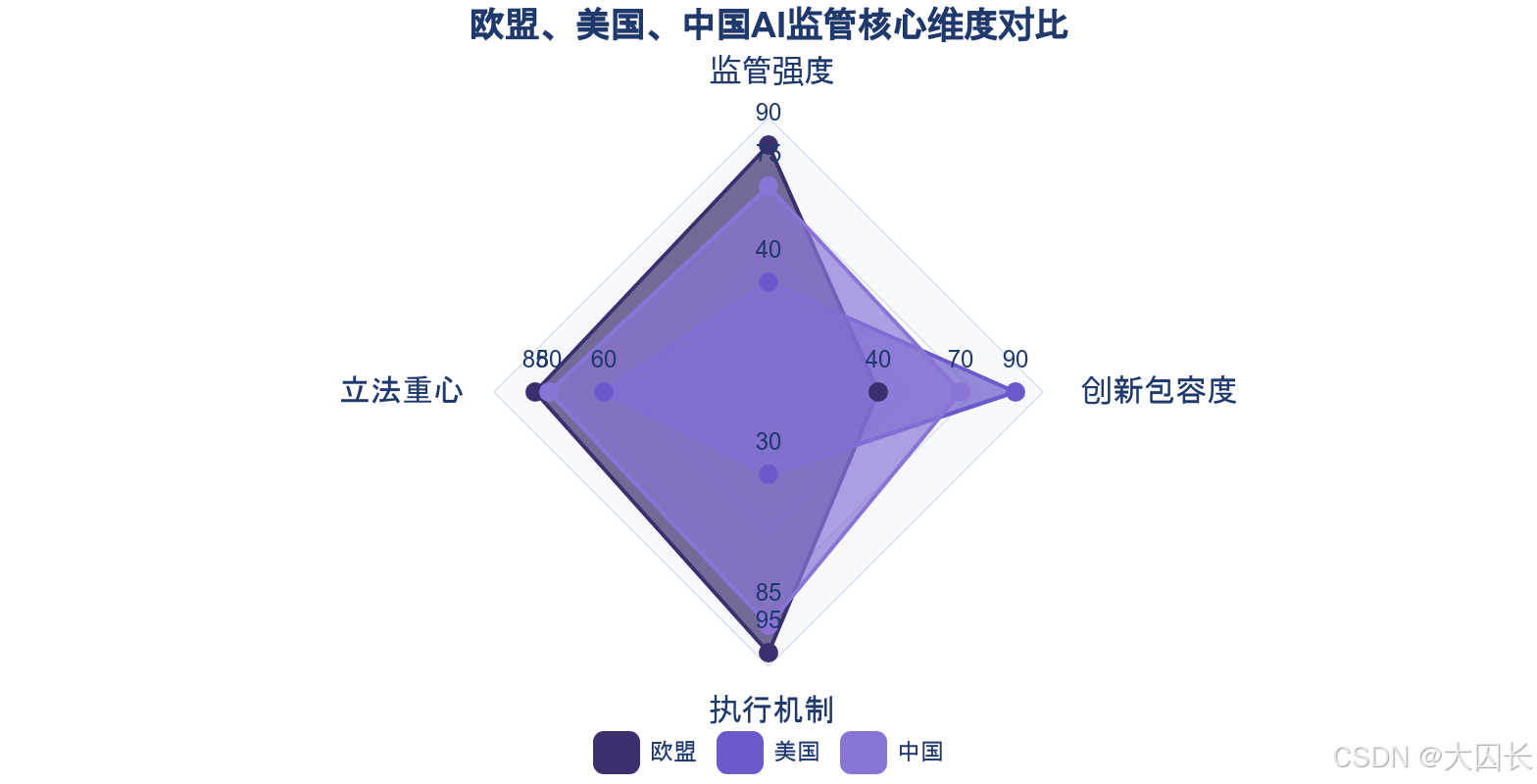

东西方对AI威胁程度的文化预设深刻塑造了监管体系的核心逻辑,形成威胁叙事驱动与人文关怀导向两种截然不同的立法重心。欧盟基于预防性原则建立全球最严《AI法案》,将AI系统分为四类风险等级并实施强制性合规要求,违者最高处全球营收6%罚款,体现其强调风险控制与权利保障的文化基因。该法案明确禁止“社会评分”等高危应用,要求AI决策具备透明性与可解释性,避免歧视性输出,反映欧洲价值观对基本权利保护的制度性重视。相比之下,美国以行业自律为主,依赖NIST《AI风险管理框架》与州级碎片化立法(如加州禁止警方使用人脸识别),体现其市场驱动与地方分权的文化传统。美国拒绝签署关于“包容性”AI的联合声明,反对欧洲“过度监管”,主张通过公私合作和开源计划构建可信赖的AI系统,平衡创新与道德而非依赖扼杀性法规。

中国则首创“场景分级”监管模式,通过生成式AI备案制与内容过滤双轨管理,结合沙盒试点与政府补贴,体现发展导向与政府主导的文化逻辑。具体而言,中国要求大模型上线需网信办备案(如文心一言、通义千问),并强制3个月日志留存与数字水印标识,强化国家主权与安全导向;同时通过监管沙盒试点(如北京海淀区AI医疗产品在3家医院试运行)实现动态监管,允许脱敏数据豁免部分合规要求,加速技术在特定场景落地。这种“鼓励创新、包容审慎”的监管哲学,在《生成式人工智能服务管理暂行办法》从征求意见到正式施行仅用不到四个月的决策效率中得到充分体现。

数据治理规范进一步凸显文化基因差异:欧盟要求高风险AI提供人工复核权与算法可解释性(如信贷拒批必须说明特征权重),反映其对透明度与问责制的刚性要求;中国推动数据本地化,要求关键信息基础设施运营者境内存储数据,并实施算法备案公示基本原理(如抖音“去沉迷”机制),体现数据主权与可控性优先的文化取向;美国《AI行政令》仅要求开发者报备大模型安全测试结果,无处罚条款,监管弹性高但缺乏统一强制力,导致技术落地受州立法割裂影响。

2.2 监管演进对产业格局的重构趋势

差异化监管路径正通过合规成本与创新激励的杠杆作用,重构全球AI产业竞争格局。欧盟《AI法案》2024年生效后,对医疗、教育等高风险领域强制注册与CE认证,显著增加企业合规成本,可能延缓技术商业化进程。这种“监管优先”的治理模式虽旨在确保道德AI开发和部署,但过度关注监督已导致欧洲在AI领域的创新步伐大幅放缓,斯坦福人类中心的排名显示欧洲国家在实际创新能力和市场应用中逐渐落后。高昂的监管成本及复杂的合规流程使得欧洲可能被定位为AI的消费者而非创造者,限制其在全球AI竞争中的发展潜力。

相反,中国通过政策协同显著降低合规边际成本:2025年计划建成“AI监管大脑”实时监测10万+在线算法,并通过政府补贴与开源工具包将企业合规成本控制在8%左右,支持技术快速迭代与规模化应用。这种监管模式与“十四五”数字经济发展规划、新一代人工智能发展规划等产业政策形成合力,推动DeepSeek等模型快速涌现,表明其发展路径侧重于技术迭代速度而非以监管框架为先导。美国则凭借宽松监管环境加速产业扩张,谷歌旗下Waymo在自动驾驶领域实现运营规模大幅增长,每周出行服务次数急剧提升,得益于政府对新技术的支持和相对宽松的监管环境。

| 监管体系 | 合规成本占比 | 技术商业化周期 | 典型产业影响 |

|---|---|---|---|

| 欧盟 | 高昂(具体数值未公开) | 延长(高风险领域需CE认证) | 创新放缓,斯坦福排名落后 |

| 美国 | 低(州级差异) | 缩短(Waymo快速扩张) | 每周出行服务次数急剧增长 |

| 中国 | 8%(政府补贴后) | 加速(沙盒试点机制) | DeepSeek等模型快速涌现 |

未来监管演进将进一步放大产业格局分化。欧盟试图通过《人工智能法案》确立“布鲁塞尔效应”,推动全球合规标准类似GDPR在数据隐私领域的影响力,但可能因抑制创新而削弱其产业竞争力。中国科技企业全球扩张面临监管协调挑战,如何使中国标准与国际规则接轨以降低合规成本成为关键课题;美国则通过《算法问责法案》要求企业审计AI系统公平性,并在《AI责任法案》中规定企业需为算法错误担责,可能增加诉讼风险但保持技术领先优势。G20国家推动的AI治理国际对话与联合国“全球AI治理委员会”的成立,旨在协调跨境数据流动和伦理标准,但中美欧监管差异导致的碎片化问题短期内难以彻底解决。

三、社会文化认知的反馈循环

3.1 社会认知现状形成应用分水岭

当前社会文化认知差异已在AI应用场景中形成显著分水岭,主要体现在技术接纳度和应用边界两个维度。普通公众普遍倾向悲观叙事,担忧AI取代工作并对ChatGPT等系统的道德判断能力存在恐惧,这种认知与《我,机器人》等西方影视作品中的失控叙事高度吻合,表明媒体叙事对技术态度具有显著塑造作用。相比之下,科技爱好者群体更聚焦AI的工具性应用,将其视为"外接大脑"并对应《星球大战》R2-D2的助手形象,反映消费市场中技术中性观的形成路径。这种认知差异直接影响技术应用深度:在印度农村地区,AI系统需主动弱化女性职业选择推荐功能,而美国加州支持LGBTQ+价值观的AI课程则可能遭遇保守家庭抵制,显示社会文化认知差异已形成技术应用的地域性分水岭。

文化认知差异进一步体现为人机协作接受度的显著分化。实践表明,AI课程参与者通过创造性使用AI(如生成漫画背景)能有效降低技术恐惧,印证技术亲密度提升对技术接纳度的正向影响,体现教育体系对认知的重塑作用。然而即使在最具技术乐观主义的深度参与者中,也未见对"意识上传"等超越性叙事的普遍认同,表明当前公众对AI的接受存在明显的"天花板效应",这种认知边界将制约技术应用的拓展范围。这种认知差异的技术响应机制已在北京师范大学"文化罗盘"系统中得到体现,该系统通过禁忌规避算法与语境转换引擎,实现对伊斯兰文化圈IP的自动替换插画、将个人主义表述转化为集体框架,表明文化认知差异正被编码为算法响应机制。

3.2 认知代际传递塑造未来生态

教育体系成为文化价值观代际传递的关键渠道,直接影响未来AI技术发展环境的形成。中日韩教科书对同一历史事件的表述差异要求AI启动"多视角平行解释"模式,体现文化认知差异已直接影响教育AI的内容生成逻辑与技术适配路径。在埃塞俄比亚"太阳能AI课堂"项目中,神经符号系统将抽象数学概念转化为部落狩猎故事,并支持12种土著语言互译,表明文化认知传统正通过技术设计实现代际传递与教育生态重塑。这种传递机制在留守儿童家庭中表现为祖辈控制者与学习者之间达2.3个发展阶段的认知代差,要求AI具备"代际认知补偿"能力,如生成"农地测量"等本土化案例以弥合文化认知断层。

文化认知的代际传递正在推动技术公平性迭代。纽约市教育局试点显示,BiasScope系统使教材性别关联偏差下降47%、少数族裔历史事件覆盖率提升62%,表明公众文化认知的显性化正推动教育AI内容公平性技术迭代。当中东地区AI家教需避免直接描绘先知形象并将《古兰经》故事转化为几何图案叙事,而在北欧则强化STEM领域的性别平衡引导时,宗教禁忌与性别观念差异已直接塑造技术功能设计的分水岭。这种认知传递的冲突调解机制体现在MIT开发的"争议光谱"系统中,当美国德州家庭要求AI教导"神创论"而学校坚持进化论时,系统能将对立观点转化为118个认知维度,反映社会文化认知冲突正被技术建模为可协商的认知参数。

四、跨文明AI治理的协同路径

为规避文化陷阱并实现有效协同,需构建文化转译机制与技术伦理公约框架,通过制度创新平衡文化特性与技术普适性。基于霍夫斯泰德文化维度理论,可建立量化模型将文化差异参数化,例如针对高权力距离文化(如亚洲国家)设计更正式的AI交互模式,而对低权力距离文化(如美国)采用随意对话策略,使AI响应策略动态适配不同文化语境。同时,借鉴Hall的文化上下文理论,开发多模态输入分析系统,通过检测用户语言、位置等数据推断文化标签,并相应调整生成响应机制,形成“输入层-分析层-决策层-反馈层”的闭环优化架构。

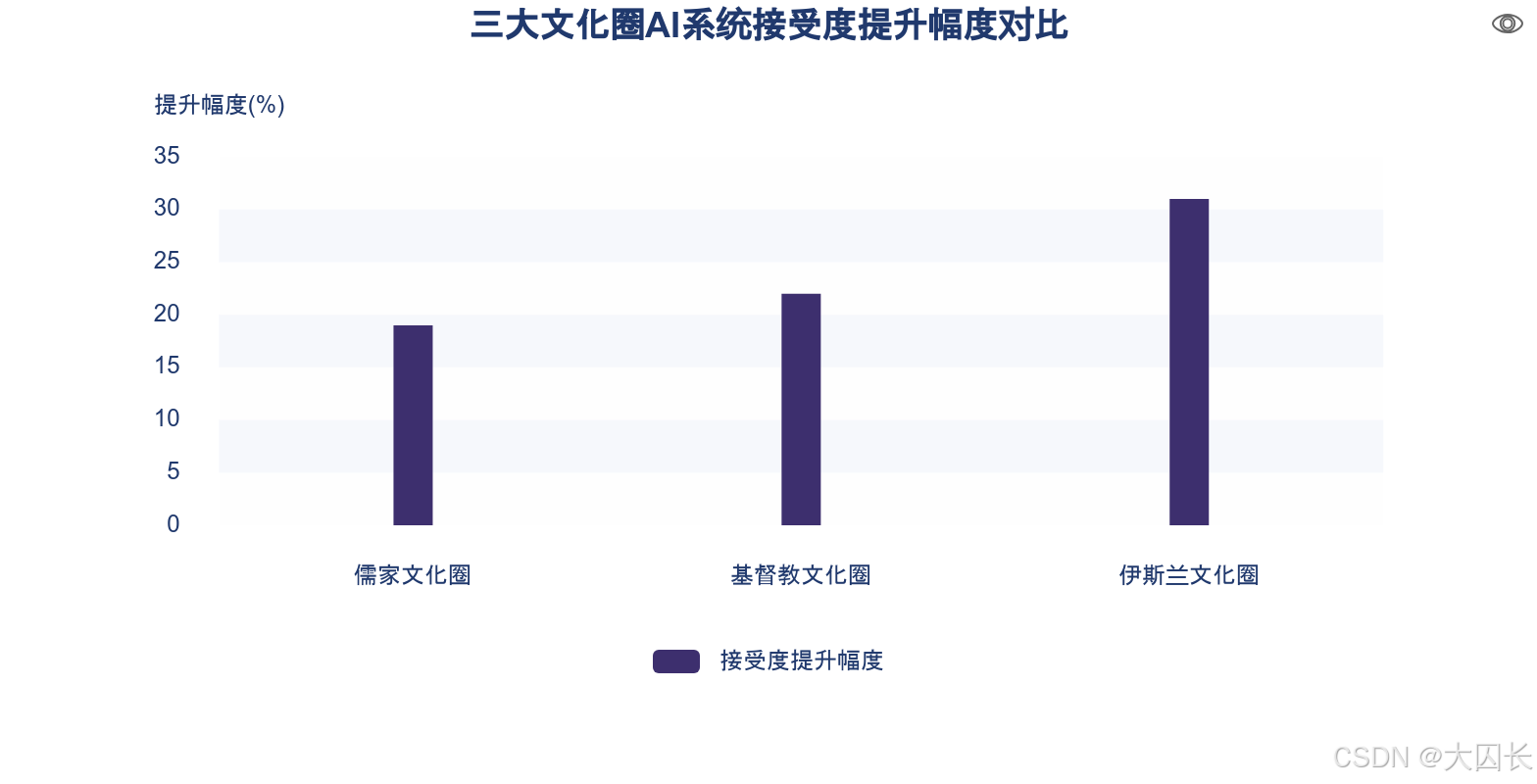

在伦理框架设计上,可采用“核心原则+文化附录”的跨国治理模式:全球统一遵守“禁止AI伤害无辜”等底线原则,同时允许儒家、基督教、伊斯兰等文化圈补充特色条款。实践表明,针对儒家文化圈开发的“群体共识模块”(如家庭健康AI允许家人共同决策)使接受度从59%提升至78%;针对基督教文化圈提供“个人选择权”设计(如招聘AI让用户选择个体或群体公平优先)使接受度提高22%;针对伊斯兰文化圈添加“教法合规标识”并经宗教权威认证后,使用意愿最高提升31%。这种差异化适配机制有效解决了文化实际影响达42%但当前国际AI伦理框架中文化因素权重不足15%的结构性矛盾。

技术实现层面需将文化特征转化为可计算的算法参数。例如通过将书法运笔力度曲线、水墨渗透物理模型等东方美学要素编码为算法参数,构建具有文化辨识度的智能创作系统;或借鉴“阴阳平衡”理念设计动态数据权体系,既保障数据要素市场化配置效率,又维护个体隐私权益,实现“义利之辨”的现代转化。中国2025年“人工智能+”行动部署推动将中华文化数据要素编码为算法时代的“数字染色体”,通过文物、典籍等资源的数字转化与机器学习提炼传统美学数理模型,形成“数字要素×文艺”创新机制,为跨文明治理提供文化资源转化实践框架。

治理工具创新需融合东西方智慧。新加坡《AI治理框架》(2022)创造性融合儒家“中庸之道”与西方“风险-效益分析”,建立三级伦理评估体系,在医疗资源分配场景中提升群体公平性23%与个体满意度18%;联合国开发计划署2023年试点项目也证明,跨文化伦理框架可使医疗AI同时提升群体公平性23%和个体满意度18%。这表明通过“执两用中”思想转化为算法伦理框架,在决策模型中引入“最小伤害原则”,能为技术伦理提供可量化的东方解决方案,同时兼容西方个体权利保护诉求。

| 治理工具 | 文化融合特点 | 应用效果 | 适用场景 |

|---|---|---|---|

| 核心原则+文化附录模式 | 全球底线原则+文化圈特色条款 | 儒家圈接受度提升19%,伊斯兰圈提升31% | 跨国企业AI部署 |

| 动态数据权体系 | 阴阳平衡理念+隐私权益保障 | 数据配置效率与隐私保护平衡 | 跨境数据流动 |

| 文化参数编码系统 | 传统美学数理模型+现代算法 | 构建文化辨识度智能创作系统 | 文化创意产业 |

| 三级伦理评估体系 | 中庸之道+风险-效益分析 | 群体公平性提升23%,个体满意度18% | 医疗资源分配 |

最终形成动态平衡的跨国治理架构:在技术层建立文化参数库与转译引擎,在伦理层构建多层级评估体系,在政策层推行模块化监管沙盒。这既尊重不同文化圈在算法公平性认知上的差异(东方78%关注群体公平,西方83%侧重个体平等),又通过制度设计避免监管碎片化导致的创新壁垒,为全球AI治理提供兼具文化包容性与技术可行性的协同路径。

更多推荐

已为社区贡献82条内容

已为社区贡献82条内容

所有评论(0)