如何通过ollama在安卓手机上部署轻量级视觉语言模型Moondream?

文章详细介绍了如何在安卓手机上通过Termux和Ollama部署轻量级视觉语言模型Moondream。内容涵盖模型版本对比、部署步骤、图片分析技术原理(SigLIP视觉编码器+语言模型)、多种实用分析方法和提示,展示了模型在手机上的实际应用效果。Moondream能在资源有限的设备上运行,通过问答方式分析图片内容,适合移动端AI视觉应用。

在手机上运行 Ollama 通常需要借助 Termux 这类终端应用,并可能需要安装 Linux 环境(本文部署运行ubuntu 25.10),过程相对复杂且对手机性能有一定要求。你也可以考虑使用像 Serval 这样的第三方 iOS 客户端来连接你自行部署的 Ollama 服务器。

🌔Moondream 是一款轻量级的开源视觉语言模型(VLM),能够分析图像并将其与常规人类语言联系起来。它可以观察图片,处理其中的内容(如物体、人物或动作),然后将这种理解与文字联系起来。这意味着你可以给VLM输入一张图片,并要求它执行各种任务,例如描述图片内容、检查图片中物体在做什么,或回答关于图片的问题。

moondream是一个小型视觉语言模型,能高效运行于边缘设备上。下面简要介绍其核心功能、以及在安卓手机上通过Ollama的部署使用moondream:v2的情况,并简要介绍一下识别和分析图片的原理。

🔍 认识 Moondream 模型

Moondream 的核心能力是视觉语言理解,你可以把它想象成一个具备“看图说话”能力的AI。它特别适合在资源有限的设备上运行,这得益于其小巧的模型尺寸。

目前,Moondream 已发布了两个主要版本,其主要对比如下:

| 特性 | Moondream1 | Moondream2 |

|---|---|---|

| 参数量 | 约 16亿 参数 | 约 18.6亿 参数 |

| 视觉编码器 | SigLIP | SigLIP |

| 语言模型 | Phi-1.5 | - |

| 主要特点 | 能够在任何平台运行 | 专为边缘设备设计,高性能 |

🛠️ 如何使用 Ollama 部署和运行

目前,标准的 Moondream 模型主要通过 Hugging Face (https://huggingface.co/vikhyatk/moondream2)的 transformers 库在 Python 环境中使用。好在 Moondream 已被ollama官方库收录,以其统一的方式管理使用模型变得非常简单。

以下是在各自部署方式下与模型交互的基本流程:

# 方式一:通过 Hugging Face Transformers 库(当前主流方式)from transformers import AutoModelForCausalLM, AutoTokenizerfrom PIL import Image# 1. 加载模型和分词器model_id = "vikhyatk/moondream2"model = AutoModelForCausalLM.from_pretrained(model_id, trust_remote_code=True)tokenizer = AutoTokenizer.from_pretrained(model_id)# 2. 准备并编码图像image = Image.open('你的图片路径.jpg')enc_image = model.encode_image(image)# 3. 提出问题,获取答案question = "描述这张图片"answer = model.answer_question(enc_image, question, tokenizer)print(answer)

``````plaintext

# 方式二:如果未来通过 Ollama 部署(假设性命令)# 拉取模型(假设命令)ollama pull moondream2# 运行模型并与图片交互(假设命令)# 注意:具体命令语法需参考届时Ollama的官方文档ollama run moondream2 --image "你的图片路径.jpg" --prompt "描述这张图片"

💬 如何有效地分析图片

Moondream 通过问答(Visual Question Answering) 的方式来分析图片。你可以通过提出不同的问题,引导模型从各个角度挖掘图片信息。

下面的表格列举了一些常见的提问方向和应用场景:

| 分析维度 | 示例问题 | 应用场景 |

|---|---|---|

| 整体描述 | “详细描述这张图片。” | 快速了解图片概貌,用于自动图片标注。 |

| 物体识别与计数 | “图片里有哪些物体?”、“数一下有几只猫?” | 库存盘点、图像内容审核。 |

| 属性与关系 | “那个穿红色衣服的人在做什么?”、“桌子和椅子的相对位置是怎样的?” | 辅助视觉障碍人士、场景深度理解。 |

| 文字识别 | “图片中的牌子上写了什么?” | 提取海报、文档图片中的文字信息。 |

| 逻辑推理 | “根据房间的布置,判断这是哪里?” | 自动驾驶中的场景判断、智能客服。 |

🧠 技术原理简介

Moondream 识别和分析图片的过程可以简单概括为以下两步:

- 图片编码:使用名为 SigLIP 的视觉编码器将输入图像转换成一系列计算机能够处理的特征向量。这个过程可以理解为将像素信息“翻译”成模型能理解的“视觉语言”。

- 文本生成:这些视觉特征向量会和你的问题(文本)一起,送入一个语言模型(如 Phi-1.5)中。语言模型负责综合视觉和文本信息,最终生成一个连贯的答案,完成“看图说话”的任务。

🌔安卓手机运行moondream

在安卓手机上部署LLM,让它完全离线运行是可行的。目前主要有两种主流方法,一种是通过 Termux 模拟 Linux 环境来安装,另一种是使用现成的 AI 应用直接加载。

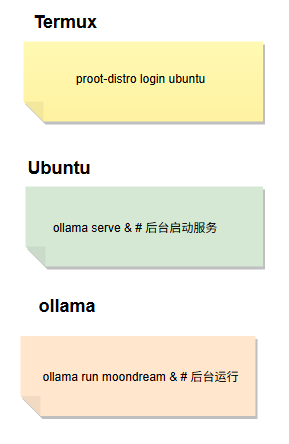

下图为Termux + Ollama 方案运行指令:

进入moondream后,即可与模型对话。

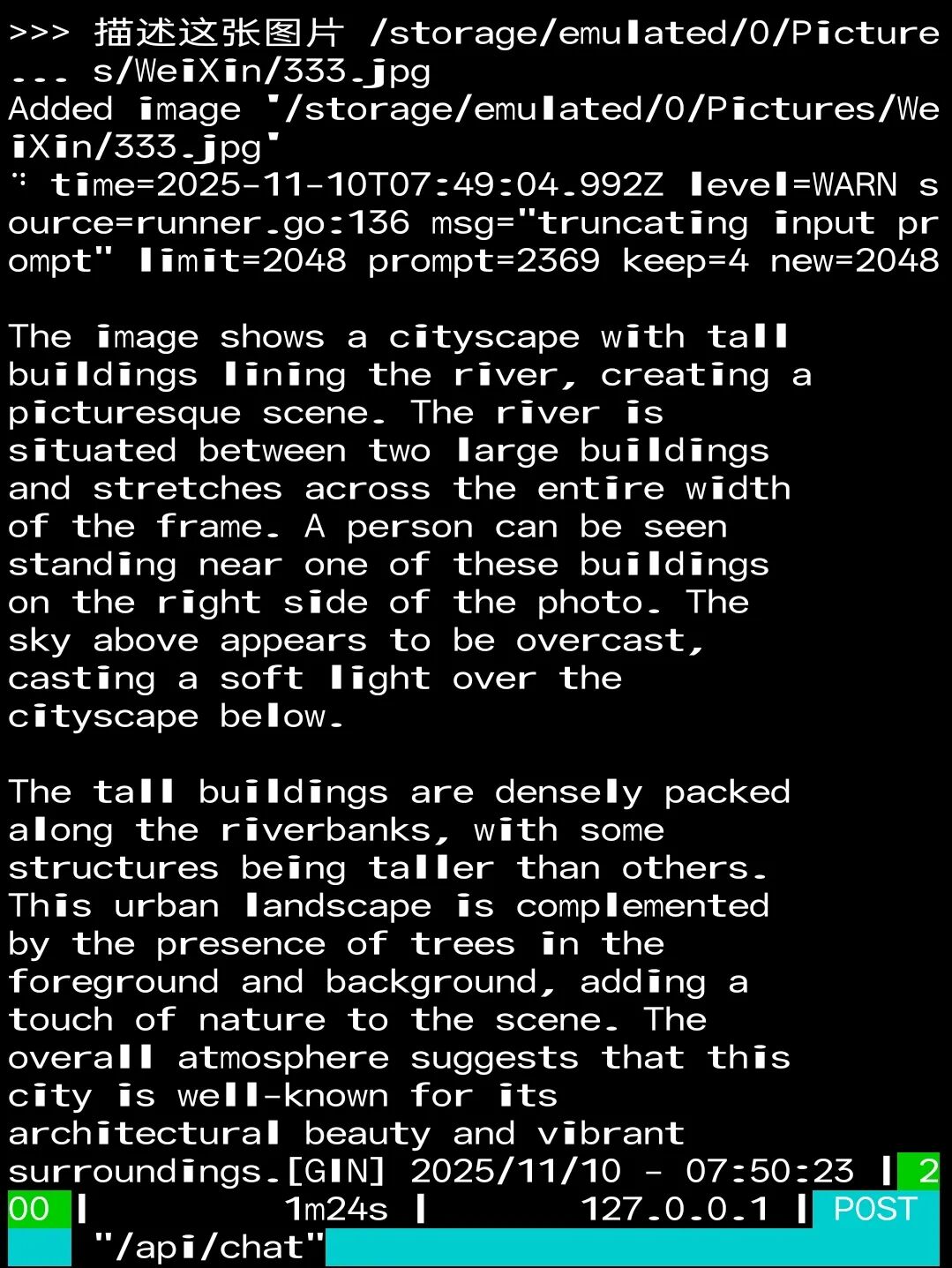

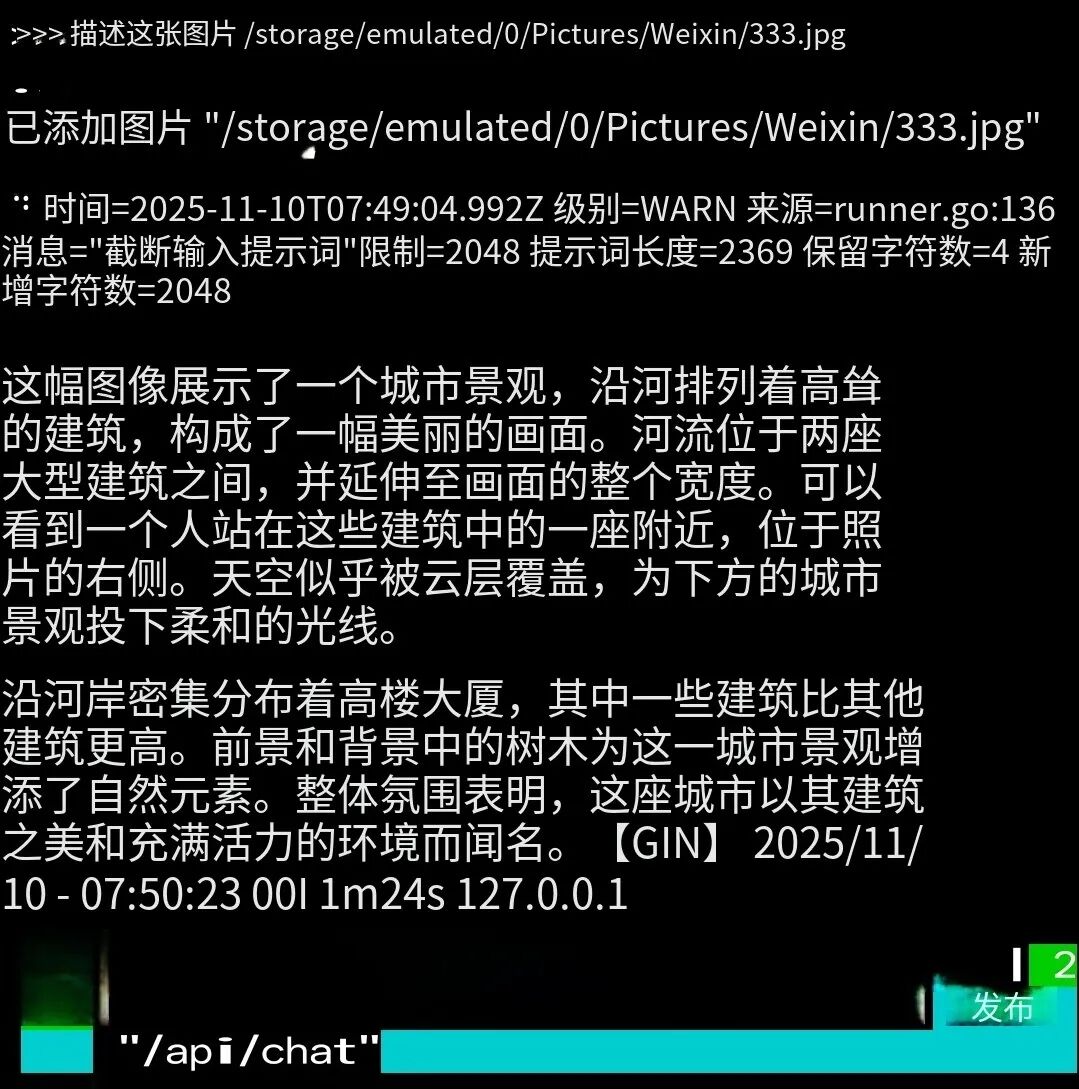

被识别的图片333.jpg来源于手机微信:

moondream能理解中文,但模型直接输出结果只能是英文。

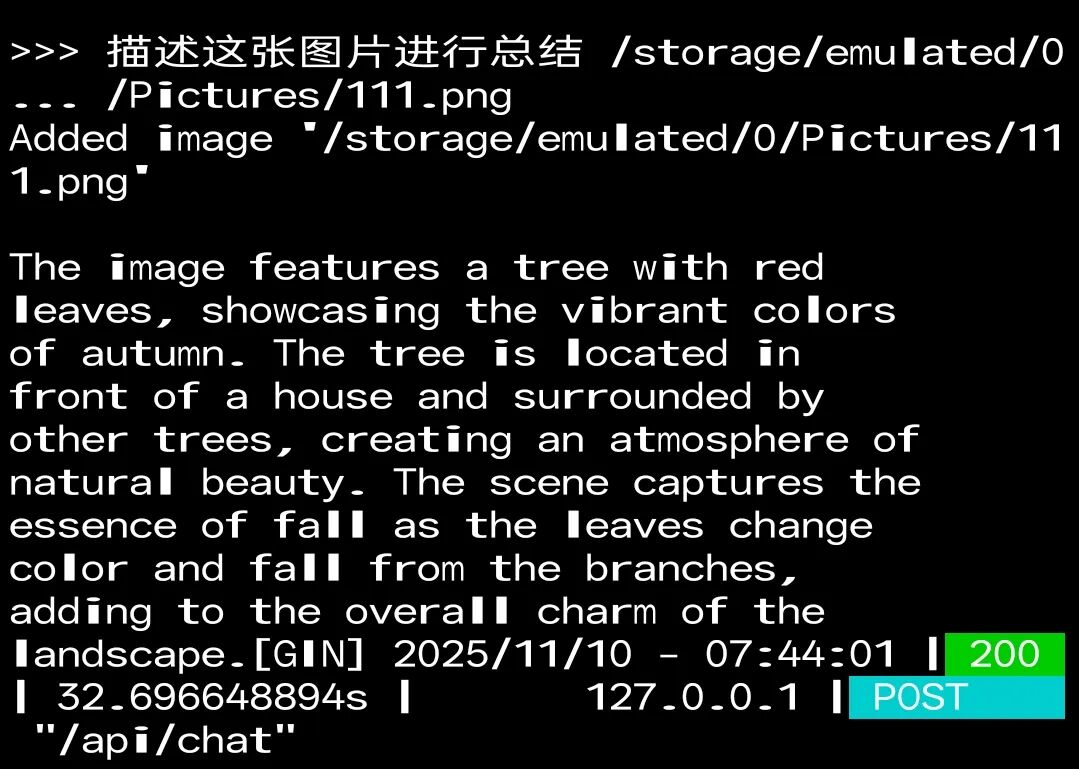

读取手机相册文件111.jpg:

moondream的理解:这幅图像展示了一棵带有红色叶子的树,展现了秋季的鲜艳色彩。这棵树位于一座房屋前,周围环绕着其他树木,营造出一种自然美景的氛围。这个场景捕捉到了秋季的本质,树叶变色并从枝头飘落,为整个景观增添了独特的魅力。

💡 实用提示

- 中文支持:虽然 Moondream 主要针对英文优化,但对于一些常见的中文问题,它通常也能给出不错的回答。在实际使用时,简单的中文问答通常是可行的。

- 保持具体:提问越具体,得到的答案通常也越精确。例如,与其问“这是什么?”,不如问“图片右下角的黑色电子产品是什么?”

- 设备兼容性:由于其小巧的体积,Moondream 在算力有限的设备上(如带GPU的个人电脑,甚至是一些高性能手机)也能良好运行,这也是它的一大优势。

moondream模型可能会生成不准确的陈述,并且难以理解复杂或微妙的指令。该模型可能不完全摆脱社会偏见。在使用模型时应注意这一点,并保持谨慎和批判性思维。如果模型被要求,它可能生成令人反感、不适当或伤人的内容。Moondream 2 需要 Ollama 0.1.33 或更高版本。

AI大模型从0到精通全套学习大礼包

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

只要你是真心想学AI大模型,我这份资料就可以无偿共享给你学习。大模型行业确实也需要更多的有志之士加入进来,我也真心希望帮助大家学好这门技术,如果日后有什么学习上的问题,欢迎找我交流,有技术上面的问题,我是很愿意去帮助大家的!

如果你也想通过学大模型技术去帮助就业和转行,可以扫描下方链接👇👇

大模型重磅福利:入门进阶全套104G学习资源包免费分享!

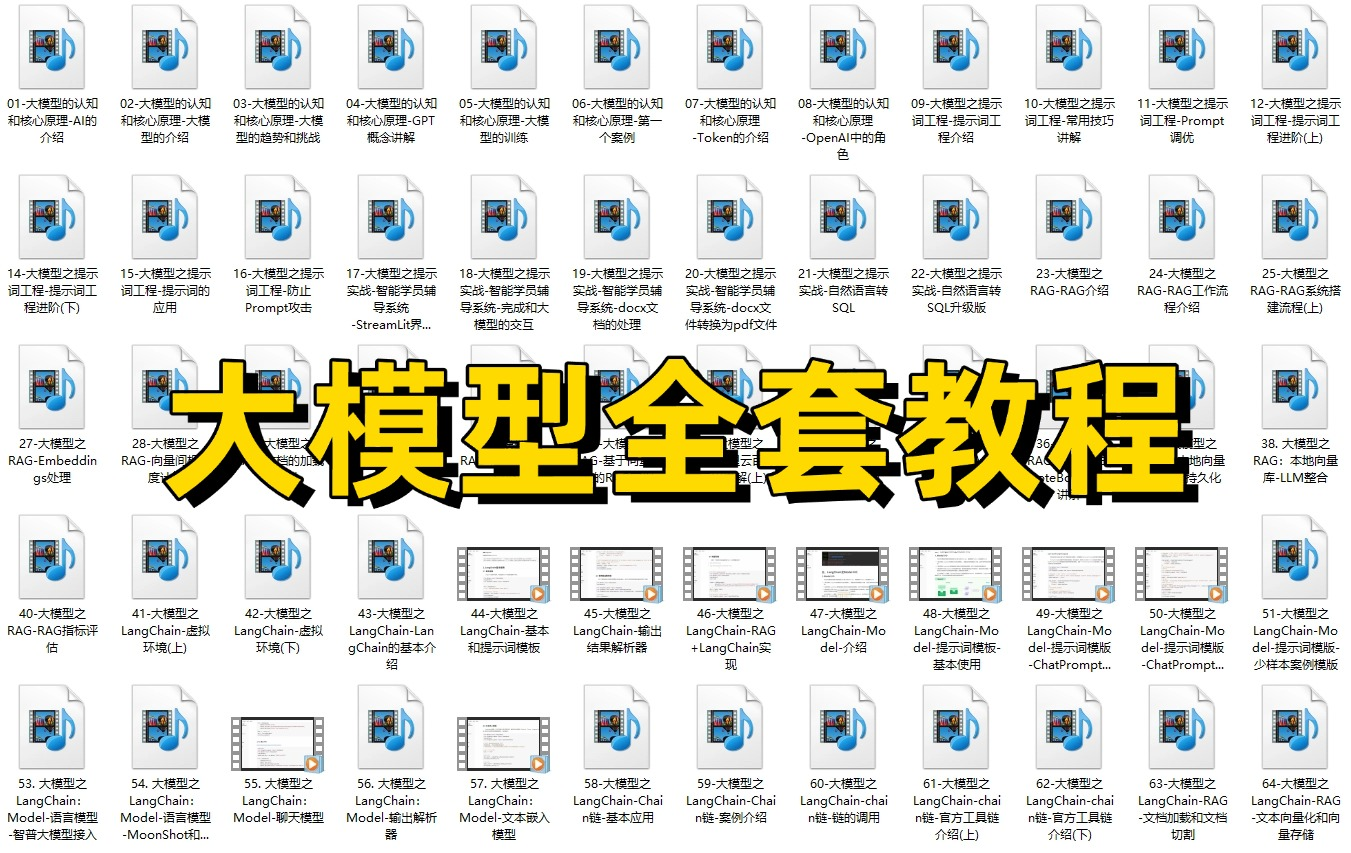

01.从入门到精通的全套视频教程

包含提示词工程、RAG、Agent等技术点

02.AI大模型学习路线图(还有视频解说)

全过程AI大模型学习路线

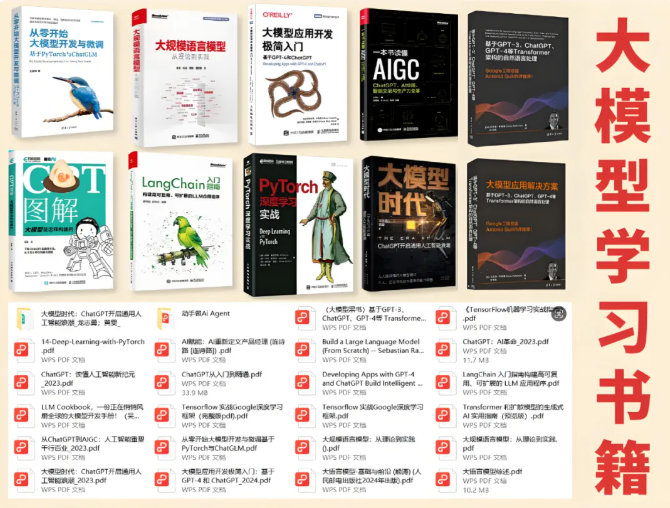

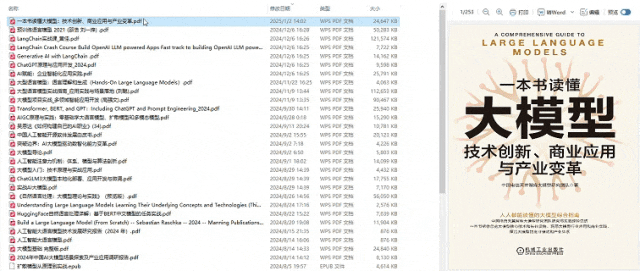

03.学习电子书籍和技术文档

市面上的大模型书籍确实太多了,这些是我精选出来的

04.大模型面试题目详解

05.这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

所有的视频由智泊AI老师录制,且资料与智泊AI共享,相互补充。这份学习大礼包应该算是现在最全面的大模型学习资料了。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

智泊AI始终秉持着“让每个人平等享受到优质教育资源”的育人理念,通过动态追踪大模型开发、数据标注伦理等前沿技术趋势,构建起"前沿课程+智能实训+精准就业"的高效培养体系。

课堂上不光教理论,还带着学员做了十多个真实项目。学员要亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献503条内容

已为社区贡献503条内容

所有评论(0)