DeepSeek 工作提效完全指南:从入门到精通的三种实战路径

本文详细介绍了DeepSeek AI的三种使用方式及其应用场景。官网直接使用适合个人用户快速体验;硅基流动API适合企业级自动化需求;Ollama本地部署则能确保数据安全与高性能。文章还提供了20+工作场景应用案例,包括文案创作、数据分析、代码开发、办公自动化等,并分享了提示词工程、自动化工作流搭建等进阶技巧。30天上手计划帮助用户逐步掌握AI工具,实现工作效率提升。无论个人还是企业用户,都能根据

欢迎来到小灰灰的博客空间!Weclome you!

博客主页:IT·小灰灰

筑梦官网:筑梦官网

热爱领域:前端(HTML)、后端(PHP)、人工智能、云服务

目录

在 AI 技术重塑职场生产力的今天,DeepSeek 凭借其强大的中文理解能力、专业的代码生成水平和极具竞争力的成本优势,正在成为越来越多职场人的"第二大脑"。本文将为您深度解析三种主流使用方式——官网直接使用、硅基流动 API 调用、Ollama 本地部署,并详细拆解 DeepSeek 在真实工作场景中的 20+ 具体应用,助您构建专属的 AI 工作流。

一、三种方式深度对比:选择你的最佳入口

核心参数对比表

| 使用方式 | 成本结构 | 响应速度 | 数据安全 | 定制能力 | 学习曲线 | 推荐场景 |

|---|---|---|---|---|---|---|

| 官网直接使用 | 免费额度+按量付费 | 依赖网络 | 公有云存储 | 低 | ★☆☆☆☆ | 个人轻度使用、快速验证 |

| 硅基流动 API | 阶梯定价,批量优惠 | 毫秒级 | 传输加密 | 中 | ★★★☆☆ | 企业级应用、自动化流程 |

| Ollama 本地运行 | 硬件一次性投入 | 本地极速 | 完全私有化 | 高 | ★★★★★ | 敏感数据处理、高频调用 |

二、通过官网使用:零门槛的即时生产力(包含进阶版)

2.1 直接使用

2.1.1 打开浏览器

在电子设备中点击浏览器,进入浏览器主页。

2.1.2 进入DeepSeek官网

在浏览器网址栏中输入DeepSeek官网,进入后选择立即聊天。

2.1.3 开始聊天

在输入框中输入想发送的消息,然后点击右侧发送按钮,注意:电脑端可按回车发送哦。

2.2 通过官网API使用

2.2.1 打开浏览器

在电子设备中点击浏览器,进入浏览器主页。

2.2.2 进入DeepSeek官网

在浏览器网址栏中输入DeepSeek官网,进入后右上角选择开放平台。

2.2.3 注册账号

进入后根据提示注册并登录好账号

2.2.4 获取API密钥

点击左侧控制台中API Keys按钮

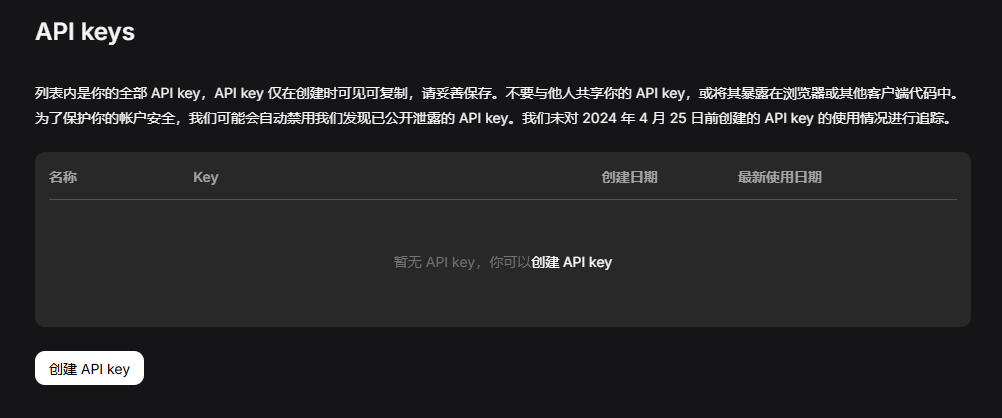

接下来点击创建API key按钮

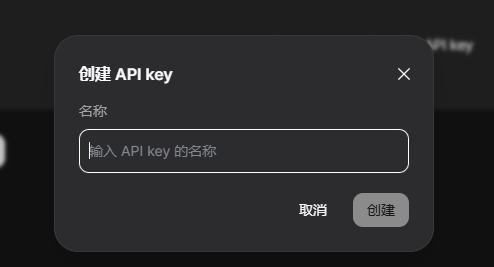

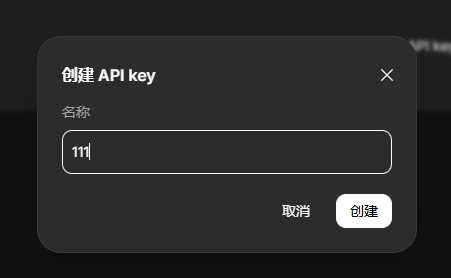

接下来输入名字

接下来点击创建按钮

创建后记得复制哦

2.2.5 调用API

python:

# Please install OpenAI SDK first: `pip3 install openai`

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get('DEEPSEEK_API_KEY'),

base_url="https://api.deepseek.com")

response = client.chat.completions.create(

model="deepseek-chat",

messages=[

{"role": "system", "content": "You are a helpful assistant"},

{"role": "user", "content": "Hello"},

],

stream=False

)

print(response.choices[0].message.content)curl:

curl https://api.deepseek.com/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer ${DEEPSEEK_API_KEY}" \

-d '{

"model": "deepseek-chat",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello!"}

],

"stream": false

}'node.js:

// Please install OpenAI SDK first: `npm install openai`

import OpenAI from "openai";

const openai = new OpenAI({

baseURL: 'https://api.deepseek.com',

apiKey: process.env.DEEPSEEK_API_KEY,

});

async function main() {

const completion = await openai.chat.completions.create({

messages: [{ role: "system", content: "You are a helpful assistant." }],

model: "deepseek-chat",

});

console.log(completion.choices[0].message.content);

}

main();2.2.6 功能模块详解

官网控制台提供三大核心功能区:

1. 对话交互区:

-

支持多轮对话,上下文记忆长达 32K tokens

-

可保存常用 prompt 为模板(如"日报生成器"、"邮件优化器")

-

快捷键:Ctrl+Enter 快速发送,Ctrl+/ 调出模板库

2. API 调试区:

-

提供可视化接口测试工具,无需编写代码即可调试

-

支持调整 Temperature(0.2-1.0)、Top P、Frequency Penalty 等参数

-

实战技巧:将调试好的参数直接导出为 Python/JavaScript 代码片段

3. 用量监控区:

-

实时查看 token 消耗曲线

-

设置用量告警阈值(建议设为 50 元、80% 额度)

-

下载详细账单,分析高频调用场景以优化成本

三、硅基流动 API 调用:企业级自动化引擎

3.1 为什么选硅基流动?

硅基流动(SiliconFlow)作为专业 AI 基础设施提供商,其 DeepSeek API 服务具备三大优势:

-

成本优化:相比官网直调,批量调用平均节省 30-50% 费用

-

高可用性:承诺 99.9% SLA,自动故障转移

-

生态兼容:完美兼容 OpenAI SDK,现有代码无需改造

3.2 通过硅基流动平台使用

3.2.1 获取API

进入硅基流动平台,获取API密钥

3.2.2 通过代码调用API

python:

import os

from typing import List, Dict

from langchain_openai import ChatOpenAI

from langchain.schema import HumanMessage, SystemMessage

from dotenv import load_dotenv

# 加载环境变量

load_dotenv()

class DeepSeekClient:

def __init__(self):

self.llm = ChatOpenAI(

model="deepseek-chat",

openai_api_key=os.getenv("SILICONFLOW_API_KEY"),

openai_api_base="https://api.siliconflow.cn/v1",

temperature=0.3, # 工作场景建议较低温度

max_tokens=4096,

streaming=True # 支持流式输出,用户体验更好

)

def generate_report(self, data: str, report_type: str = "日报") -> str:

"""智能报告生成器"""

system_prompt = f"""你是一个专业的企业数据分析助手。根据提供的数据,生成一份结构化的{report_type}。

必须包含:

1. 关键数据摘要(3-5条)

2. 趋势分析(同比/环比)

3. 问题预警(如有)

4. 行动建议(2-3条)

格式要求:Markdown,数据用表格呈现"""

messages = [

SystemMessage(content=system_prompt),

HumanMessage(content=f"数据如下:\n{data}")

]

response = self.llm.invoke(messages)

return response.content

def batch_process(self, tasks: List[Dict]) -> List[str]:

"""批量任务处理"""

results = []

for task in tasks:

try:

result = self.generate_report(task["data"], task["type"])

results.append(result)

except Exception as e:

results.append(f"任务失败: {str(e)}")

return results

# 使用示例

if __name__ == "__main__":

client = DeepSeekClient()

# 单任务调用

sales_data = """

本周销售额:120万,上周:95万,去年同期:80万

客户投诉:5起,环比增加2起

新品转化率:3.2%,低于目标5%

"""

report = client.generate_report(sales_data, "周报")

print(report)

# 批量任务(适合定时任务)

tasks = [

{"data": "销售数据A", "type": "日报"},

{"data": "运营数据B", "type": "日报"},

{"data": "客服数据C", "type": "周报"}

]

reports = client.batch_process(tasks)3.3 高级应用场景

场景 1:智能客服工单自动分类

def classify_ticket(ticket_content: str) -> Dict:

"""自动分类工单并提取关键信息"""

prompt = f"""

分析以下客服工单,输出JSON格式:

{{

"category": "类别(技术/账单/售前/投诉)",

"priority": "优先级(高/中/低)",

"keywords": ["关键词列表"],

"suggested_handler": "建议处理部门"

}}

工单内容:{ticket_content}

"""

# 调用API并解析JSON响应场景 2:合同条款智能审查

-

将合同文本分段提交给 API

-

设置 system prompt 为"你是一位资深法务顾问,识别合同中的风险条款"

-

自动标记异常条款并给出修改建议

四、Ollama 本地运行:数据安全与极致性能

4.1 硬件配置指南

最低配置(可运行 7B 模型):

-

CPU:Intel i5 或 AMD Ryzen 5 以上

-

内存:16GB DDR4

-

显卡:GTX 1060 6GB 或同等性能

-

存储:20GB 可用空间(模型文件约 4-5GB)

推荐配置(流畅运行 14B 模型):

-

CPU:Intel i7-13700K / AMD Ryzen 9 7900X

-

内存:32GB DDR5

-

显卡:RTX 4070 Ti Super(16GB 显存)

-

存储:NVMe SSD 500GB

企业级配置(支持 70B 模型 + 高并发):

-

多卡服务器:NVIDIA A100 40GB × 4

-

内存:256GB ECC

-

采用 vLLM 部署框架,支持张量并行

4.2 完整部署流程

4.2.1 安装 Ollama

# Linux 推荐方式(自动配置 systemctl)

curl -fsSL https://ollama.com/install.sh | sh

# 验证安装

ollama --version # 应显示 0.5.x 以上

# 启动服务并设置开机自启

sudo systemctl enable ollama

sudo systemctl start ollama4.2.2 模型管理

# 查看可用模型

ollama list

# 拉取 DeepSeek-R1 系列模型

ollama pull deepseek-r1:7b # 平衡性能与速度

ollama pull deepseek-r1:14b # 推荐用于生产

ollama pull deepseek-r1:32b # 需要24GB显存

# 删除不用的模型释放空间

ollama rm deepseek-r1:1.5b

# 查看模型占用

ollama ps # 类似 docker ps,显示运行中的模型4.2.3 安全配置

# 编辑配置文件

sudo nano /etc/systemd/system/ollama.service

# 在 [Service] 段添加:

Environment="OLLAMA_HOST=0.0.0.0:11434" # 如需局域网访问

Environment="OLLAMA_API_KEY=sk-your-256-bit-secret-key"

Environment="OLLAMA_MAX_LOADED_MODELS=2" # 同时加载2个模型

Environment="OLLAMA_KEEP_ALIVE=24h" # 模型常驻内存

# 重启服务

sudo systemctl daemon-reload

sudo systemctl restart ollama4.2.4 Python 对接

import requests

import json

class LocalDeepSeek:

def __init__(self, api_key=None):

self.base_url = "http://localhost:11434/api"

self.headers = {

"Authorization": f"Bearer {api_key}" if api_key else None,

"Content-Type": "application/json"

}

def chat(self, prompt: str, model="deepseek-r1:7b",

temperature=0.3, stream=False) -> str:

"""本地对话接口"""

payload = {

"model": model,

"messages": [{"role": "user", "content": prompt}],

"temperature": temperature,

"stream": stream

}

response = requests.post(

f"{self.base_url}/chat",

headers=self.headers,

data=json.dumps(payload)

)

if response.status_code == 200:

return response.json()["message"]["content"]

else:

raise Exception(f"调用失败: {response.text}")

def generate_with_template(self, template_name: str, **kwargs) -> str:

"""使用预设模板生成"""

# 可预先定义各类工作模板

templates = {

"meeting_minutes": "请根据以下会议录音转写内容,生成结构化会议纪要...\n{content}",

"email_reply": "请帮我回复这封邮件,语气{tone}...\n{email}",

# 更多模板...

}

prompt = templates[template_name].format(**kwargs)

return self.chat(prompt)

# 使用示例

local_ai = LocalDeepSeek(api_key="sk-your-key")

result = local_ai.generate_with_template(

"meeting_minutes",

content="会议录音转写文本..."

)4.3 性能优化技巧

4.3.1 模型量化压缩

# 使用 GGUF 格式量化模型(节省 50%+ 显存)

ollama cp deepseek-r1:14b deepseek-r1:14b-q4 # 创建副本

# 然后手动替换模型文件为量化版本4.3.2 GPU 显存优化

# 限制显存使用(防止卡死)

export CUDA_VISIBLE_DEVICES=0 # 只使用第一块卡

export PYTORCH_CUDA_ALLOC_CONF=max_split_size_mb:1284.3.3 并发处理

from concurrent.futures import ThreadPoolExecutor

# 多线程批量处理

with ThreadPoolExecutor(max_workers=4) as executor:

futures = [executor.submit(local_ai.chat, task) for task in task_list]五、DeepSeek 工作场景全景图:20+ 实战应用

5.1 文案创作类(适合所有接入方式)

| 应用场景 | 输入示例 | 输出价值 | 推荐模型 |

|---|---|---|---|

| 日报/周报生成 | 今日完成A项目需求评审,修改了3个Bug,参加了2小时会议 | 结构化报告+数据可视化建议+问题预警 | deepseek-chat |

| 邮件优化 | 草拟邮件:客户投诉产品延迟交付 | 语气优化+风险点提示+三种备选方案 | deepseek-chat |

| 营销文案 | 为新款降噪耳机生成小红书文案,目标Z世代 | 10个带emoji的标题+正文+话题标签 | deepseek-chat |

| PPT大纲 | 主题:Q3销售复盘,受众:管理层,时长20分钟 | 逻辑框架+每页要点+数据呈现建议 | deepseek-chat |

实战 Prompt 模板:

角色:你是一位资深的企业文案专家

任务:将以下碎片化工作记录转化为专业的周报

要求:

1. 使用STAR法则描述关键任务

2. 包含量化数据(如效率提升30%)

3. 突出对团队/公司的价值贡献

4. 语言简洁,适合管理层快速阅读

输入:[粘贴你的原始记录]5.2 数据分析类(推荐 API/本地方式)

5.2.1 销售数据异常检测

# 上传CSV数据,自动识别异常

data = """

日期,销售额,订单量,客单价

2024-01-01,150000,300,500

2024-01-02,120000,280,428

2024-01-03,80000, 290, 276 # 异常:销售额暴跌但订单量稳定

"""

prompt = f"""

分析以下销售数据,识别异常点并说明原因:

{data}

输出格式:

1. 异常点列表(日期+指标+偏离度)

2. 可能原因分析(3条)

3. 验证建议(如何确认原因)

4. 应对措施

"""5.2.2 SQL 查询生成

-

输入:"查询上个月销售额TOP10的客户及其复购率"

-

输出:可直接执行的 SQL 语句 + 执行计划优化建议

5.2.3 数据可视化建议

-

输入:"我有用户留存数据,想展示 cohort 分析"

-

输出:推荐用热力图 + 提供 Python Plotly 代码实现

5.3 代码开发类(推荐本地部署)

5.3.1 代码审查助手

# 将DeepSeek集成到Git hooks

def pre_commit_review():

changed_code = get_staged_changes()

prompt = f"""

作为资深Python工程师,审查以下代码:

1. 找出潜在Bug

2. 检查性能瓶颈

3. 给出Pythonic改进建议

4. 评估安全风险

代码:

```python

{changed_code}

```

"""

review_comments = local_ai.chat(prompt, model="deepseek-r1:14b")

if "CRITICAL" in review_comments:

print("发现严重问题,提交被拒绝")

exit(1)5.3.2 跨语言翻译

-

将 Java 代码翻译为 Python,并解释语法差异

-

将老旧 VBScript 迁移到现代 PowerShell

5.3.3 单元测试生成

# 自动为函数生成pytest测试用例

def add(a, b):

return a + b

# DeepSeek输出:

"""

import pytest

def test_add_integers():

assert add(1, 2) == 3

def test_add_floats():

assert add(10.5, 2.5) == 13.0

def test_add_negative():

assert add(-1, -1) == -2

def test_add_mixed_types():

with pytest.raises(TypeError):

add("1", 2)

"""5.4 智能办公自动化(推荐 API 方式)

5.4.1 会议纪要实时转写与提炼

-

使用阿里通义听悟等工具将会议录音转为文本

-

调用 DeepSeek API 自动生成:

-

待办事项清单(@责任人+截止日期)

-

决策记录

-

关键词云图

-

5.4.2 合同批量审查

def review_contract(contract_path: str):

with open(contract_path, 'r', encoding='utf-8') as f:

content = f.read()

# 第一轮:风险识别

risk_prompt = f"""

审查以下合同条款,识别法律风险:

{content[:4000]} # 分批处理长文档

输出JSON:{{"risk_level": "高/中/低", "risk_points": []}}

"""

# 第二轮:条款优化

optimize_prompt = f"""

针对以下风险点,给出3个优化方案:

{risk_json}

要求:保留商业意图,降低法律风险

"""

return client.batch_process([risk_prompt, optimize_prompt])5.4.3 简历智能筛选

-

输入:100份简历PDF

-

输出:按匹配度排序的Top10候选人+每份简历的优劣势分析+面试问题建议

5.5 创意构思类

| 应用场景 | 输入 | 输出 | 参数设置 |

|---|---|---|---|

| 产品命名 | 智能硬件,主打健康监测,目标中老年 | 20个候选名称+商标可用性分析 | temperature=0.8 |

| 活动策划 | 科技公司年会,预算50万,300人 | 完整流程+场地布置方案+风险预案 | temperature=0.7 |

| 头脑风暴 | 提升App用户留存的10个方法 | 每个方法含成本预估和ROI分析 | temperature=0.9 |

5.6 学习与知识管理

5.6.1 技术文档速读

Prompt:

请总结这篇论文的核心贡献,要求:

1. 用一句话概括创新点

2. 列出3个关键技术细节

3. 评估在医疗行业的应用前景

4. 指出2个局限性

[粘贴论文摘要或URL]5.6.2 外语邮件撰写

-

输入:用中文描述意图"向德国客户解释延迟交货,并给出补偿方案"

-

输出:正式商务德语邮件+中文翻译+文化注意事项(德国人重视精确时间)

六、进阶技巧:构建你的 AI 工作流

6.1 提示词工程(Prompt Engineering)

6.1.1 角色扮演法

角色:你是一位有10年经验的麦肯锡咨询顾问

背景:客户是零售行业,面临线上冲击

任务:提供数字化转型三步走战略

约束:每步预算不超过200万,6个月内见效

输出:PPT大纲+数据支撑+对标案例6.1.2 思维链(Chain-of-Thought)

问题:我们部门Q4业绩下滑15%,请分析原因

要求:请一步一步思考,先列出可能因素,再验证每个假设6.1.3 少样本学习(Few-shot)

示例1:

输入:客户反馈"物流太慢了"

输出:{"情绪": "负面", "标签": ["物流"], "优先级": "高"}

示例2:

输入:客户反馈"产品很好用"

输出:{"情绪": "正面", "标签": ["产品"], "优先级": "低"}

现在请分析:客服太敷衍,问题没解决6.2 自动化工作流搭建

Airflow + DeepSeek 定时任务:

from airflow import DAG

from airflow.operators.python import PythonOperator

from datetime import datetime

def generate_daily_report():

client = DeepSeekClient()

# 从数据库获取数据

# 调用API生成报告

# 发送邮件给管理层

dag = DAG('daily_ai_report', schedule_interval='0 18 * * *')

task = PythonOperator(task_id='generate_report', python_callable=generate_daily_report, dag=dag)6.3 成本优化策略

| 策略 | 实施方法 | 预期节省 |

|---|---|---|

| 缓存常用请求 | Redis缓存相同问题的答案 | 30-50% |

| 模型降级 | 简单任务用1.5B模型,复杂用14B | 40-60% |

| 批量处理 | 将10个请求合并一次API调用 | 20-30% |

| 夜间任务调度 | 利用谷时电价运行批量任务 | 15% |

七、选择决策树:如何确定你的方案

你的需求是?(个人/企业)

├─ 个人使用

│ ├─ 偶尔用用 → 官网直接调用(5分钟上手)

│ ├─ 高频使用 → Ollama本地(4090显卡)

│ └─ 开发学习 → Ollama + 7B模型(成本最低)

│

└─ 企业使用

├─ 数据敏感?(金融/医疗/政府)

│ ├─ 是 → Ollama私有云(最小化数据泄露风险)

│ └─ 否 → 硅基流动API(平衡成本与效率)

│

├─ 预算充足?

│ ├─ 是 → 硅基流动企业版(享受专属支持)

│ └─ 否 → 自建Ollama集群(硬件一次性投入)

│

└─ 技术能力强?

├─ 是 → Ollama + 定制微调(最大化效果)

└─ 否 → 硅基流动 + 低代码平台(快速落地)八、总结与行动清单

DeepSeek 不仅是一个对话工具,更是可以深度嵌入工作流程的生产力引擎。无论选择哪种接入方式,关键在于将重复性、标准化、需要一定智力的工作逐步交给AI。

30天上手计划

Week 1:基础探索

-

注册官网账号,获取API Key

-

在WPS中完成首次配置

-

用DeepSeek生成3份不同风格的周报模板

Week 2:单点突破

-

识别1个最耗时的重复性工作(如数据处理)

-

用官网API实现自动化

-

记录时间节省效果

Week 3:流程整合

-

学习Ollama基础安装

-

在本地部署7B模型测试

-

对比云端与本地的响应速度差异

Week 4:体系构建

-

整理个人专属prompt库(至少20个)

-

搭建1个自动化工作流(如每日数据报告)

-

向团队分享使用心得,推动集体提效

终极建议:不要追求一步到位。从最简单的"官网+WPS"开始,在真实工作场景中积累使用体感,再逐步向API和本地部署进阶。AI工具的威力,在于持续使用带来的复利效应。

附录:关键资源链接

-

DeepSeek 官方文档:platform.deepseek.com/docs

-

Ollama 模型库:ollama.com/library

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)