LangGraph企业级实战:构建生产环境高可用AI Agents

人工智能(AI)已从概念阶段迈向实际应用,深刻变革着问题解决的范式。作为各类创新应用的核心组件,AI智能体正推动着从智能对话到自动化流程的全面升级。然而,构建具备生产级可靠性、可扩展性和部署就绪性的智能体系统仍面临重大挑战。LangGraph作为LangChain生态系统中的高阶框架,专门用于开发具备状态管理能力的复杂智能体,可有效应对各类现实场景中的技术难题。本文将系统解析如何基于LangGra

人工智能(AI)已从概念阶段迈向实际应用,深刻变革着问题解决的范式。作为各类创新应用的核心组件,AI智能体正推动着从智能对话到自动化流程的全面升级。然而,构建具备生产级可靠性、可扩展性和部署就绪性的智能体系统仍面临重大挑战。LangGraph作为LangChain生态系统中的高阶框架,专门用于开发具备状态管理能力的复杂智能体,可有效应对各类现实场景中的技术难题。本文将系统解析如何基于LangGraph构建企业级智能体解决方案,并通过完整的代码示例、工作流设计和架构图示,提供端到端的技术实现指导。

什么是 LangGraph?

LangGraph 是 LangChain 框架的扩展,专门用来创建状态化、多角色的 AI 智能体,支持循环工作流。跟传统的线性工作流(LangChain 里的“链”)不同,LangGraph 允许你构建图结构,让任务可以循环、分支,动态适应各种条件。这让它特别适合处理现实世界中那些复杂、需要灵活性的任务。

LangGraph 的核心功能

- • 状态化工作流:每一步自动保存状态,智能体可以暂停、恢复,或者从错误中恢复。

- • 人工介入(Human-in-the-Loop):支持人类介入审批或编辑操作,确保关键任务有人把关。

- • 循环图:支持循环和条件逻辑,实现动态决策。

- • 与 LangChain 无缝集成:可以跟 LangChain 的工具和 LangSmith 配合,方便调试和监控。

- • 可扩展性:专为生产环境设计,支持持久执行和错误处理。

你可以把 LangGraph 想象成 AI 智能体的 GPS——它不只是沿着直路走,还能绕道、回头、根据“路况”(用户需求)灵活调整。

为什么用 LangGraph 打造生产就绪的 AI 智能体?

弄个能在 demo 里跑的 AI 智能体是一回事,但让它在生产环境里稳如老狗又是另一回事。生产系统得面对这些挑战:

- • 杂乱输入:用户给的信息不一定清楚或完整。

- • 边缘情况:意想不到的场景可能让系统崩掉。

- • 扩展性:得能处理成千上万的请求还不宕机。

- • 调试:出错时得知道问题出在哪儿。

LangGraph 帮你解决这些问题,提供了:

- • 细粒度控制:把任务拆成小块(节点),通过清晰的连接(边)管理。

- • 状态管理:在交互中保持上下文,智能体能“记住”正在发生的事。

- • 错误恢复:失败后能从断点继续。

- • 可观察性:搭配 LangSmith,追踪执行过程,轻松调试。

实际案例:旅行规划助手

咱们来看个实际例子:一个旅行规划助手,帮用户规划行程,实时获取航班和酒店信息,展示在网页上,还能根据用户需求通过邮件发送行程。这是个很适合用 LangGraph 的场景,因为它涉及:

- • 多步骤操作(搜索航班、酒店,发送邮件)。

- • 条件逻辑(比如只有用户要求时才发送邮件)。

- • 外部工具集成(航班和酒店的 API)。

- • 人工介入(让用户确认行程)。

工作原理

用户输入需求(比如“下周末从纽约去巴黎的行程”),助手会:

- \1. 处理请求,提取关键信息(目的地、日期等)。

- \2. 调用 API 获取航班和酒店信息。

- \3. 把结果整理成用户友好的格式。

- \4. 在网页上展示行程,询问用户是否需要邮件发送。

- \5. 如果用户要求,就通过邮件发送行程。

LangGraph 的核心组件

在看代码之前,先搞懂 LangGraph 的几个核心部分:

- • 节点(Nodes):单个任务或功能(比如调用 API、处理用户输入)。

- • 边(Edges):节点之间的连接,定义工作流的走向。边可以是直接的(总去下一个节点)或条件的(根据逻辑选择下一个节点)。

- • 状态(State):一个共享的数据结构,保存智能体的当前状态,比如用户输入、API 结果或对话历史。

- • 图(Graph):把节点和边连起来的整体结构。

简单打个比方:节点就像工厂里的工人,边是传送带,状态是记录工作进度的剪贴板。

一步步实现

咱们用 Python 和 LangGraph 来实现这个旅行规划助手。假设你对 Python 有一定了解,也知道 LangChain 的基本用法。

第一步:配置环境

先安装所需库:

pip install langgraph langchain langchain-openai requests

设置 OpenAI(用于 LLM)和旅行 API(比如 Google Flights、Hotels)的 API 密钥,安全存储在环境变量中。

第二步:定义状态

状态是个共享数据结构,保存智能体运行所需的所有信息,比如用户输入、API 响应和生成的行程。我们用 typing_extensions 的 TypedDict 定义一个清晰、类型安全的结构。

from typing_extensions import TypedDict

class AgentState(TypedDict):

user_request: str

flight_options: list

hotel_options: list

itinerary: str

send_email: bool

第三步:创建节点

每个节点执行一个特定任务。以下是我们助手的节点:

- • 处理请求:从用户输入中提取关键信息。

- • 获取航班:调用航班 API。

- • 获取酒店:调用酒店 API。

- • 整理行程:格式化结果。

- • 询问邮件:询问用户是否需要邮件发送行程。

- • 发送邮件:通过邮件发送行程。

节点代码如下:

from langchain_openai import ChatOpenAI

from langchain.prompts import PromptTemplate

import requests

from typing import Dict

llm = ChatOpenAI(model="gpt-4", api_key="your-openai-api-key")

def process_request(state: AgentState) -> Dict:

prompt = PromptTemplate(

input_variables=["user_request"],

template="从以下内容提取目的地、出发地和日期:{user_request}"

)

response = llm.invoke(prompt.format(user_request=state["user_request"]))

# 假设响应包含解析后的数据(为简化示例)

return {"user_request": response.content}

def fetch_flights(state: AgentState) -> Dict:

# 模拟 API 调用(用真实的 Google Flights API 替换)

flight_data = [{"airline": "Air France", "price": "$500", "time": "10:00 AM"}]

return {"flight_options": flight_data}

def fetch_hotels(state: AgentState) -> Dict:

# 模拟 API 调用(用真实的 Google Hotels API 替换)

hotel_data = [{"hotel": "Paris Inn", "price": "$150/night"}]

return {"hotel_options": hotel_data}

def compile_itinerary(state: AgentState) -> Dict:

itinerary = f"航班信息:\n{state['flight_options']}\n酒店信息:\n{state['hotel_options']}"

return {"itinerary": itinerary}

def ask_email(state: AgentState) -> str:

# 模拟人工介入(生产环境中用 UI 或输入框)

return "send_email" if input("是否通过邮件发送行程?(y/n): ") == "y" else "end"

def send_email(state: AgentState) -> Dict:

# 模拟邮件发送(用 SendGrid 或类似服务替换)

print(f"正在发送行程邮件:{state['itinerary']}")

return {"send_email": True}

第四步:构建工作流

现在定义图,连接节点和边。我们用条件边来决定是发送邮件还是结束工作流。

from langgraph.graph import StateGraph, START, END

workflow = StateGraph(AgentState)

# 添加节点

workflow.add_node("process_request", process_request)

workflow.add_node("fetch_flights", fetch_flights)

workflow.add_node("fetch_hotels", fetch_hotels)

workflow.add_node("compile_itinerary", compile_itinerary)

workflow.add_node("ask_email", ask_email)

workflow.add_node("send_email", send_email)

# 添加边

workflow.add_edge(START, "process_request")

workflow.add_edge("process_request", "fetch_flights")

workflow.add_edge("fetch_flights", "fetch_hotels")

workflow.add_edge("fetch_hotels", "compile_itinerary")

workflow.add_edge("compile_itinerary", "ask_email")

workflow.add_conditional_edges(

"ask_email",

lambda state: state.get("send_email", "end"),

{"send_email": "send_email", "end": END}

)

workflow.add_edge("send_email", END)

# 编译图

agent = workflow.compile()

第五步:运行智能体

用一个示例输入测试智能体:

initial_state = {"user_request": "计划下周末从纽约去巴黎的行程"}

result = agent.invoke(initial_state)

print("最终行程:")

print(result["itinerary"])

示例输出

假设用户在询问邮件时输入“y”:

最终行程:

航班信息:

[{'airline': 'Air France', 'price': '$500', 'time': '10:00 AM'}]

酒店信息:

[{'hotel': 'Paris Inn', 'price': '$150/night'}]

正在发送行程邮件:航班信息:[{'airline': 'Air France', 'price': '$500', 'time': '10:00 AM'}] 酒店信息:[{'hotel': 'Paris Inn', 'price': '$150/night'}]

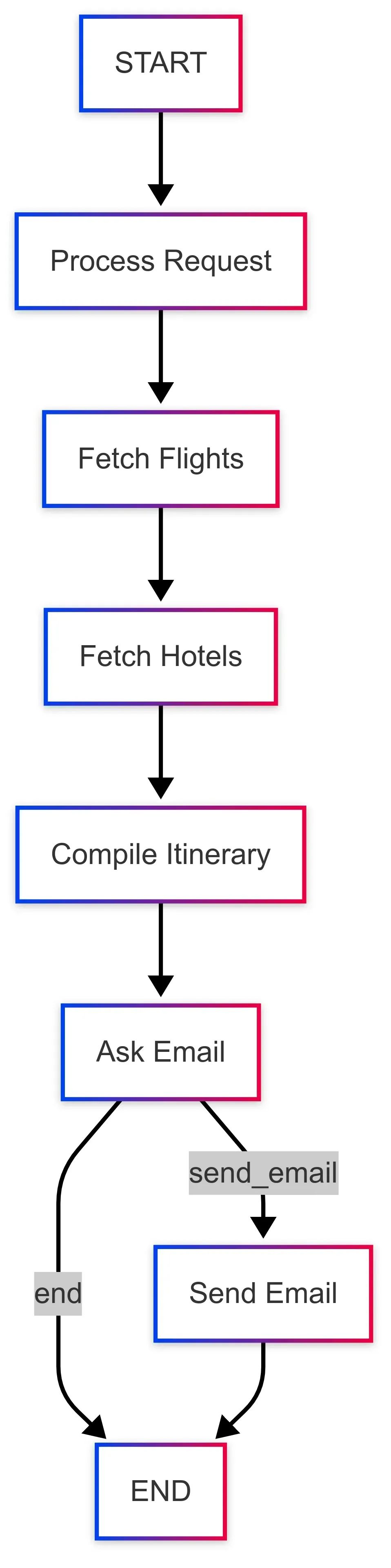

工作流图

工作流的可视化如下:

(此处为文字描述,实际生产中会有图表展示从处理用户请求到发送邮件或结束工作流的流程,基于用户选择)

为什么这个智能体是生产就绪的?

这个旅行规划助手之所以能达到生产就绪的标准,是因为:

- • 错误处理:LangGraph 的状态管理确保工作流在失败后能恢复。

- • 支持人工介入:询问邮件的节点允许用户干预。

- • 模块化:每个节点都是小而专注的任务,方便调试或替换组件(比如换用其他 API)。

- • 可扩展:LangGraph 的基础设施支持通过 LangGraph Platform 部署,处理大量用户。

你可以进一步优化,比如:

- • 用 LangSmith 进行调试和监控。

- • 通过 LangGraph Platform 部署以提高扩展性。

- • 集成真实 API(比如 SendGrid 发邮件,Google Flights 获取实时数据)。

其他现实世界的应用场景

LangGraph 在很多场景都能大放异彩:

- • 客服智能体:解答问题,检索知识库,必要时转交人工。

- • 研究助手:搜索网络,总结信息,生成报告。

- • 财务顾问:分析市场数据,推荐投资,监控投资组合。

比如,LinkedIn 用 LangGraph 驱动内部 SQL Bot,把自然语言查询翻译成 SQL,大幅提升团队效率。

打造生产就绪智能体的建议

- • 从简单开始:先搞个基础工作流,再逐步加复杂功能。

- • 用条件逻辑:利用条件边实现动态决策。

- • 测试边缘情况:模拟杂乱输入和失败场景,确保系统稳健。

- • 用 LangSmith 监控:追踪 token 使用、错误和性能。

- • 引入人工介入:对敏感任务使用 human-in-the-loop,避免出错。

总结

LangGraph 让打造超越 demo 的可靠 AI 智能体变得简单。通过把任务拆成小步骤(节点),用清晰的路径(边)连接,跟踪信息(状态),LangGraph 让复杂工作流变得易于管理。我们的旅行规划助手展示了如何把这些理念用在实际场景中,配上代码、结果和清晰的工作流图。

大模型未来如何发展?普通人能从中受益吗?

在科技日新月异的今天,大模型已经展现出了令人瞩目的能力,从编写代码到医疗诊断,再到自动驾驶,它们的应用领域日益广泛。那么,未来大模型将如何发展?普通人又能从中获得哪些益处呢?

通用人工智能(AGI)的曙光:未来,我们可能会见证通用人工智能(AGI)的出现,这是一种能够像人类一样思考的超级模型。它们有可能帮助人类解决气候变化、癌症等全球性难题。这样的发展将极大地推动科技进步,改善人类生活。

个人专属大模型的崛起:想象一下,未来的某一天,每个人的手机里都可能拥有一个私人AI助手。这个助手了解你的喜好,记得你的日程,甚至能模仿你的语气写邮件、回微信。这样的个性化服务将使我们的生活变得更加便捷。

脑机接口与大模型的融合:脑机接口技术的发展,使得大模型与人类的思维直接连接成为可能。未来,你可能只需戴上头盔,心中想到写一篇工作总结”,大模型就能将文字直接投影到屏幕上,实现真正的心想事成。

大模型的多领域应用:大模型就像一个超级智能的多面手,在各个领域都展现出了巨大的潜力和价值。随着技术的不断发展,相信未来大模型还会给我们带来更多的惊喜。赶紧把这篇文章分享给身边的朋友,一起感受大模型的魅力吧!

那么,如何学习AI大模型?

在一线互联网企业工作十余年里,我指导过不少同行后辈,帮助他们得到了学习和成长。我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑。因此,我坚持整理和分享各种AI大模型资料,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频。

学习阶段包括:

1.大模型系统设计

从大模型系统设计入手,讲解大模型的主要方法。包括模型架构、训练过程、优化策略等,让读者对大模型有一个全面的认识。

2.大模型提示词工程

通过大模型提示词工程,从Prompts角度入手,更好发挥模型的作用。包括提示词的构造、优化、应用等,让读者学会如何更好地利用大模型。

3.大模型平台应用开发

借助阿里云PAI平台,构建电商领域虚拟试衣系统。从需求分析、方案设计、到具体实现,详细讲解如何利用大模型构建实际应用。

4.大模型知识库应用开发

以LangChain框架为例,构建物流行业咨询智能问答系统。包括知识库的构建、问答系统的设计、到实际应用,让读者了解如何利用大模型构建智能问答系统。

5.大模型微调开发

借助以大健康、新零售、新媒体领域,构建适合当前领域的大模型。包括微调的方法、技巧、到实际应用,让读者学会如何针对特定领域进行大模型的微调。

6.SD多模态大模型

以SD多模态大模型为主,搭建文生图小程序案例。从模型选择、到小程序的设计、到实际应用,让读者了解如何利用大模型构建多模态应用。

7.大模型平台应用与开发

通过星火大模型、文心大模型等成熟大模型,构建大模型行业应用。包括行业需求分析、方案设计、到实际应用,让读者了解如何利用大模型构建行业应用。

学成之后的收获👈

• 全栈工程实现能力:通过学习,你将掌握从前端到后端,从产品经理到设计,再到数据分析等一系列技能,实现全方位的技术提升。

• 解决实际项目需求:在大数据时代,企业和机构面临海量数据处理的需求。掌握大模型应用开发技能,将使你能够更准确地分析数据,更有效地做出决策,更好地应对各种实际项目挑战。

• AI应用开发实战技能:你将学习如何基于大模型和企业数据开发AI应用,包括理论掌握、GPU算力运用、硬件知识、LangChain开发框架应用,以及项目实战经验。此外,你还将学会如何进行Fine-tuning垂直训练大模型,包括数据准备、数据蒸馏和大模型部署等一站式技能。

• 提升编码能力:大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握将提升你的编码能力和分析能力,使你能够编写更高质量的代码。

学习资源📚

- AI大模型学习路线图:为你提供清晰的学习路径,助你系统地掌握AI大模型知识。

- 100套AI大模型商业化落地方案:学习如何将AI大模型技术应用于实际商业场景,实现技术的商业化价值。

- 100集大模型视频教程:通过视频教程,你将更直观地学习大模型的技术细节和应用方法。

- 200本大模型PDF书籍:丰富的书籍资源,供你深入阅读和研究,拓宽你的知识视野。

- LLM面试题合集:准备面试,了解大模型领域的常见问题,提升你的面试通过率。

- AI产品经理资源合集:为你提供AI产品经理的实用资源,帮助你更好地管理和推广AI产品。

👉获取方式: 😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】

通过这些资料和阶段性的学习,普通人也可以逐步掌握AI大模型的知识和技能,从而在这个快速发展的领域中找到自己的位置。让我们一起感受大模型的魅力,探索未来的无限可能!

更多推荐

已为社区贡献63条内容

已为社区贡献63条内容

所有评论(0)